PCに求めるのは「的確な助言」──Intelの基礎研究に近未来のUIを見た:Intel Developer Forum 2010(3/3 ページ)

多様化するセンサーデバイスとUI

Intelは毎年5〜6月ごろに米本社や隣接する展示スペース(2010年でいえばComputer History Museum)を使って「Research@Intel」という基礎研究成果を発表するイベントを開催している。当初は半導体製造技術や並列コンピューティングにおけるコンパイラ実装の発表などが多かったが、ここ2〜3年でテーマが急速に多様化している。

2009年でいえばロボットアームや新型モバイルデバイスなどの比較的民生品に近いものが登場し、2010年に実施されたイベントでは、今回のIDF 2010で取り上げられた情報認識型コンピューティングや新型ユーザーインタフェースのコンセプトモデル、物体認識やAR、音声やテキスト情報の要約システムなど、ユーザー視点から見ても興味ある技術が増えている。

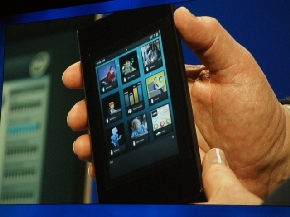

ラトナー氏の講演で取り上げられたSNSとセンサーデバイスを組み合わせたサービスでは、ユーザーの現在の行動をデバイスが認識し、それをアバターの動きで表現してSNSで一覧表示することで、グループメンバーの現在の行動が簡単に把握できるようになる。PVAの機能を補助するものとしては、カメラを通して撮影された画像でオブジェクトが何であるかを認識し、必要に応じて解説やガイドが取得できるというシステムが紹介されている。これは、仕組み的にGoogleの画像認識サービス「Goggle」に近い。

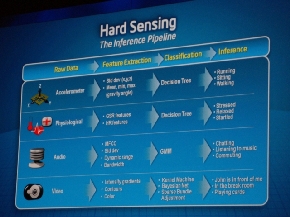

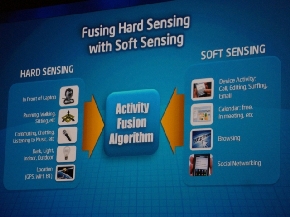

IDF 2010では、加速度センサーを利用する例が目立ったが、ほかにも心拍数、音声入力、画像情報と、さまざまなハードウェアセンサーが示された。これらの取得情報とSNSやWebページアクセスなどの利用履歴などソフトウェアによる各種情報を組み合わせることで、認識情報を算出するアルゴリズムが開発できる

IDF 2010では、加速度センサーを利用する例が目立ったが、ほかにも心拍数、音声入力、画像情報と、さまざまなハードウェアセンサーが示された。これらの取得情報とSNSやWebページアクセスなどの利用履歴などソフトウェアによる各種情報を組み合わせることで、認識情報を算出するアルゴリズムが開発できる

デバイスに搭載したセンサー技術とSNSを組み合わせて提供できるサービスの例。グループに所属するユーザーの行動を、アバターの動きをで把握する。「Context-Aware Computing」(情報認識型コンピューティング)を分かりやすく示したサンプルといえる

デバイスに搭載したセンサー技術とSNSを組み合わせて提供できるサービスの例。グループに所属するユーザーの行動を、アバターの動きをで把握する。「Context-Aware Computing」(情報認識型コンピューティング)を分かりやすく示したサンプルといえるタッチの次はモーションオペレーションの時代が来る

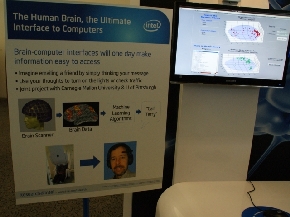

「Brain Scanner」とは脳波コントロールデバイスのこと。人は特定の思考を行うときに同じ脳波パターンを出す傾向がある。Brain Scannerはこの決まったパターンを認識して入力装置のコマンドに利用する

「Brain Scanner」とは脳波コントロールデバイスのこと。人は特定の思考を行うときに同じ脳波パターンを出す傾向がある。Brain Scannerはこの決まったパターンを認識して入力装置のコマンドに利用する入力で利用するセンサーも多様化している。興味深いのは、同じイメージに対するユーザーの思考がほぼ同じ脳波を示すことを利用して、Brain Scannerを利用した脳波センサーによるコマンド入力に応用するアイデアだ。ただし、ユーザーごとの脳波特性が違うため、実際の利用では一昔前の音声認識技術であった「エンロール」と呼ばれる初期化作業が必要となる。また誤動作を防ぐためのエラー補正機能も必要となるだろう。脳波コントロール技術は思考がダイレクトに反映されるのが怖いが、非常に興味深い取り組みだ。

IDF初日のダディ・パルムッター氏による基調講演ではGestureTekのモーションコントロール技術と、Sixenseの「TrueMotion 3D」と呼ばれる3Dモーションコントロール技術が紹介されている。GestureTekはテレビと一緒に設置されたカメラを通じて目の前のユーザーのモーションを把握する技術で、ユーザーが右に手を動かせば画面が右へと移動し、手を広げる動作を行えば画面が拡大する。Microsoftが2010年の秋に発売する「Kinect for Xbox 360」と同様の機能を実現する。

もう一方のTrueMotion 3Dは、スティック型のデバイスを動かすとバーチャルワールド内のオブジェクトやカーソルが手と同様に動いてユーザーの手の代わりとして動作する。これに立体視対応技術を組み合わせると、ユーザーは仮想空間を立体的に認識できるため、より効果が高くなるという。

折しもIDFが開催された週の金曜日、米国でソニーの「PlayStation Move」が発売となった。これはWiiのリモコン型デバイスのソニー版にあたり、より精密なコントロールが可能という。役割としては先ほどのTrueMotion 3Dと同様のデバイスだが、これをゲームに応用するとどのようなことが可能なのだろうか? 同様のことはKinectにもいえる。

近い将来には、この技術を応用したデバイスがコンシューマー市場に登場して、一般的なユーザーインタフェースとして普及するかもしれない。

IDF 2010初日のパルムッター氏による基調講演で紹介されたGestureTekのモーションコントロールデバイス。カメラでユーザーの体の動きを把握し、画面のコントロール情報として受け付ける。画面のスクロールやオブジェクトの縮小拡大と回転だけでなく、メニューを表示して直接コマンドを入力するなど、UIの工夫次第で応用範囲も広がる

IDF 2010初日のパルムッター氏による基調講演で紹介されたGestureTekのモーションコントロールデバイス。カメラでユーザーの体の動きを把握し、画面のコントロール情報として受け付ける。画面のスクロールやオブジェクトの縮小拡大と回転だけでなく、メニューを表示して直接コマンドを入力するなど、UIの工夫次第で応用範囲も広がる

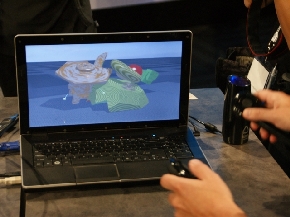

こちらはSixenseが開発した「TrueMotion 3D」と呼ばれるモーションコントロール技術。ユーザーは手持ちの加速度センサー付きスティックを動かして、バーチャルワールド内の各種オブジェクトを操作できる。デモでは、2つのセンサースティックと連動した2つのカーソルで3Dのバーチャルワールドにあるオブジェクトを掴んだり離したりして並べ替える操作を行っている。立体視対応グラスを使えば、ユーザーがバーチャルワールドの中で活動しているような効果を与えられるという(写真=左)。9月17日に全米でソニーのモーションコントローラ「PlayStation Move」が発売された。Wiiに続くモーションセンサーデバイスは、2010年秋に発売されるMicrosoftのKinect for Xbox 360でも採用される。ゲームの世界をどう変えるのか? 9月17日には発売を記念してサンフランシスコ市内でも特設会場を設けてスペシャルイベントが開催された(写真=右)

こちらはSixenseが開発した「TrueMotion 3D」と呼ばれるモーションコントロール技術。ユーザーは手持ちの加速度センサー付きスティックを動かして、バーチャルワールド内の各種オブジェクトを操作できる。デモでは、2つのセンサースティックと連動した2つのカーソルで3Dのバーチャルワールドにあるオブジェクトを掴んだり離したりして並べ替える操作を行っている。立体視対応グラスを使えば、ユーザーがバーチャルワールドの中で活動しているような効果を与えられるという(写真=左)。9月17日に全米でソニーのモーションコントローラ「PlayStation Move」が発売された。Wiiに続くモーションセンサーデバイスは、2010年秋に発売されるMicrosoftのKinect for Xbox 360でも採用される。ゲームの世界をどう変えるのか? 9月17日には発売を記念してサンフランシスコ市内でも特設会場を設けてスペシャルイベントが開催された(写真=右)関連記事

IntelはAtomで何をしたいのか?

IntelはAtomで何をしたいのか?

「Netbook向けCPU」の印象が強いAtomだが、組み込み分野を攻略する戦略兵器であったはずだ。いま、Atomはどこを目指しているのだろうか。 McAfeeの買収に見るIntelの「全方位外交」

McAfeeの買収に見るIntelの「全方位外交」

自作PCユーザー的な主役は「Sandy Bridge」だが、ITビジネスに興味があるなら、IDF直前の「McAfee買収」も気になる。その狙いを基調講演で探る。 「Sandy Bridge」のCPUコアが“整然と”並ぶ理由とは

「Sandy Bridge」のCPUコアが“整然と”並ぶ理由とは

米国で“秋の”IDF 2010が始まった。主役は次期主力CPU“Sandy Bridge”だ。IDFで明らかになった情報を、基調講演と技術セッションから紹介しよう。 ときめく夢で締めくくる――2050年の未来を描き出す

ときめく夢で締めくくる――2050年の未来を描き出す

現実的でシリアスなテーマが続くIDFだが、もちろん、「将来の夢」も忘れていない。とはいえ、「2050年」では「未来の話」になってしまうかな。 ムーアの法則が終わる日──ゴードン・ムーア氏特別講演から

ムーアの法則が終わる日──ゴードン・ムーア氏特別講演から

Intel Developer Forum 2007が9月18日(米国時間)から始まった。初日はIntel CEOの基調講演などが行われたが、IDF 2007の第一報は「インテルといえばこの人」が登場した特別講演からお届けしよう。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

アクセストップ10

- もう全部、裏配線でいいんじゃない? 「ASUS BTF DESIGN」が示す自作PCの新しい形 (2024年04月19日)

- ノートPCに外付けキーボードを“載せて”使える「タイプスティックス/打ち箸」に新色 (2024年04月18日)

- バッファロー製Wi-Fiルーターに脆弱性 対象機種は今すぐファームウェア更新を (2024年04月17日)

- さらなる高速化を実現! PCI Express 5.0接続SSDの新モデル「Crucial T705」を試して分かったこと (2024年04月18日)

- ついに8K対応した「Insta360 X4」の画質をX3と1インチ360度版で比較 今買うべき全天球カメラだと確信した (2024年04月16日)

- SwitchBotのミニプラグに不具合 「断続的にオン/オフを繰り返す、異音」などで該当製品の交換を呼びかけ (2024年04月17日)

- あなたのPCのWindows 10/11の「ライセンス」はどうなっている? 調べる方法をチェック! (2023年10月20日)

- 話題になったトラックボール「IST」も登場! エレコムのPC周辺機器が最大21%お得に買える (2024年04月19日)

- Core Ultra搭載の「Let's note FV5」を徹底検証 プレミアムモバイルの実力は? (2024年04月19日)

- アイロボットが4万円切りの「水拭き対応ロボット掃除機」を投入 “一家に1台”を目指す (2024年04月17日)