Keplerの“なに”が仮想化対応GPUなのか──日本で「NVIDIA VGX」を解説:Keplerに隠れたもう1つの顔を知る

個人が持ち込むすべてのデバイスで同じGPUコンピューティングを

NVIDIAは、GPUコンピューティングにおけるオフィス向け仮想化プラットフォーム「NVIDIA VGX」を日本の関係者に紹介する説明会を行い、NVIDIA米本社 VGXプロダクト・ライン・マネージャーのウィル・ウェイド氏が、プラットフォームの構成と概要を解説した。

NVIDIA VGXは、“Kepler”世代のGPUで実装したGPUコンピューティングにおけるハードウェア仮想化技術で、その概要は2012年5月に米国で行われた「GPU Technology Conference 2012」(GTC 2012)におけるNVIDIA CEOのジェンスン・ファン氏による基調講演で紹介している。

ウェイド氏は、NVIDIA VGXを支える技術的動向の1つとして、「Bring Your Own Device」(BYOD)を挙げている。BYODは、ビジネスの現場で、IT管理部門が支給するデバイスではなく、それぞれのユーザーが個人的に選んだ多種多様なデバイスを導入する動きを指す。この普及によって、どのようなデバイスでもPCと同じサービスを利用できるようにするのが、NVIDIA VGXの目的とウェイド氏は説明する。

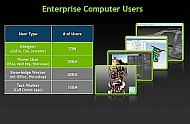

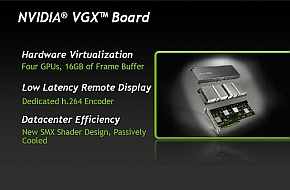

NVIDIA VGXプラットフォームは、「VGX Board」と「VGX HyperVisor」、そして「ユーザーが選んだデバイス」(User Selectable Machines)で構成する。NVIDIAは、企業のコンピューティングユーザーを4つのグループに分類しており、このうち、コンテンツを作成する「Designer」と、コンテンツは作成しないが、それに準じるコンテンツにアクセスする「Power Users」のグループをNVIDIA VGXのユーザーとして想定する。ただし、ユーザーの数が最も多い、アプリケーションを利用するだけの「Knowledge Worker」も将来的に対象ユーザーにする予定という。そして、当面においても、何らかの付加価値を提供できるソリューションを予定していると述べた。

GPUコンピューティングの仮想化を必要とする理由としてユーザーがそれぞれ個人的に用意するデバイスを使う「BYOD」の広がりがある(写真=左)。NVIDIA VGXを構成するのは、VGX BoardにVGX HyperVisor、そして、ユーザーが選んだデバイスだ(写真=中央)。NVIDIA VGXは、企業ユーザーのうち「Designer」と「Power User」を対象にする(写真=右)

GPUコンピューティングの仮想化を必要とする理由としてユーザーがそれぞれ個人的に用意するデバイスを使う「BYOD」の広がりがある(写真=左)。NVIDIA VGXを構成するのは、VGX BoardにVGX HyperVisor、そして、ユーザーが選んだデバイスだ(写真=中央)。NVIDIA VGXは、企業ユーザーのうち「Designer」と「Power User」を対象にする(写真=右)Keplerを“仮想化対応GPU”と呼ぶ理由とは

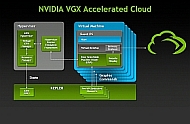

ウェイド氏は、“Kepler”世代のGPUで実装したハードウェア仮想化技術の構成と、従来世代のGPUと比べたメリットも説明した。“Kepler”世代のGPUは、GPUコンピューティングにおける仮想化とクラウドサービス利用を重視して開発したとされているほか、低レイテンシのリモートディスプレイ技術も導入する。また、データセンターにおける大量動作に耐えられる省電力設計も取り入れている。

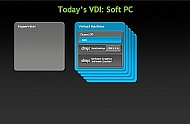

“Kepler”より前の世代におけるGPUコンピューティングの仮想化においては、HyperVisorの上に展開した仮想化マシンにおけるグラフィックス処理とエンコード処理をソフトウェアで処理していた。負荷の軽いグラフィックス処理やエンコード処理なら、このソリューションでも実用的な速度が出るが、ユーザーの数が増えたり(仮想化マシンの数が増えたり)、処理が高度になって負荷が高くなると性能が足りなくなる。ウェイド氏は、“Kepler”世代のGPUでは、GPU内部にハードウェアでこの処理を行うエンジンと、処理した結果を各仮想化マシンに直接配信するチャネルを設けることで、速い処理が可能になったという。

リモートディスプレイにおいても、“Kepler”世代より前のGPUで実現する仮想化マシンにおけるフローと、“Kepler”世代のGPUで実現する仮想化マシンにおけるフローを比較して、遅延時間を短縮できた理由を解説している。それによると、Keplerより前のGPUでは、GPUで描画した結果をGPUのフレームバッファに展開し、その内容をシステムメモリに用意した仮想化マシンにコピーし、それから、色変換仮想とネットワークで映像出力に適したH.264へのエンコード処理をソフトウェアで実行してネットワークに流していた。フレームバッファからシステムメモリ上でソフトウェアによる各処理に時間がかかるため、100ミリ秒以上の遅延が発生していたという。

Kepler世代のGPUで実装するNVIDIA VGXは、フレームバッファから仮想化マシンへのコピー、エンコード、ネットワークへの出力をすべてKeplerのハードウェアで行う。そのため、処理は10ミリ秒以下に過ぎず、CPUに対する負荷も発生しない。

Keplerより前の世代では、仮想マシンのグラフィックス描画とエンコードはCPUによるソフトウェア処理で行っていた(写真=左)。Kepler世代では、仮想マシンのグラフィックス描画とエンコードをGPUで行い、その結果を配信するチャネルもGPU内部で用意する(写真=中央)。リモートディスプレイも、フレームバッファに展開したデータをシステムメモリ上の仮想マシンにコピーして色変換、エンコード、ネットワーク送出としていたのが、Kepler世代なら、「NVENC」で処理することで10分の1の遅延で済む(写真=右)

Keplerより前の世代では、仮想マシンのグラフィックス描画とエンコードはCPUによるソフトウェア処理で行っていた(写真=左)。Kepler世代では、仮想マシンのグラフィックス描画とエンコードをGPUで行い、その結果を配信するチャネルもGPU内部で用意する(写真=中央)。リモートディスプレイも、フレームバッファに展開したデータをシステムメモリ上の仮想マシンにコピーして色変換、エンコード、ネットワーク送出としていたのが、Kepler世代なら、「NVENC」で処理することで10分の1の遅延で済む(写真=右)Teslaが載るサーバならVGX Boardは搭載可能

NVIDIAが投入を予定しているVGX Boardの構成は、Kepler世代のGPUを4基実装し、16Gバイトのメモリを載せる。厚さは2スロット分を要する。1基のVGX Boardで100ユーザー(1基のGPU当たりで25ユーザー)がアクセス可能とウェイド氏は説明する。

なお、同じKepler世代のGPUを利用した仮想化技術として「GeForce GRID」も発表している。オフィス利用を想定したNVIDIA VGXと異なり、主にゲームユーザーを想定するGeForce GRIDでは、1基のGPUで4ユーザーまでアクセス可能としていた。この違いについてウェイド氏は、エンコードの方法を高いフレームレートを必要とするGeForce GRIDと、低いフレームレートでも問題ないNVIDIA VGXで変えているためと説明している。

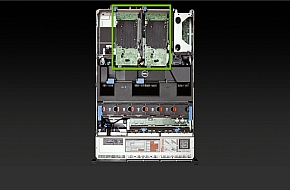

また、VGX Boardを搭載するサーバについては、最初に登場するVGX BoardのTDPは150ワット以下になる予定で、すでにTeslaを搭載するサーバにVGX Boardを搭載可能とウェイド氏は述べている。

最初のVGX Boardは、2012年の末に登場する予定で、Kepler世代のGPUを4基実装し、メモリは16Gバイト(GPU1基当たり4Gバイト)を載せる。TDPは150ワット以下となる見込みという(写真=左)。すでにTeslaに対応したサーバにVGX Boardは搭載できる(写真=右)

最初のVGX Boardは、2012年の末に登場する予定で、Kepler世代のGPUを4基実装し、メモリは16Gバイト(GPU1基当たり4Gバイト)を載せる。TDPは150ワット以下となる見込みという(写真=左)。すでにTeslaに対応したサーバにVGX Boardは搭載できる(写真=右)関連キーワード

GPU | NVIDIA | Kepler | 仮想化 | NVIDIA VGX | GPUコンピューティング | BYOD(Bring Your Own Device) | プラットフォーム | サーバ | GeForce GRID | NVIDIA Tesla | サーバ仮想化 | クラウドコンピューティング | Project Denver

関連記事

「KeplerがGPUの新しい時代を切り開く」──GTC 2012基調講演

「KeplerがGPUの新しい時代を切り開く」──GTC 2012基調講演

NVIDIAが開発を進めている「GPUによる仮想化」「GeForce Cloud」、そして、「Kepler II」の姿が、米国の技術会議で明らかに。その概要をまとめてチェック。 すべてのコンピュータはヘテロジニアスを目指す──NVIDIAがProject Denverで目指すもの

すべてのコンピュータはヘテロジニアスを目指す──NVIDIAがProject Denverで目指すもの

“最も電力効率が高いCPUコア”とGPUを組み合わせたヘテロジニアス・コンピューティングを推進するNVIDIA。彼らが考える“最も電力効率が高いCPUコア”とは? 「このままではエクサスケール実現にフーバーダムが必要」──NVIDIAが語る“GPUの必然性”

「このままではエクサスケール実現にフーバーダムが必要」──NVIDIAが語る“GPUの必然性”

NVIDIAがHPCで必ず言及するエクサスケールコンピューティングについて、GTC Asiaの舞台となった北京でも、若い技術者に向けて同社のGPUが必須であると訴える 20メガワットエクサスケールは破壊的イノベーションで実現する

20メガワットエクサスケールは破壊的イノベーションで実現する

HPCで必要なエクサスケースコンピュータでは、消費電力の抑制が必須だ。NVIDIAは、GPUコンピューティングによる“脱CPU依存”がHPCの進化に不可欠と訴える。 エクサを目指せ!──「NVIDIA GTC Workshop Japan 2011」基調講演

エクサを目指せ!──「NVIDIA GTC Workshop Japan 2011」基調講演

NVIDIAが開発者向けに行うテクニカルイベントのために共同設立者が来日。エクサスケールが求められるGPUコンピューティングの未来を語った。 NVIDIAが明らかにした「Fermi」の次

NVIDIAが明らかにした「Fermi」の次

NVIDIAの技術イベントで、Fermiに続く次世代GPUアーキテクチャの存在が明らかになった。GTCで分かった“開発コード名”が示唆する「NVIDIAが進む道」とは?

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

アクセストップ10

- バッファロー製Wi-Fiルーターに脆弱性 対象機種は今すぐファームウェア更新を (2024年04月17日)

- ノートPCに外付けキーボードを“載せて”使える「タイプスティックス/打ち箸」に新色 (2024年04月18日)

- ついに8K対応した「Insta360 X4」の画質をX3と1インチ360度版で比較 今買うべき全天球カメラだと確信した (2024年04月16日)

- さらなる高速化を実現! PCI Express 5.0接続SSDの新モデル「Crucial T705」を試して分かったこと (2024年04月18日)

- SwitchBotのミニプラグに不具合 「断続的にオン/オフを繰り返す、異音」などで該当製品の交換を呼びかけ (2024年04月17日)

- アイロボットが4万円切りの「水拭き対応ロボット掃除機」を投入 “一家に1台”を目指す (2024年04月17日)

- 無線LANルーター「Aterm」シリーズの一部に複数の脆弱性 設定変更や買い替えをアナウンス (2024年04月11日)

- あなたのPCのWindows 10/11の「ライセンス」はどうなっている? 調べる方法をチェック! (2023年10月20日)

- 「JBL GO 4」でBluetoothスピーカーデビュー! 累計出荷台数5700万台を突破した人気製品の最新モデルを試す (2024年04月17日)

- NVIDIA、Ampereアーキテクチャを採用したシングルスロット設計のデスクトップ向けGPU「NVIDIA RTX A400/A1000」を発表 (2024年04月17日)