日本マイクロソフトが最新研究成果を紹介――「2014 Technology Update」:新型Kinectのデモも披露

日本マイクロソフトは1月27日、同社における研究・開発の最新動向を伝える「2014 Technology Update」を実施した。登壇したのは、マイクロソフトディベロップメントの代表取締役社長と日本マイクロソフトの最高技術責任者を兼任する加治佐俊一氏だ。

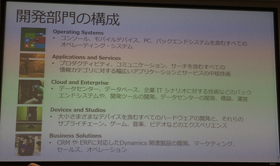

同氏はまず、マイクロソフトが「デバイス&サービス」を提供する会社へと大きく舵を切る中で、研究・開発部門の構成や開発モデルがどう変革してきたかを説明した。

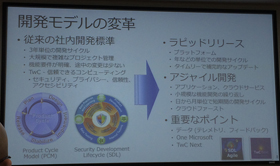

最も顕著なものでは、これまで3年単位で行われてきたOSの開発サイクルが、Windows 8から1年でWindows 8.1をリリースしたように、より短いサイクルで行われていると解説。アプリケーション開発も同様にアジャイル開発を導入し、月/週単位などで小規模な機能開発を繰り返し手法へと切り替えたという。

また、例えば、Exchange ServerとExchange Onlineの機能開発では後者を優先させるといったように、タイムリーなアップデートを迅速に行う“クラウドファースト”を推進するほか、今後は「デスクトップとタッチだったら“タッチファースト”になるだろう」と述べ、モバイルデバイス向けのアプリ開発に注力することを示唆した。その成果の1つとして、2013年11月にアップデートしたOneNoteのカメラキャプチャ機能を紹介。Surfaceで撮影した紙の資料を自動的に補正してクリップし、OCR処理をかけて検索可能にする様子をデモで示した。

開発部門の構成は、従来の9部門から5部門へ統合。OS部門はデバイスによらずすべてのOSを開発するようになり、“One Microsoft”のスローガンを掲げて部門間の連携を取りやすい体制に移行しているという。これにともない開発サイクルも大きく変革している

開発部門の構成は、従来の9部門から5部門へ統合。OS部門はデバイスによらずすべてのOSを開発するようになり、“One Microsoft”のスローガンを掲げて部門間の連携を取りやすい体制に移行しているという。これにともない開発サイクルも大きく変革している続いて加治佐氏は、同社の研究部門であるMicrosoft Researchの取り組みを紹介した。1991年に設立されたMicrosoft Researchは、現在世界に7つの研究所を要し、博士号を持つ1100人の研究者が従事している。

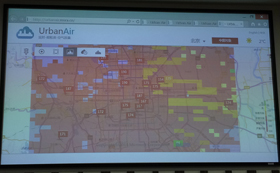

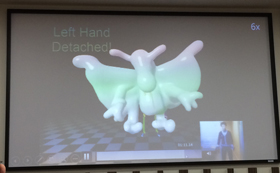

同氏は主な研究成果として、都市に設置した物理的なセンサーとソーシャルネットワーク上の情報を組み合わせて都市内の変動を解析し、渋滞や大気汚染の状況を予測するアーバンコンピューティングや、2012年に披露した「Talking Head」(表情と音声をリアルタイムで合成する技術)をより手軽かつ高精度に改良した「3D FACE」、3Dプリンタで印刷されるオブジェクトの強度や重心などをソフトウェア的に最適化する技術、さらにはKinectとBluetoothセンサーを使って簡単に3Dアバターを制作できる「Body Avatar」などを紹介した。

加治佐氏は最後のトピックとして、次世代のNUI(ナチュラルユーザーインタフェース)を実現する新型Kinectセンサー(Kinect for Windows v2)も紹介した。新型Kinectは、1080p(30fps)対応のHDカメラとアクティブIRカメラを備え、広視野角かつ高いユーザー認識精度と、ノイズ除去マイクアレイによる自然な言語での音声認識が特徴。同氏は、新型Kinectが25個の関節をトラッキングしたり、体をひねった際の部位の向き、手の向きなどを認識できることを紹介したほか、実際のデモを交えながら、加速・加重の認識、体表面の温度変化によって心拍数を計測できる様子を示した。

なお、これらの研究成果は3月に行われる「TechFest 2014」でWeb公開される予定だ。

関連記事

2014 International CES:「SFから現実へ」 インテルが推進する“タッチの次”の技術──「RealSense」

2014 International CES:「SFから現実へ」 インテルが推進する“タッチの次”の技術──「RealSense」

インテルが2014 International CESで「NII」を実現する“タッチの次”のユーザーインタフェース技術を正式に発表。それは何か。 ミクさんが実在する世界:観測せよ、世界はそこにある! Oculus Riftで人の作りし「世界」へ

ミクさんが実在する世界:観測せよ、世界はそこにある! Oculus Riftで人の作りし「世界」へ

現実を忘れるOculus Riftの魅力。あざといなさすがLat式あざとい。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

アクセストップ10

- ワコムが有機ELペンタブレットをついに投入! 「Wacom Movink 13」は約420gの軽量モデルだ (2024年04月24日)

- わずか237gとスマホ並みに軽いモバイルディスプレイ! ユニークの10.5型「UQ-PM10FHDNT-GL」を試す (2024年04月25日)

- 「社長室と役員室はなくしました」 価値共創領域に挑戦する日本IBM 山口社長のこだわり (2024年04月24日)

- 「Surface Go」が“タフブック”みたいになる耐衝撃ケース サンワサプライから登場 (2024年04月24日)

- QualcommがPC向けSoC「Snapdragon X Plus」を発表 CPUコアを削減しつつも圧倒的なAI処理性能は維持 搭載PCは2024年中盤に登場予定 (2024年04月25日)

- 16.3型の折りたたみノートPC「Thinkpad X1 Fold」は“大画面タブレット”として大きな価値あり (2024年04月24日)

- あなたのPCのWindows 10/11の「ライセンス」はどうなっている? 調べる方法をチェック! (2023年10月20日)

- アドバンテック、第14世代Coreプロセッサを採用した産業向けシングルボードPC (2024年04月24日)

- AI PC時代の製品選び 展示会「第33回 Japan IT Week 春」で目にしたもの AI活用やDX化を推進したい企業は要注目! (2024年04月25日)

- ロジクール、“プロ仕様”をうたった60%レイアウト採用ワイヤレスゲーミングキーボード (2024年04月24日)

日本マイクロソフト最高技術責任者の加治佐俊一氏

日本マイクロソフト最高技術責任者の加治佐俊一氏