“AI社会の到来”を見据える国内事業者が説く基盤構築の難しさ 有力な選択肢「GMO GPUクラウド」とは

AIを競争力の源泉にするために、企業自らAI開発に乗り出すケースが増えている。しかし、多くの担当者が「AI開発基盤をどうするか」という壁に直面している。GMOインターネットでAI開発基盤の設計開発とプリセールスを手掛ける木村洸太氏は、顧客の声から実情をこう語る。

「『自社のデータで独自モデルを開発したい』というニーズからオンプレミスで基盤構築を検討するものの、どのGPUを選ぶべきかといった投資判断に迷う例が散見されます」

この投資判断の難しさは、AI開発基盤における課題の一面にすぎない。GMOインターネットの川村周氏も、問題の根深さをこう指摘する。「NVIDIAからは毎年新しいGPUのロードマップが示され、市場は常に進化しています。その中で性能と価格のバランスを見極め、今が投資のタイミングかどうかを判断するのは非常に難しいものです」

AI開発基盤の“正解”に「誰もが」「すぐに」たどり着ける

オンプレミスでGPUを導入する場合、高額な投資が伴う。費用対効果を高めるためには効率的な活用を可能にする運用管理が求められるが、そのためにクリアすべきハードルは高い。例えば複雑な環境構築や、学習と推論で異なるGPU環境を最適化するといった作業が必要になる。GPUリソースを最大限生かそうとするほど、技術とコスト両面の課題は増す。

川村周氏(GMOインターネット ドメイン・クラウド事業本部 プロダクトマネジメントチーム リーダー)

川村周氏(GMOインターネット ドメイン・クラウド事業本部 プロダクトマネジメントチーム リーダー)

さらに、GPUを調達しただけでは不十分である点も企業を悩ませている。川村氏は「大量のデータを扱うためには、十分な性能を有するストレージやネットワーク機器も整備しなければなりません。GPUを手にしたとしても、その性能を最大限発揮できるとは限らないのです」と説く。

本格的なAI活用を見据えるほど、GPUの選定、投資時期、周辺機器との連携、学習と推論という異なる需要への対応など課題は複雑化する。「GPUさえあればAI開発ができる」という安易な理想像は、この現実の前では容易に打ち砕かれてしまうのだという。

この複雑な課題に対する一つの正解として、GMOインターネットは「GMO GPUクラウド」を提供している。最新GPUを中心に据えた高水準のAI基盤を、契約後すぐに開発に着手できる環境として提供するサービスだ。

その本質的な価値は、基盤選定のあらゆる悩みから企業を解放することにある。川村氏は、「NVIDIA推奨構成をフルセットで提供するため、お客さまは基盤を意識せず、本来取り組みたい学習やPoC(概念実証)といったコア業務にすぐに集中できます」とその価値を語る。

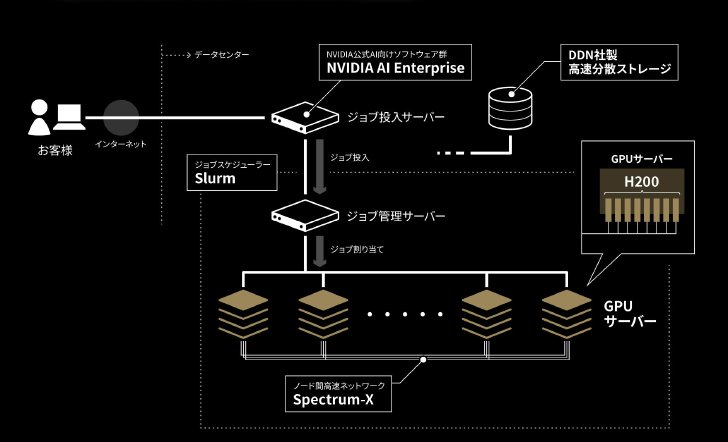

GMO GPUクラウドは、専門家が何週間もかけるような「煩雑な環境構築」をどのような仕組みで不要にしているのか。物理的な基盤となっているのが「NVIDIA H200」をメインに据えたハードウェア構成だ。GPUの性能を引き出す高速ネットワークや高速ストレージを組み合わせることで、圧倒的な処理速度を実現する。

そして、これらの強力なリソースを管理する核心がワークロード管理システム「Slurm Workload Manager」(以下、Slurm)の標準搭載だという。Slurmは、GPUリソースを効率的に割り当てるジョブスケジューラであり、ジョブ単位でGPUタスクを実行して自動的にスケジュールを最適化する。これにより、開発者間の面倒なリソース調整が不要になり、計算資源の利用効率を最大化できる。

「AI開発者の多くにとって、インフラ基盤の構築・運用は専門外の領域です。そうした中で、限られるGPUリソースを社内でいつ、誰が、どのくらい使うかといった調整が必要になります。その点で、Slurmが標準搭載されていることの意義は非常に大きいと言えます」(木村氏)

利用形態の柔軟性もクラウドならではの強みだ。オンプレミス環境を構築するには巨額の初期投資が必要だが、GMO GPUクラウドは小規模な利用から開始でき、結果を見ながら段階的に拡大できる。リソースはSlurmで最適化されるので、時間課金によって試行的な利用から本格導入まで幅広く対応できる点も支持されている。

さらにGMO GPUクラウドは、利用者が環境構築を意識せず開発に集中できる「PaaS」に加え、インフラを自由に構築できる「IaaS」も提供予定だ。基盤を自ら作り込みたい企業から、すぐに開発を始めたい企業まで双方のニーズに応えられるようになる見込みだという。

開発環境もフル装備 「NVIDIA AI Enterprise」標準搭載

GMO GPUクラウドには開発そのものを加速させる仕組みも標準で備わっている。それが、NVIDIAのエンタープライズ向けAI開発支援ソフトウェアスイート「NVIDIA AI Enterprise」だ。

通常であればGPUカードごとに高額なライセンス契約が必要だが、GMO GPUクラウドのユーザーは追加費用なく利用できる。これは、最先端のツールを積極的に試したい企業にとって大きな魅力だ。川村氏は、そのメリットを「普段は触れないソフトウェアやライブラリを試せる上、ライセンス契約によってNVIDIAへ優先的に質問できるため、開発の効率が高まります」と語る。

複雑な問いの数々に対してシンプルかつ強力な答えを提示し、すぐに“最適な環境”でAI開発を始められる──それがGMO GPUクラウドの提供価値と言えるだろう。

開発環境への「安心」とハイレベルな「性能」

とはいえ、煩雑な環境構築を不要にする仕組みは本格的なAI開発への入り口にすぎない。故障や障害などへの対応リソースを割くことなく長時間の計算処理を安定して実行できる「安心」の運用体制と、開発サイクルを加速させる「性能」が伴って、初めてその価値は最大化される。

その「安心」を支える体制について、木村氏は「GMO GPUクラウドは、24時間365日の監視体制を整えています。GPUは突発的に故障することもありますが、契約ノードに故障が発生した場合は当社が無償で他のノードに交換します。お客さまが対応する必要はなく、当社側で全てを処理するため、安心して開発に専念できます」と断言する。

企業は余剰ノードの追加コストやダウンタイムのリスクを案じることなく、長期的な計算処理を継続できる。利用者が不安を抱かず、すぐに使いこなせるように操作ドキュメントやチュートリアル、動画教材も用意されているというから心強い。

一方で「性能」の裏付けとなっているのが、世界的なスーパーコンピュータ性能ランキング「TOP500」での実績だ。NVIDIA推奨構成による高性能GPUクラスタは、2024年11月に発表された同ランキングで世界37位、国内6位にランクインした。木村氏は「日本国内の商用サービスの中でもハイレベルな性能と、それらを引き出すためのチューニングを可能とするエンジニアが運用しているという運用品質――この2つの証明ができたと思っています」と胸を張る。

この実績は、AI学習や大規模データ処理を高速かつ安定的に行えるNVIDIA推奨環境を構築した同社ならではの強みだ。「開発を加速する」運用体制と世界が認める処理性能。この2つが両輪となり、本格的なAI開発の基盤を形成している。

大規模モデル開発からスタートアップまで 多様なユースケース

GMO GPUクラウドは、どのような企業のAI開発に特に有効なのか。そのユースケースは、2つの軸で捉えることができる。1つ目は、LLM(大規模言語モデル)をはじめとした新規AIモデル開発や、既存モデルを自社データでファインチューニングするといった大規模な学習が必要な企業だ。こうした開発では、膨大なデータを扱うための高性能な計算基盤が不可欠となる。

木村洸太氏(GMOインターネット システム本部 IaaSチーム)

木村洸太氏(GMOインターネット システム本部 IaaSチーム)

木村氏は「GMO GPUクラウドは、特に大規模データを扱う学習において強みが顕著に現れます。大規模なデータを繰り返し利用する際も、最適化されたインフラとSlurmの自動リソース管理により、開発者は計算資源を最大限活用して効率的に結果を出せます」と語る。

実際に自動運転分野の顧客は、日々の走行で蓄積される膨大なデータを同サービスに取り込み、モデルの学習に活用しているという。川村氏はその効果をこう強調する。「通常であれば膨大な時間とコストを要する処理も、最適化された環境によって開発サイクルを短縮し、結果的にコストメリットを高めることができます」

そして2つ目は、AIスタートアップや、新規にAIチームを立ち上げた企業だ。GMO GPUクラウドは煩雑な基盤構築に時間を取られることなく、エンジニアリソースが限られる企業でも契約直後からサービス開発そのものに集中できる環境を提供する。小規模に試行を始め、結果を見ながら段階的に拡張できる柔軟性は、スタートアップにとって大きな安心材料となるだろう。

NVIDIAと共に「デファクト」を追う理由

GMO GPUクラウドの根幹を支えているのは、AI開発のデファクトスタンダードとなっているNVIDIAとの強力なパートナーシップだ。

木村氏は、「当社は国内のAI開発基盤を加速させるという使命感を持っています。NVIDIAの最新GPUをいち早く提供して、日本のAI産業全体の技術革新と競争力向上に貢献したいと考えています」と力説する。

その使命感を示す象徴的な取り組みが、NVIDIAの次世代GPU「NVIDIA Blackwell Ultra GPU」を搭載した「NVIDIA HGX B300」(以下、NVIDIA B300)搭載クラウドサービスの提供決定だ。この新世代GPUは、特に推論の処理性能を飛躍的に向上させており、AIサービスの応答速度などを大幅に短縮できる可能性を秘めている。

川村氏は、最新技術をいち早く導入する価値をこう強調する。「AIサービスやAI研究の競争環境では、最新かつ最高性能のGPUをいかに早く利用できるかが差別化の決め手になります。当社のサービスであれば、契約後すぐに最新技術を試せるためお客さまはよりスピーディーに開発できます」

最新技術への迅速な対応は、開発速度だけでなく長期的な安定運用にもつながる。新世代の環境に速やかに移行することは、結果としてタイムスケジュールやコストパフォーマンスの面でも大きな優位性をもたらす、というのが同社の考えだ。

GPUクラウドから描く、AI社会の未来

GMOインターネットグループは、これまでもインターネットの根幹を支える基盤を提供してきた。その歴史の延長線上にあるのがGMO GPUクラウドであり、AIが社会に浸透する時代に不可欠な新たな基盤として位置付けられている。

川村氏はビジョンをこう語る。「今後、人手不足が深刻化する日本ではヒューマノイドロボットなどが普及するでしょう。その『脳』を育てる計算基盤として、GPUクラウドは社会に貢献できると考えています。当社は『AIで未来を創るNo.1企業グループへ』というスローガンの下、AI時代の新たな基盤提供者として日本発のイノベーションを支えていきます」

GMOインターネットは、2025年10月17日に開催される「CTC DISCOVER 2025」で、その先進的な取り組みを披露する。セッションには木村氏が登壇し、NVIDIA B300搭載により進化を遂げるGMO GPUクラウドの今後の展開と将来展望について詳しく語る予定だ。

AI開発基盤の新たなスタンダードを目指すGMO GPUクラウド。その最前線に、イベントで触れてみてはいかがだろうか。

CTC DISCOVER 2025開催

【イベント名】CTC DISCOVER 2025

【開催日時】2025年10月17日(金)10:00~18:30

【セッション】生成AI時代に向けたBlackwell GPU基盤導入計画 ― GMOの取り組み(ノベルティあり)(17:00~17:40)

【会場】グランドプリンスホテル新高輪 飛天・国際館パミール

【応募方法】事前登録制(無料)

【応募期間】2025年10月15日(水)まで

Copyright © ITmedia, Inc. All Rights Reserved.

GMOインターネット株式会社、伊藤忠テクノソリューションズ株式会社

アイティメディア営業企画/制作:ITmedia AI+編集部/掲載内容有効期限:2025年10月18日