Google、プライバシー保護と性能の両立目指すLLM「VaultGemma」発表:AIニュースピックアップ

Googleが、ユーザーのプライバシー保護とLLMの性能を両立させたAIモデル「VaultGemma」を公開した。その性能や課題を紹介する。

Googleは2025年9月12日(米国時間)、プライバシーの保護に特化した大規模言語モデル(LLM)「VaultGemma」を開発したと発表した。

従来のLLMには、訓練データに含まれるプライバシー情報を記憶し、意図せず漏えいさせるリスクがある。VaultGemmaは、個別の学習データの詳細を記憶せずに、プライバシーを守りながら高性能な出力が可能な点が特徴だ。

ユーザーのプライバシー保護を実現したLLM その仕組みと性能、課題とは

VaultGemmaに利用されている中核技術が「差分プライバシー」(DP)だ。DPは、個人情報を含むデータに意図的なノイズデータを加えることで、データ全体の統計情報から特定の個人を識別できないようにする技術だ。VaultGemmaは、GoogleのオープンソースのAIモデル「Gemma」をベースに差分プライバシーを適用して訓練されたモデルを基盤としており、パラメータ数は10億(1B)。

しかし、VaultGemmaには課題もある。

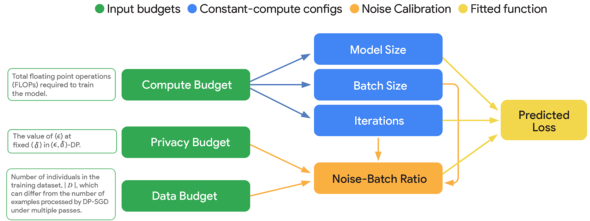

DPをLLMの学習に適用すると、LLMの性能や精度が低下しやすくなったり、計算コストが増加したりする。VaultGemmaの研究チームは、この問題を解消するため、計算量、データ量、プライバシー強度のバランスからLLMの最良の性能を引き出すための理論的な枠組み「DPスケーリング則」を確立した。

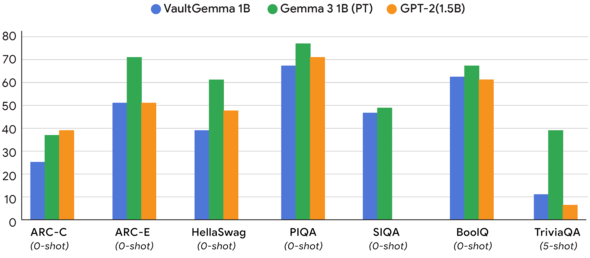

性能評価はどうか。VaultGemmaとGemmaモデルを比較した結果をGoogleは公開している。「Gemma 3」(パラメータ数1B)やOpenAIの言語モデル「GPT-2」(パラメータ数1.5B)と比較した結果、VaultGemmaはGemma 3には及ばないものの、2019年に公開されたGPT-2に匹敵する性能を示している。

VaultGemmaは、モデルの重みを公開した「オープンウェイトモデル」であり、誰でも利用できる。モデルの重みは「Hugging Face」と「Kaggle」で公開されている。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

トレンドは生成AIから「ソブリンAI」へ Gartner、行政サービスのハイプ・サイクル2025を発表

トレンドは生成AIから「ソブリンAI」へ Gartner、行政サービスのハイプ・サイクル2025を発表

Gartnerは2025年の行政サービスのハイプ・サイクルにおいて、ソブリンAIとAIエージェントを中核技術と位置付けた。各国政府がテクノロジー主権や市民対応の自動化を推進する中、日本でも導入が進むと予測される。 OpenAIがMicrosoftと提携強化 非営利組織による再資本化の狙い

OpenAIがMicrosoftと提携強化 非営利組織による再資本化の狙い

OpenAIはMicrosoftとの新たな提携段階として覚書に署名し、非営利組織が公益目的会社(PBC)を支配する体制で再資本化する計画を発表した。AIの安全性と公共利益の両立を目指す体制を構築する。 エージェント型AI導入、26年に25%に拡大見込み 経営層が挙げる導入のメリット

エージェント型AI導入、26年に25%に拡大見込み 経営層が挙げる導入のメリット

IBMはAIエージェントに関する日本企業の導入状況と将来展望を調査し、現在3%の導入率が2026年には25%へ拡大すると予測している。経営層はAIを業務の中核と位置付け、業務効率や財務成果への寄与を期待している。