Google、大規模データ処理基盤「Cloud Storage Rapid」発表 AI学習効率を改善:ITニュースピックアップ

Googleは、AI用途の高速オブジェクト保存群「Cloud Storage Rapid」を発表した。専用バケットとキャッシュ機能でGPUやTPUの待機時間を減らし、学習や推論、分析処理の読み込み性能を改善する

Googleは2026年5月12日(現地時間)、AI用途の大規模データ処理基盤「Cloud Storage Rapid」を発表した。生成AIや分析処理で急増するデータ負荷へ対応する狙いがある。新製品群は、高性能オブジェクト保存機能「Rapid Bucket」と、高速読み込み機能「Rapid Cache」で構成する。

GPU待機時間削減へ Googleが保存基盤を再設計

生成AI開発において、数千台規模のGPUやTPUを使う学習環境が一般的になりつつある。演算装置の性能向上が続く半面、保存装置側の処理速度不足が全体性能を制約する場面が増えていた。学習時のデータ読み込みやチェックポイント保存で遅延が発生すると、高価な演算資源が待機状態となり、運用効率低下へ直結する。

Googleは、従来型オブジェクト保存基盤では現代AI処理需要へ十分対応しにくい状況に達したと説明する。Cloud Storage Rapidにおいて、演算環境と保存装置を同一ゾーンへ近接配置し、I/O待機時間を減らす設計を採用した。Google内部基盤「Colossus」を活用し、高速読み込みと低遅延処理を実現する。Googleは「Gemini」や「YouTube」でも同基盤を利用している。

性能面において、毎秒2000万クエリ処理とサブミリ秒級遅延へ対応する。単一ゾーンバケットで毎秒15TB超の読み込み帯域も備える。新機能として、追記書み込み、書み込み中同時読み込み、ベクトル読み込み機能も導入した。

AI学習用途において、GPU待機時間を半減し、マルチモーダル学習時のデータ読み込み速度を最大2.5倍へ高めた実績を示した。チェックポイント復旧は最大5倍高速化し、書き込み速度は従来比3.2倍へ達した。障害復旧時間短縮により、学習停止による損失抑制も狙う。

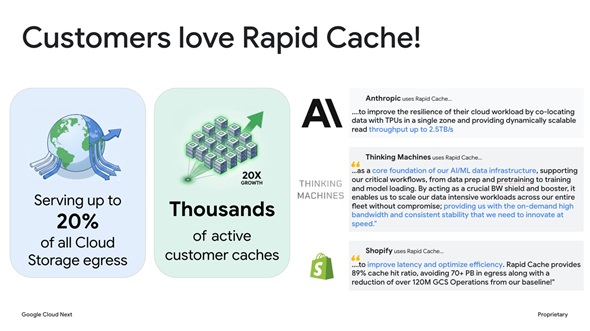

Rapid Cacheは既存バケットへ追加適用できる高速読み込み機能だ。コード変更不要で利用でき、推論処理時のモデル読み込み高速化に役立つ。Googleによると、最大2.1倍の読み込み高速化と47%の総保有費用削減効果を確認する。

新機能「ingest on write」も追加されている。従来は、キャッシュ登録前に初回読み込み処理が必要だった。新機能において、Cloud Storage書き込み時に同時キャッシュ登録を実施する。初回読み込み時から高速化効果を得られる点が特徴だ。Googleは、チェックポイント復旧時間を最大2.2倍短縮できると説明する。

Rapid Cacheは急速に導入数を伸ばしている。一般提供開始後1年間で配備数は20倍へ増加した。Cloud Storage全体の外向き通信量の最大20%を処理する水準へ達した。

同社はマルチリージョンバケットとの組み合わせで、地域をまたぐGPU群運用も容易になったと説明する。階層型名前空間機能によるSpark処理最適化も進み、大規模データ前処理効率向上につながった。Googleは、Rapid BucketをAI学習や分析処理、モデル提供用途へ投入し、Rapid Cacheを学習復旧や推論処理高速化用途へ展開する方針を示した。AI計算基盤拡大が進む中、保存装置性能強化が次世代クラウド競争の重要分野となりつつある。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

米2強が狙う“AI社員”の普及 Anthropicは「業務代行」、OpenAIは「運用プラットフォーム」

米2強が狙う“AI社員”の普及 Anthropicは「業務代行」、OpenAIは「運用プラットフォーム」

AnthropicのCoworkとOpenAIのFrontierは、AIが実務をこなす時代の到来を象徴している。ビジネスの現場はどう変わるのだろうか。 三菱UFJ銀行「生成AIロールプレイング」採用 仮想顧客との商談訓練を開始

三菱UFJ銀行「生成AIロールプレイング」採用 仮想顧客との商談訓練を開始

三菱UFJ銀行は、生成AI活用の営業訓練ツール「Finatext AI 営業アシスト -AIロールプレイング-」を採用した。音声による仮想顧客との対話を通じ、複雑化する保険販売の提案力強化と人材育成の効率化を図る。 北陸銀行が音声AIを試験導入 パンク状態の窓口を自動化し「あふれ呼」を解消へ

北陸銀行が音声AIを試験導入 パンク状態の窓口を自動化し「あふれ呼」を解消へ

北陸銀行は、音声AIエージェント「AI Worker VoiceAgent」の試行導入を開始した。法人向けインターネットバンキングのFAQ対応を自動化することで、電話集中時に発生する「あふれ呼」や待機時間の増加といった課題の解消を目指す。 データ入力も運用もプロに丸投げ IT担当者がいない現場を助ける新サービス提供開始

データ入力も運用もプロに丸投げ IT担当者がいない現場を助ける新サービス提供開始

4Stellaは、中小企業で起きる「DXの停滞」に対応するため、実務代行型の支援サービスの提供を開始した。導入後の運用からデータ入力、AI活用までを一体的に担い、建設や製造、物流分野における業務改善や投資回収を後押しする。