| News | 2003年1月22日 07:27 PM 更新 |

ec2003レポート

実写アバターも可能にする手軽な自由視点映像システム

映画「Matrix」などで知られる“自由視点映像”は多数のカメラから撮った画像を元に合成している。このため従来は非常に高価だったが、これをより簡易に作成できるシステムの研究が進められている

日本VR学会エンタテインメントVR研究会の「エンタテインメント仮想環境」と題されたミニセミナーでは、慶応義塾大学 理工学部情報工学科 助教授/科学技術進行事業団さきがけ研究21の斎藤英雄氏による「自由視点映像生成」がたいへん興味深かった。

より手軽な自由視点映像の生成

自由視点映像というのは、映画のMatrixや、ソードフィッシュで話題になった、空間中の物体を自由な位置から見ることができる映像のこと。その後、NFLスーパーボール中継用に、カーネギーメロン大学とCBSが「EyeVision」などを開発している。

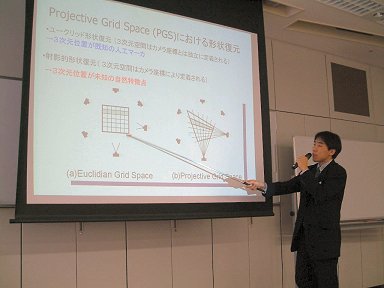

慶応義塾大学 理工学部情報工学科の斎藤英雄助教授。「自由視点映像生成」のソフトを試作している

この「自由視点映像」は、基本的には多数の(静止画)カメラを連続的に合成することで、ひとつの空間を作り出している。

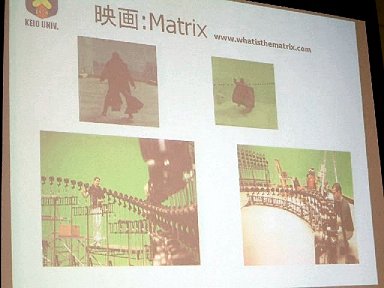

ふんだんに予算のある映画の場合には、そのカメラの規模はかなり大掛かり。マトリックスでは120台、ソードフィッシュでは200台のカメラを使っている。スポーツ中継でも、CMU(カーネギーメロン大学)でのVirtualized Realityでは、50台のカメラを使った。言い換えれば、自由視点映像というのは、かなり金のかかるシステムなのである。

斎藤助教授のプレゼンテーションより、映画Matrixの撮影風景。1列に並んだカメラが迫力

だが、コンピュータの技術の常として、当初は天文学的な金額がかかっていたものであっても、しばしば数年程度のうちに、価格が1/10、1/100に下がるもの。静止画だけではなく、CGを使うことで、よりポピュラーに、汎用的に自由視点映像を作り出そうというのが、斎藤助教授らの研究である。一口でいえば、2台のカメラの映像から、その間の映像を作り出していこうというわけだ。

このような研究は、ほかに、京都大学の松山研究室が10台のカメラを使った自由視点映像に取り組んでいるという。

カメラの台数が減ることによる技術的なメリットは数多い。

まず、多視点カメラ間のキャリブレーションがなくなるか、少なくなる。

多視点カメラのためにカメラのキャリブレーションをし、それが実際にタイミングよく動作するように設定するのは、たいへんに難しい作業なのだそうだ。16台のカメラを使って同様の研究を行ったNECのインターネットシステム研究所ユビキタスシステム担当の早川敬介氏によれば、「水平の調整がたいへん重要です。カメラの色のばらつきを調整する必要もあります」とのこと。台数が減れば、それだけ調整の手間は激減する。テストでは、比較的適当に置いたカメラからの合成でそこそこの効果を得られたという。

ソフトウェア的にも、キャリブレーションが難しい。そこで、「キャリブレーションをしなくてもよいようなものを考えました」と斉藤助教授。画像の対応を取るだけでよい弱校正(じゃくこうせい)システムを作り出した。ただしこれは万能ではなく、大きさや形の推定は不可能で、射影にもゆがみが生じることがあるという。とはいえ、映像としてディスプレイに表示するときには、2次元なので、さほどゆがむという感じもしない。

計算で形状を復元すると、実際の空間(左)に較べて、右のようにゆがんだ像が生成されることがある。ただし、最終的にディスプレイは2次元なので、実際のゆがみほどゆがんだ感じは受けないとのこと

実験の結果、5台程度のカメラでも、かなりなめらかな動画を得られるということがわかったそうだ。

これがやがてゲーム機に応用されていけば、プレイヤー自身が実写アバターとしてゲームのなかに登場して、プレイできるということになる。

ちなみに、この試作映像。「ビデオはすでに公開していています。ソフトも、いま程度のものであれば、公開していきたいと思う」と斎藤助教授は述べる。ソフトはWindows用とのことである。ただし、現時点では映像を合成するための前処理が必要であるとのこと。希望者には提供できるということなので、興味のある方はぜひ問い合わせてみてはいかがだろうか。ユーザーが試せるシステムが、早期にリリースされると、ますます楽しさも増しそうだ。

実験では(a)(b)ふたつの映像から、(e)を合成した。同じ位置で実際に撮影した(d)と、合成映像の(e)を較べてみても、細部はともあれ、遜色ない感じになる

関連記事

関連リンク

[美崎薫, ITmedia]

Copyright © ITmedia, Inc. All Rights Reserved.