Google、全身キャプチャと深層学習で3Dアバター生成 任意のシーン、照明に合わせレンダリング可能

既存の全身キャプチャシステムを改良し、ディープラーニング技術を投入することで、フォトリアリスティックな3Dアバターを実現する。

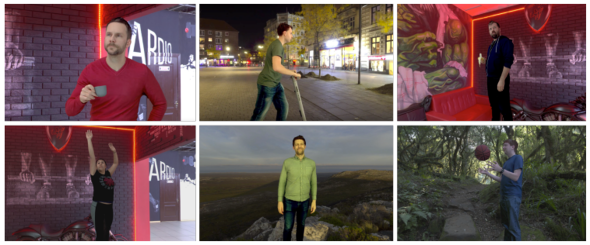

Googleの研究チームは、 ディープラーニング(深層学習)と独自の撮影機材を用い、3Dアバターを生成できるパフォーマンスキャプチャーシステム「The Relightables」を開発した。従来は難しかった、任意のバーチャル環境に合わせ、照明の当たり方を変える「再ライティング」が可能になり、表現のリアリズムレベルを大きく引き上げられる。

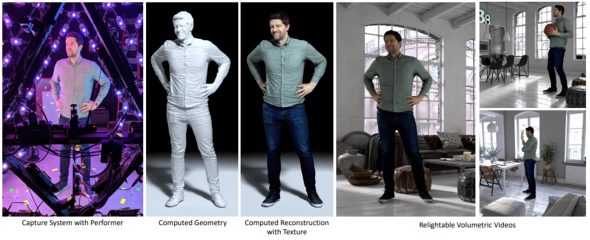

Googleは、ボリュームキャプチャーシステム「LightStage」のカスタマイズ版を用い、捉えた人の動きをバーチャル環境で写実的にレンダリングする手法を研究・開発している。

LightStageは、全方位に複数の照明とカメラを配置した直径3.5メートルの球形ドーム型キャプチャーシステム。大量の照明を制御しながら形状や質感を高精度で読み取れる。このLightStageをカスタマイズし、複数の深度センサーなどを設置することで、新たなボリュームキャプチャーシステムを構築した。

具体的には、58台のRGBカメラ、32台のIRカメラ、16台の構造化照明パターンを投影できるプロジェクター、331個のカラーLEDライトで構成される。

こうしてキャプチャーしたデータから、ディープラーニングで高品質な3Dモデルを作成。2種類の異なる照明画像から反射マップも推定する。これにより出力した人体の3D映像は、どんなバーチャル環境でも正確な照明条件で再構築され、リアルに表現できるとしている。

類似研究と比べても、任意のCGシーンでレンダリングする3Dアバターのリアリズムレベルを大幅に向上させている。メガネなどの透明で鏡面がある素材や、髪の毛などの細いジオメトリの再構築が今後の課題としている。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

3D画像、触覚、音を空中に同時生成 超音波ディスプレイ、東京理科大など開発

3D画像、触覚、音を空中に同時生成 超音波ディスプレイ、東京理科大など開発

視覚、聴覚、触覚の3つの感覚に訴える超音波ディスプレイを、東京理科大などが開発した。 ドローンとアクションカムで人の生死を判定 イラク・豪州の研究チームが開発 空から心肺運動を分析

ドローンとアクションカムで人の生死を判定 イラク・豪州の研究チームが開発 空から心肺運動を分析

ドローンとジンバル、アクションカムの組み合わせで災害時の要救助者の生死判定が可能になった。 昆虫に学べ 小型ドローン群で災害時の人命探索

昆虫に学べ 小型ドローン群で災害時の人命探索

自律飛行しながらも計算量を減らし、冗長性も確保できる方法が、昆虫の行動を参考に考案された。