ニュース

唇の動きを読み取ってその人らしく音声合成 インド工科大「Lip2Wav」開発:Innovative Tech

音声が不完全もしくはない状態でも、映像さえあればリアルな話し言葉に変換できる。

Innovative Tech:

このコーナーでは、テクノロジーの最新研究を紹介するWebメディア「Seamless」を主宰する山下裕毅氏が執筆。新規性の高い科学論文を山下氏がピックアップし、解説する。

インド工科大学ハイデラバード校と同カンプール校による研究チームが開発した「Learning Individual Speaking Styles for Accurate Lip to Speech Synthesis」は、話者の口唇の動きだけを基に自然な音声を生成する機械学習ベースの手法で、「Lip2Wav」という名称を持つ。

口唇を正確に読み取るには文脈や話者固有の手がかりが重要であるとし、ランダムな話者を対象とするのではなく、特定の人の発話を長時間観察してその発話パターンを学習することに焦点を当てた。

個々の話者の口唇発話モデルを学習するために、英語話者5人による合計約120時間のビデオデータを収録し、大規模なデータセットを作成した。

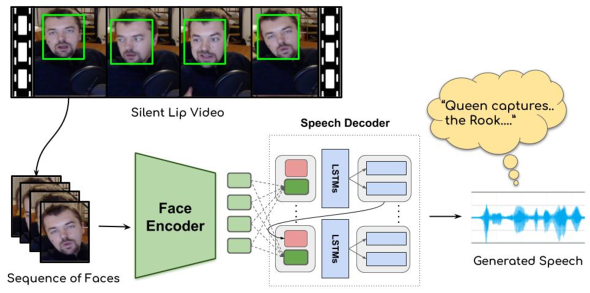

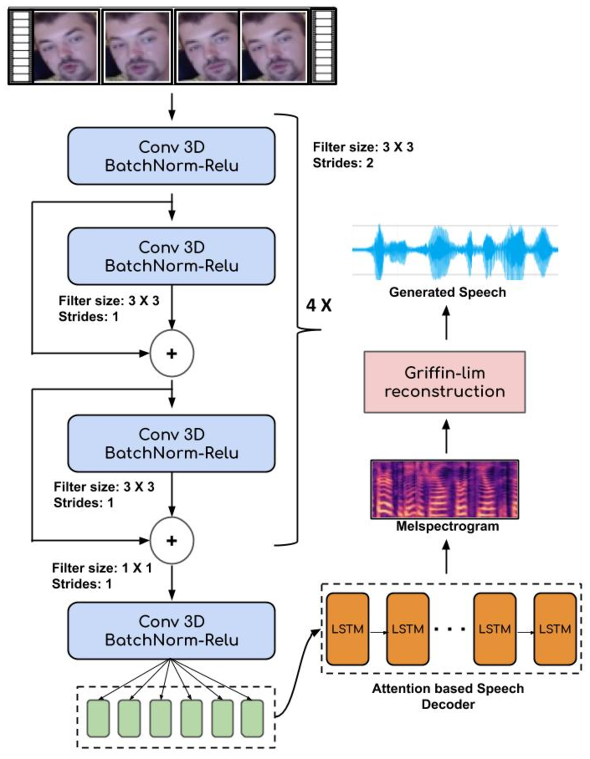

Lip2Wavは口唇の動きのシーケンスを抽出するエンコーダと、高品質の音声合成を生成するデコーダで構成される。

Lip2Wavは顔が映った映像を入力に用い、3次元畳み込みニューラルネットワークで口唇運動をエンコードし、デコーダはこの口唇の動きを条件として音声合成に必要なメル周波数スペクトログラムを生成する。

生成された音声合成は、口唇の動きから発話する内容を読み取っているだけでなく、これまでの類似研究よりも機械っぽさが薄れ、より自然な声での出力が得られたとしている。比較はYouTube動画で確認できる。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

グランツーリスモSPORT最速完走をAIで 達人を凌駕する技術、ソニーなどが開発

グランツーリスモSPORT最速完走をAIで 達人を凌駕する技術、ソニーなどが開発

タイムトライアルを最速で。達人のドライビングテクを学習することで、AIが全ユーザーを抜き去った。 “顔写真の邪魔な影”を後から消せるAI技術 UCバークレーやGoogleなどが開発

“顔写真の邪魔な影”を後から消せるAI技術 UCバークレーやGoogleなどが開発

ライティングに失敗したけど二度と撮れない写真。そんな写真を修復できるかもしれない。 Webカメラ1台で多人数モーションキャプチャーする「XNect」 深度センサーも専用スーツも使わずリアルタイムで

Webカメラ1台で多人数モーションキャプチャーする「XNect」 深度センサーも専用スーツも使わずリアルタイムで

安価なWebカメラで深度センサーや専用スーツを使ったモーションキャプチャーシステムを凌駕する。