音声だけで完全な長文が書ける技術、東大教授が開発 ささやき声で“改行”や“修正”などコマンドを入力:Innovative Tech

ソニーコンピュータサイエンス研究所(CSL)フェロー・副所長であり東京大学大学院情報学環の暦本純一教授は、キーボードやマウスなどを使用せず、音声入力だけで長い文章が書ける技術を開発した。

Innovative Tech:

このコーナーでは、テクノロジーの最新研究を紹介するWebメディア「Seamless」を主宰する山下裕毅氏が執筆。新規性の高い科学論文を山下氏がピックアップし、解説する。

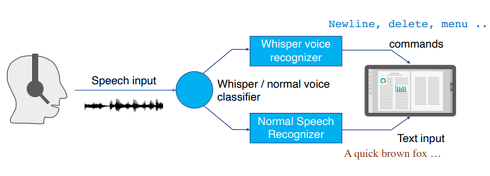

ソニーコンピュータサイエンス研究所(CSL)フェロー・副所長であり東京大学大学院情報学環の暦本純一教授が開発した「DualVoice: A Speech Interaction Method Using Whisper-Voice as Commands」は、キーボードやマウスなどを使用せず、音声入力だけで長い文章が書ける技術だ。文字入力以外のコマンド入力と音声認識ミスによる修正は、通常の声とは別に「ささやき声」で操作する。通常の声とささやき声を使い分ける方法で、ハンズフリーの完全な音声入力を実現する。

音声による文字入力はタイピングに比べて格段に速いため、アイデアを書き留めたり、原稿を素早く入力したりするのに利用されている。だが、音声認識では認識ミスの問題があるため、認識ミスをキーボードやマウスで修正する必要があり、ハンズフリーの利点が損なわれてしまう。

また通常の文字以外のコマンドや特殊文字を入力する際にも問題が発生する。例えば、「改行」と言えばその文字列が入力されてしまい、改行コマンドが実行できない。あらかじめ設定しておくことも可能だが、その場合「改行」という文字列を入力したいときに困る。

しかも、全てのコマンドやテキスト入力のフレーズを覚えておくのは、ユーザーにとって負担になる。シフトボタンでモダリティを切り替えることも可能だが、音声入力のハンズフリーの利点が失われる。そこで、コマンド入力にささやき声を用い、文字入力には通常の音声を用いる音声入力方式「DualVoice」を提案する。

ささやき声と通常の音声の2種類を使い分けることで、文字入力は通常の声、ファンクションキー、コマンドキー、記号キーなどのコマンド入力はささやき声といったように、音声に複数の意味を持たせることができる。

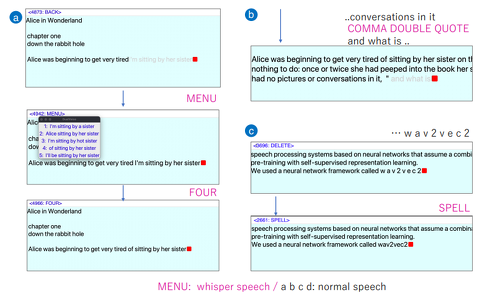

具体的には、通常の音声で「NEW LINE」と言えば文字列として入力し、「NEW LINE」とささやくと改行コマンドを呼び出す。音声認識にミスがあった場合は、「BACK」や「DELETE SENTENCE」とささやくことで、最後の単語を削除したり、対象の単語を変更できる。

また「MENU」とささやくと代替の認識候補が表示され、その候補に付けられた番号(「ONE」「TWO」「THREE」など)をささやくことで選択され文章の修正が行える。他にも「SMILE」と「EMOTION」で笑顔の絵文字に変換なども可能だ。これらはあくまで一例であり、ユーザーの好みに合わせた仕様に変えられる。

(a)「MENU」とささやくと、認識可能な代替えの候補が表示される。ユーザーは数字をささやくことでそれを選択できる、(b)「COMMA」と「DOUBLE QUOTE」をささやくことによる記号の入力、(c)「SPELL」をささやくことによるスペル入力

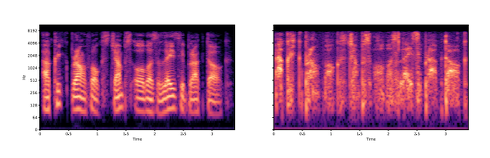

これらを実現するために、ささやき声と通常の声を区別するためのニューラルネットワークと、ささやき声を認識するためのニューラルネットワークの2種類を開発した。

認識スコアは、単語誤り率(WER)と文字誤り率(CER)で評価した。結果は、通常音声で事前学習したモデルをささやき声に微調整することにより、良好な認識精度(例えば、WER0.38%)を示した。

今回はDualVoiceを用いて文章作成に焦点を当てたが、他にも以下のような応用が考えられる。例えば、複数のバーチャルアバターに喋らせる場合、アバター1は通常音声で、アバター2をささやき声で喋るように切り替える。スマートグラスなどのウェアラブルデバイスへの入力はささやき声で、通常の会話は通常の声で行うなど、さまざまな応用が考えられる。

今回は「ささやき声」と「通常の声」の2つを組み合わせた方法を採用したが、これらに加えて「無声発話(口パク)」を導入した3つの組み合わせも考えられる。開発者の暦本教授は、口パクを音声入力に変換する深層学習を用いたサイレントスピーチインタラクションSottoVoceやDermaを発表するなど、無声発話の研究にも取り組んでいる。

以下の動画では、ささやき声と通常の声を駆使して実際に文章を作成しているライブデモを確認できる。

Source and Image Credits: Jun Rekimoto. 2022. DualVoice: A Speech Interaction Method Using Whisper-Voice as Commands. In CHI Conference on Human Factors in Computing Systems Extended Abstracts (CHI EA ’22). Association for Computing Machinery, New York, NY, USA, Article 335, 1-6. https://doi.org/10.1145/3491101.3519700

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

音声入力時の感情に合わせて吹き出しを自動作成 興奮時なら“爆発型”など、東大が開発

音声入力時の感情に合わせて吹き出しを自動作成 興奮時なら“爆発型”など、東大が開発

東京大学の研究チームは、吹き出しを用いたテキストチャットにおける感情コミュニケーションを支援するシステムを開発した。音声でテキスト入力する際の感情を読み取り自動で吹き出しを生成する。 1文字ずつ口パクでスペル入力できるシステム、東大などが技術開発 タイピング速度はスマホに匹敵

1文字ずつ口パクでスペル入力できるシステム、東大などが技術開発 タイピング速度はスマホに匹敵

東京大学、米ジョージア工科大学などによる研究チームは、口パク(無声発話)で1文字ずつタイピングするハンズフリーの入力システムを開発した。 口パクで音声入力できるマスク、東大などが開発 約8割の精度で音声を認識

口パクで音声入力できるマスク、東大などが開発 約8割の精度で音声を認識

東京大学と産業技術総合研究所の研究チームは、マスク着用時に口パク(無声発話)による音声入力が行えるマスク型デバイスを開発した。口パクによって変形するマスクを内蔵するセンサーで読み取り、音声アシスタントへの入力コマンドに変換する。 「OK Google」「Hey Siri」の微妙な“言い方”を区別し、音声アシスタントの誤認識を軽減 東大などが開発

「OK Google」「Hey Siri」の微妙な“言い方”を区別し、音声アシスタントの誤認識を軽減 東大などが開発

東京大学大学院情報学環の暦本研究室とソニーコンピュータサイエンス研究所(CSL)の研究チームは、「OK Google」や「Hey Siri」のような音声アシスタントを起動させる音声コマンドの誤認識を軽減する学習ベースの分類モデルを開発した。 東大、“世界最高性能”のディープフェイク検出AIを開発 フェイクニュースやポルノなどの悪用根絶に期待

東大、“世界最高性能”のディープフェイク検出AIを開発 フェイクニュースやポルノなどの悪用根絶に期待

東京大学の研究チームは、動画内の人物の顔が本物かどうか判定する、ディープフェイク検出AIを開発した。このAIは、既存研究の性能を大きく上回り、世界最高性能の評価を示したという。