画像生成AIの「高品質なプロンプト」を0.01秒で盗むサイバー攻撃 ドイツの研究機関が発表:Innovative Tech

ドイツの研究機関CISPA Helmholtz Center for Information Securityに所属する研究者らは、テキストから画像を生成するモデルで生成した画像からテキストプロンプトを盗用する攻撃を提案した研究報告を発表した。

Innovative Tech:

このコーナーでは、テクノロジーの最新研究を紹介するWebメディア「Seamless」を主宰する山下裕毅氏が執筆。新規性の高い科学論文を山下氏がピックアップし、解説する。Twitter: @shiropen2

ドイツの研究機関CISPA Helmholtz Center for Information Securityに所属する研究者らが発表した論文「Prompt Stealing Attacks Against Text-to-Image Generation Models」は、テキストから画像を生成するモデルで生成した画像からテキストプロンプトを盗用する攻撃を提案した研究報告である。

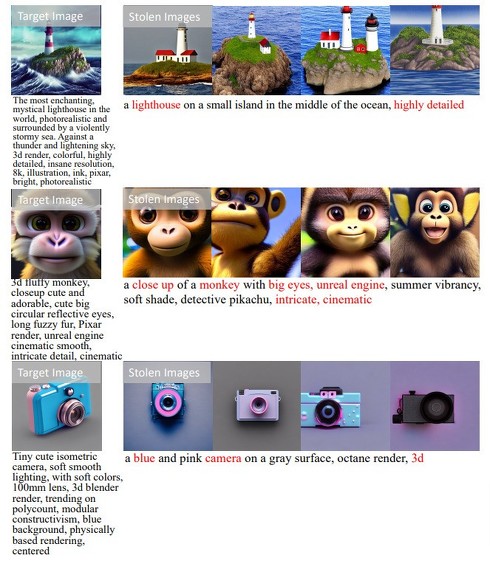

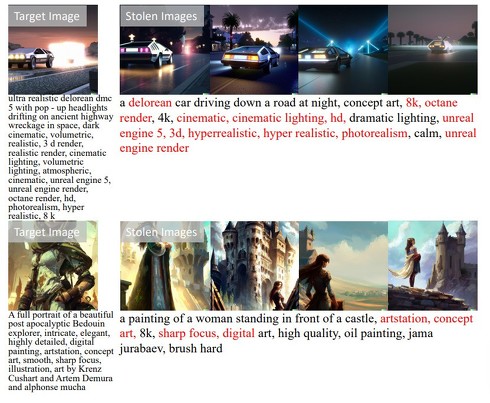

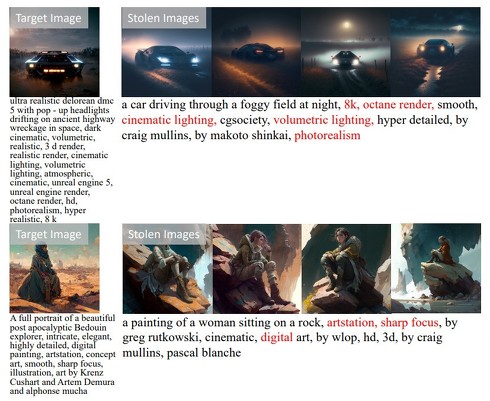

左端の1枚がMidjourneyで生成したターゲット画像、下部がその画像のプロンプト。残り4枚が研究手法で盗んだプロンプトでMidjourneyを使用して生成した画像。赤色の文字は正しく予測された修飾子を示す

Stable Diffusion、DALL-E 2、Midjourneyなどのテキストから画像を生成するモデルの登場以来、プロのアーティストに頼るのではなく、プロンプトと呼ばれるテキスト記述を入力することで、誰でも写実的な画像や商業的な図面などのデジタル画像を生成できるようになった。

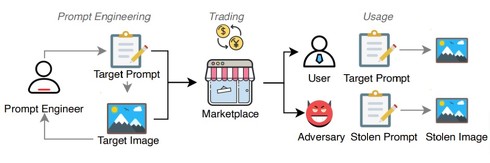

安定したプロンプトを作成するために、ユーザーは常にプロンプト修飾子を探し、それに対応する画像をチェックする必要がある。この作業には時間とコストがかかるため、高品質なプロンプトを専門に制作する「プロンプトエンジニア」という新しい職種が生まれた。また高品質のプロンプトは新たな価値ある商品となり、「PromptBase」「PromptSea」「Visualise AI」などの専門マーケットプレースで取引されるようになった。

このような背景から、生成した画像が与えられたとき、それに対応するプロンプトを推測することができるのか、という課題に対して今回は、生成画像からプロンプトを盗む攻撃を試みる。

まず、500万以上のプロンプトとStable Diffusionから生成した画像を持つ画像ギャラリーである「Lexica」から大規模なデータセットを収集することから始める。全体として、25万組のプロンプトと画像を収集した。さらにプロンプトの前処理と重複排除の後、最終6万1467組のプロンプトと画像ペアに絞った。

データセット名は「Lexica-Dataset」とした。Lexica-Datasetの定量・定性分析から、プロンプトの主語と修飾語の両方が生成画像の品質にとって重要な要素であることが分かった。次に、修飾語を異なるカテゴリーに分類し、きめ細かな分析を行う。

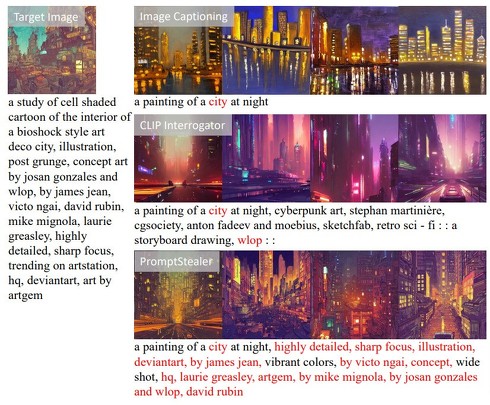

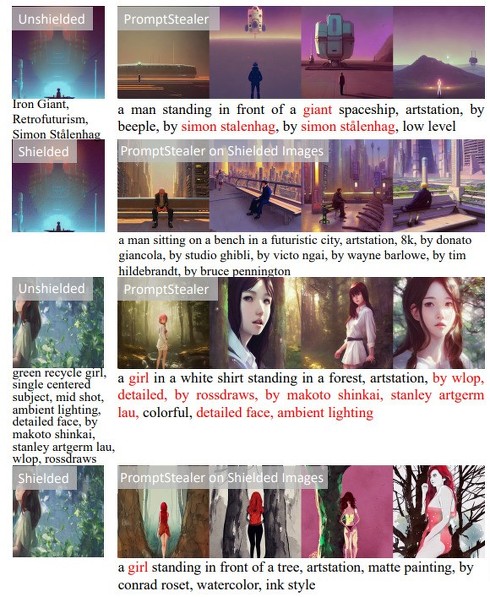

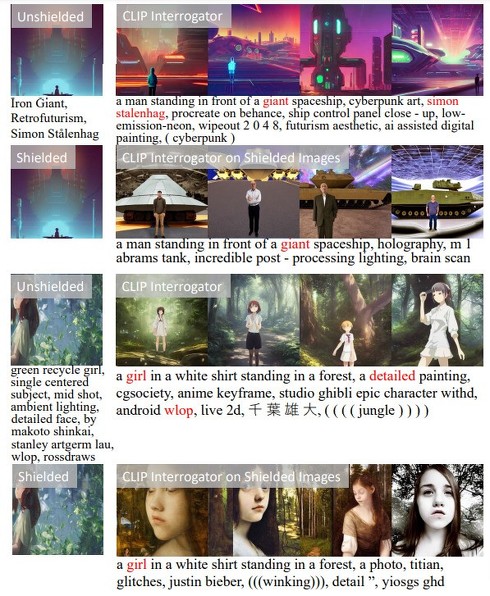

これらの知見に基づき、学習型プロンプト盗用攻撃である「PromptStealer」を提案する。PromptStealerは、画像キャプションモデルとマルチラベル分類器の2つの主要コンポーネントで構成する。

ターゲット画像が与えられると、画像キャプションモデルはそのキャプションを最終的に盗まれるプロンプトの主題として生成する。マルチラベル分類器は、プロンプト修飾子を予測するために使用する。画像キャプションモデルとマルチラベル分類器をターゲット画像に適用した後、キャプション/サブジェクトとプロンプト修飾子を連結し、最終的な盗用プロンプトを得る。

PromptStealerを定性的に評価した結果、盗んだプロンプトから生成する画像はターゲット画像に近いことが分かった。また精度は2つのベースライン手法を超えた。

PromptStealerのもう一つの利点はその効率性にある。例えば、PromptStealerは、NVIDIA DGX-A100サーバ上で1つのプロンプトを盗むのに0.01秒しかかからなかった。

研究チームは、自分たちの攻撃を防ぐ手法も提案している。「PromptShield」と呼び、プロンプト盗用攻撃を軽減する最初の試みである。この手法は、敵対者が画像のプロンプトを適切に推測できないように、あらかじめ画像に最適なノイズを付加するものである。

実験の結果、PromptShieldはうまく機能し、正しく予測できる修飾子の数を減らすことができると分かった。

Source and Image Credits: Xinyue Shen, Yiting Qu, Michael Backes, Yang Zhang. Prompt Stealing Attacks Against Text-to-Image Generation Models. https://arxiv.org/abs/2302.09923

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

ChatGPTは弁護士の代わりになるか? 「カタツムリ混入ビール事件」の判例で検証 香港チームが発表

ChatGPTは弁護士の代わりになるか? 「カタツムリ混入ビール事件」の判例で検証 香港チームが発表

香港の法律事務所Albert Luk Chambersと香港中文大学に所属する研究者らは、実際の判例を題材にChatGPTに法律文書の作成と法的調査を複数出力させ考察した研究報告を発表した。 映像内の犬を猫に変えられるAI テキストのみで動画編集が可能 Googleなど「Dreamix」開発

映像内の犬を猫に変えられるAI テキストのみで動画編集が可能 Googleなど「Dreamix」開発

Google ResearchとイスラエルのThe Hebrew University of Jerusalemに所属する研究者らは、テキストに応じた動画編集ができる拡散モデルを提案した研究報告を発表した。 画像生成AIが「トレパク」していた? 学習画像と“ほぼ同じ”生成画像を複数特定 米Googleなどが調査

画像生成AIが「トレパク」していた? 学習画像と“ほぼ同じ”生成画像を複数特定 米Googleなどが調査

米Google、米DeepMind、スイスのETH Zurich、米プリンストン大学、米UC Berkeleyに所属する研究者らは、テキストから画像を生成する拡散モデルが学習データとほぼ同じ画像を生成していたことを実証した研究報告を発表した。 AIが作った画像が喋る 動画生成サービス「Creative Reality Studio」登場 「GPT-3」「Stable Diffusion」を利用

AIが作った画像が喋る 動画生成サービス「Creative Reality Studio」登場 「GPT-3」「Stable Diffusion」を利用

生成系AIの開発などに取り組むイスラエルのD-IDは、アバターが喋る動画を生成できるサービス「Creative Reality Studio」を開発したと発表した。プロンプトを基に、AIが画像や喋らせたい内容を生成。それらを自動合成し、動画として出力する。 呪文で高精細な3Dアバターを生成するAI「Rodin」 Microsoftが開発

呪文で高精細な3Dアバターを生成するAI「Rodin」 Microsoftが開発

Microsoft Researchに所属する研究者らは、人物の静止画像やテキストプロンプトから高品質な3Dアバターを生成する拡散モデルを提案した研究報告を発表した。