OpenAI、ロシアや中国によるChatGPTなどのAIツール不正利用について報告 5件を阻止

OpenAIは、ロシアや中国が国民操作に同社のAIツールを利用したと報告した。5件のキャンペーンを特定し、阻止したとしている。

米OpenAIは5月30日(現地時間)、「AI and Covert Influence Operations:Latest Trends」(AIと隠された影響工作:最新動向)と題した報告書(PDF)を公開した。この報告書によると、ロシア、中国、イラン、イスラエルを拠点とする複数の組織が、国民を操作するために同社のAIを利用している。

同社は、こうしたオンラインキャンペーンを5件特定し、阻止したという。

これらの組織は、ChatGPTを含むOpenAIのツールを使用して、複数の言語でSNSのコメントを生成したり、偽のアカウントの名前や経歴をでっち上げたり、画像を作成したり、コードをデバッグしたりしていたという。

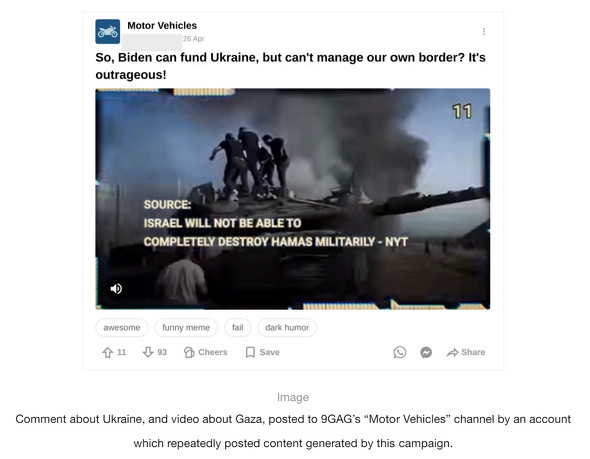

たとえばロシアのDoppelgangerは、OpenAIのツールを使ってロシア語の投稿を英語やフランスなどに翻訳し、SNSに投稿していた。OpenAIはその例として、コメントはウクライナについてのものなのに、画像はガザ地区についてのものというちぐはぐな投稿を紹介した。

OpenAIは、「脅威アクターはコンテンツを改善し、より効率的に作業するためにわれわれのプラットフォームを使っているが、これまでのところ、彼らはまだ本物のオーディエンスにリーチして関与できていない」と主張した。同社は「責任あるAI導入へのアプローチを反映した安全システムを通じて」脅威アクターに対抗しているという。「われわれのモデルが、攻撃者が要求したテキストや画像の生成を拒否するケースが繰り返し観察された」。

OpenAIは、世間は攻撃者によるAIの悪用に注目しがちだが、「防御側にAIがもたらす利点を忘れてはならない」と主張する。

「われわれは生成AIの力を活用し、こうした不正行為を大規模に発見し、軽減することに尽力している」。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

OpenAI、安全およびセキュリティ委員会を設立 トップはアルトマンCEO

OpenAI、安全およびセキュリティ委員会を設立 トップはアルトマンCEO

OpenAIは、AGI開発を含むプロジェクトとに関する安全とセキュリティをレビューするための委員会を設立したと発表した。率いるのはサム・アルトマンCEOなど3人の理事。次世代モデルのトレーニングを開始したことも発表した。 OpenAI、退社したライケ氏のAGI警鐘に応じるも具体策は明示せず

OpenAI、退社したライケ氏のAGI警鐘に応じるも具体策は明示せず

OpenAIでAIの安全性に取り組んできたライケ氏が退社に当たって投稿した警鐘に対し、ブロックマン社長がアルトマンCEOと連名の長文をポストした。アルトマン氏は別途、同社の退社合意書について高まる批判に対し「知らなかったが、知っておくべきだった」とポストした。 生成AIの弱点が相次ぎ発覚 ChatGPTやGeminiがサイバー攻撃の標的に 情報流出や不正操作の恐れも

生成AIの弱点が相次ぎ発覚 ChatGPTやGeminiがサイバー攻撃の標的に 情報流出や不正操作の恐れも

米OpenAIの「ChatGPT」やGoogleの「Gemini」など、主要生成AIの弱点や脆弱性が次々に発覚している。 OpenAIとMicrosoft、AIを攻撃に悪用するロシアや中国のアカウント停止

OpenAIとMicrosoft、AIを攻撃に悪用するロシアや中国のアカウント停止

MicrosoftとOpenAIは、LLMなどのAIツールがロシアや中国などとつながる脅威アクターに悪用されているという調査結果を発表した。両社はこれらの脅威アクターに関連付けられているすべてのアカウントと資産を無効にしたとしている。