動画・音声を視聴したときの“脳反応”を予測──Metaが開発した脳活動予測AI「TRIBE v2」の可能性:Innovative Tech

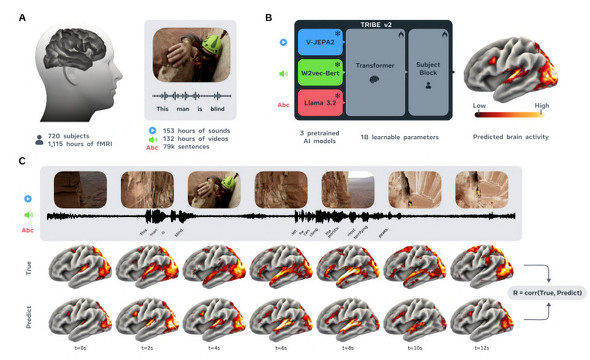

米Metaなどに所属する研究者らが発表した論文「A foundation model of vision, audition, and language for in-silico neuroscience」は、人間の脳活動を予測する基盤モデル「TRIBE v2」を発表した研究報告だ。

Innovative Tech:

2019年にスタートした本連載「Innovative Tech」は、世界中の幅広い分野から最先端の研究論文を独自視点で厳選、解説する。執筆は研究論文メディア「Seamless」(シームレス)を主宰し、日課として数多くの論文に目を通す山下氏が担当。イラストや漫画は、同メディア所属のアーティスト・おね氏が手掛けている。X:@shiropen2

米Metaなどに所属する研究者らが発表した論文「A foundation model of vision, audition, and language for in-silico neuroscience」は、人間の脳活動を予測する基盤モデル「TRIBE v2」を発表した研究報告だ。

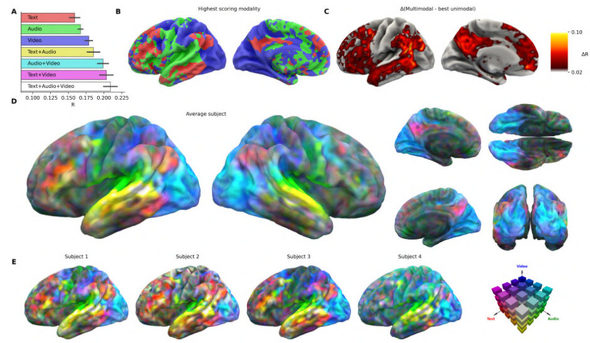

従来の脳科学では「顔を見るときはこの部位が活発になる」といったように、顔認識や言語処理など個別の機能ごとに対応する脳部位を調べるのが主流だった。しかし、日常的には複数の感覚が同時に働いているのが人間の脳だ。TRIBE v2はこの複雑な脳活動に対し、動画・音声・テキストという3つの情報を統合して、それらを見聞きした際に脳がどう反応するかをシミュレーションする。

これまでは脳の反応を調べるには、人間をfMRI装置に入れて測定するのが常識だった。しかしTRIBE v2は、720人分・1000時間以上のfMRI脳データを学習しており、「インシリコ実験」──すなわち生身の人間やfMRIを一切使わずに、コンピュータ上だけで脳科学の実験を成立させられる。

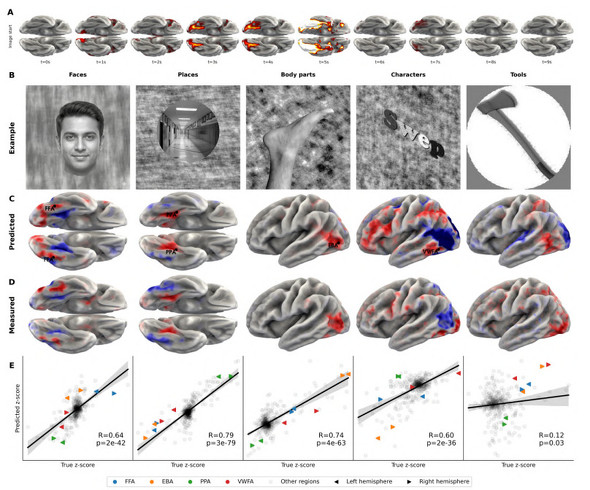

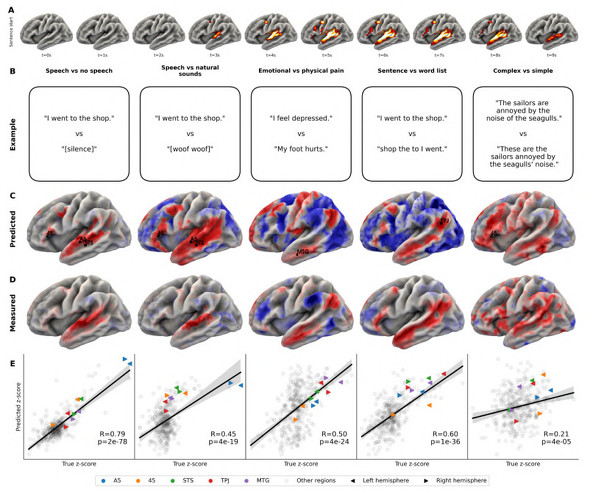

例えば、顔の画像を見せたときに反応する「紡錘状回顔領域」や、文字を見たときに活発になる「視覚的単語形状領域」、他にも身体や場所などといった数十年にわたる実証研究で特定されてきた脳の局所的な反応を、AIの予測だけでほぼ正確に再現できた。加えて、複数の感覚が脳内でどのように統合されるかというメカニズムまでも可視化している。

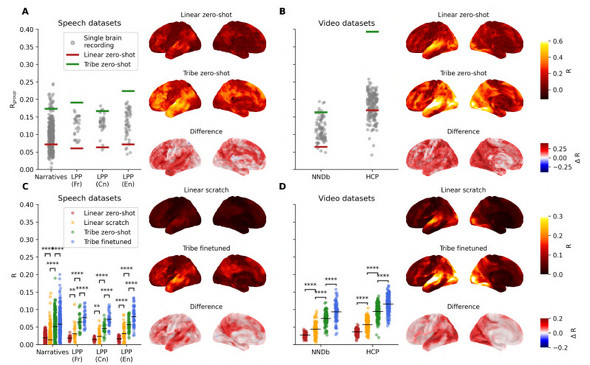

その結果、従来の線形モデルを大幅に上回る精度を達成し、未知の動画や音声、さらには一度もデータとして取り込んだことのない新規被験者に対しても、脳の反応を予測できるようになった。国際コンペ「Algonauts 2025」では263チーム中1位を獲得している。

ただし制約もある。fMRIの性能(時間分解能)の限界から、ミリ秒単位の神経活動は捉えられない。入力も視覚・聴覚・言語に限られるため、嗅覚や触覚などの感覚は扱えない。さらに、脳を刺激の受動的な受け手としてのみモデル化しており、行動の生成や意思決定、発達過程、臨床的な病態といった能動的・動的な側面にはまだ対応できていない。

一方で、データ量と精度の間にスケーリング則が確認されており、今後さらに大規模なfMRIデータが集まれば予測精度がさらに向上する可能性がある。

TRIBE v2をプラットフォーマーとしてのMetaから見ると、ある動画をユーザーが視聴した際に脳のどの領域がどう活性化するかを“配信前”に把握できるという点が注目に値するという。つまり、動画を公開する前に、その映像が人々の感情をどう揺さぶるかを脳科学の観点からシミュレーションできるわけだ。

MetaはSNSを長年運営しているため、人々の反応データ(エンゲージメント指標、画面の滞在時間など)を膨大に保持しており、それらをターゲティング広告などに活用してきた。そこに今回の脳反応予測が加わることで、ユーザーの反応をより根本的なレベルから予測・最適化していく道が開けるかもしれない。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

脳活動から見ている映像を復元する技術「Mind-Video」 シンガポールと香港の研究者らが開発

脳活動から見ている映像を復元する技術「Mind-Video」 シンガポールと香港の研究者らが開発

シンガポール国立大学と香港中文大学に所属する研究者らは、脳活動から見ている映像を復元する手法を提案した研究報告を発表した。磁気共鳴機能画像法(fMRI)で取得した脳活動から高品質な動画を再構成する。 脳波を解読して聞いている音楽を特定するAI 70%以上の精度で識別 英国チームが開発

脳波を解読して聞いている音楽を特定するAI 70%以上の精度で識別 英国チームが開発

英エセックス大学に所属する研究者は、ユーザーの脳波を記録し解読することで、今聞いている音楽を特定し復元する深層学習モデルを提案した研究報告を発表した。 脳が知覚した内容を「Stable Diffusion」が画像化 脳活動を解析 阪大などが技術開発

脳が知覚した内容を「Stable Diffusion」が画像化 脳活動を解析 阪大などが技術開発

大阪大学大学院生命機能研究科と情報通信研究機構CiNetに所属する研究者らは、潜在拡散モデルを用い、人間の脳活動から画像を生成する手法を提案した研究報告を発表した。 指先の細かな動き、脳活動から再現 訓練不要、「考えるだけでロボット操作」に一歩

指先の細かな動き、脳活動から再現 訓練不要、「考えるだけでロボット操作」に一歩

NICTとACRは、脳活動を計測し、指先の素早い運動をなめらかな動きでPCディスプレイ上に再現することに成功。ロボットの遠隔操作や遠隔医療などに応用できる技術として研究を進める。