Metaが深層学習「Brain2Qwerty」を発表、脳波から文章解読

Metaは、新しい深層学習アーキテクチャ「Brain2Qwerty」を発表した。人間がQWERTYキーボードで文章を入力している際の脳波または脳磁図から文章を解読する技術だ。

米Metaは2月7日(現地時間)、新しいディープラーニング(深層学習)アーキテクチャ「Brain2Qwerty」を発表した。非侵襲的な方法で脳活動から文章を解読することに成功したとしている。この研究は、脳損傷によってコミュニケーション能力を失った人々が、再び意思疎通を図れるようになる未来を拓く可能性を持っているという。

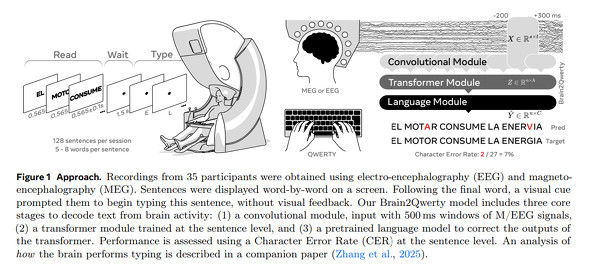

Brain2Qwertyは、人間がQWERTYキーボードで文章を入力している際の脳波(EEG)または脳磁図(MEG)から文章を解読するように訓練されている。

この研究では、35人の健康なボランティアを対象に、Brain2Qwertyの有効性が実証されたという。参加者が文章を入力している際の脳活動を記録し、AIモデルを訓練して脳信号から文章を再構築した。

この実験では、脳信号から文字を解読する精度が最大80%に達し、文章の再構築に成功した。

Metaは、脳が思考を言葉の配列に変換する仕組みをAIで解明する研究も行っている。毎秒1000回の脳のスナップショットを解析し、思考が単語、音節、文字に変換される瞬間を特定する研究により、脳が文の意味のような抽象的なレベルから指の動きのような具体的な行動へと、段階的に情報を変換する過程が明らかになってきているという。

この研究は、非侵襲的なBCI(ブレインコンピュータインタフェース)の開発に繋がり、脳の言語生成の神経メカニズムの解明はAMI(高度な機械知能)の開発に貢献する可能性があるとMetaは説明している。

ただし、この研究にはまだ課題が多い。文字誤り率(CER)の平均は32%(つまり、3文字に1文字程度の率で誤っている)だ。また、MEGを使うには、しっかり磁気シールドされた部屋の中で、被検者を動かないよう固定する必要がある。

Meta(当時はFacebook)は2017年、“10年先に実現する見込みの技術”の1つとして、脳で考えたことをダイレクトに出力するシステムの構想を発表している。2021年には、脳からの神経信号を読み取り、タイピングやスマートホーム端末の操作、ゲームなどをジェスチャーで行えるようにするリストバンド式のAR(拡張現実)インタフェースの計画を発表した。

イーロン・マスク氏が創業した米NeuralinkもBCIを開発中。こちらは脳にチップを埋め込む侵襲的なシステムだ。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

Facebook、脳からの神経信号を読み取るリストバンドを披露 ARメガネの入力用

Facebook、脳からの神経信号を読み取るリストバンドを披露 ARメガネの入力用

Facebookが開発中のARメガネの入力デバイスとして開発中のリストバンドのプロトタイプを披露した。2019年に買収したCTRL-labsの技術に基づくもので、脳からの神経信号を読み取り、指の動きで仮想キーボードでの入力やARのオブジェクト操作を可能にする。 Facebook、脳直結出力システムに一歩近づく UCSFとの共同研究論文発表

Facebook、脳直結出力システムに一歩近づく UCSFとの共同研究論文発表

Facebookが「F8 2017」で発表した非侵襲的脳直結コミュニケーションシステムの進捗を発表した。侵襲的方法ではあるが、脳で考えたことのほぼリアルタイム表示に成功した。 Facebook、脳直結出力システムと“皮膚で聞く”システムを発表

Facebook、脳直結出力システムと“皮膚で聞く”システムを発表

GoogleのATAPからFacebookの先進ハードウェアチームに入ったレジーナ・デューガン氏が「F8 2017」で、脳で思考したことを直接出力するシステムと、皮膚から脳に情報を入力するシステムを発表した。数年後には実現させたいとしている。 NeuralinkのマスクCEO、BCI埋め込みの2人目も順調と語る 「年内にあと8人に」

NeuralinkのマスクCEO、BCI埋め込みの2人目も順調と語る 「年内にあと8人に」

BMI(脳マシンインタフェース)を手掛けるNeuralinkのイーロン・マスクCEOはレックス・フリードマン氏のポッドキャストに参加し、2人目の脳チップ埋め込み手術が成功したと語った。1人目の患者もポッドキャストで体験を語った。