AIであなたの動きを誰かが真似る、その仕組み:Googleさん

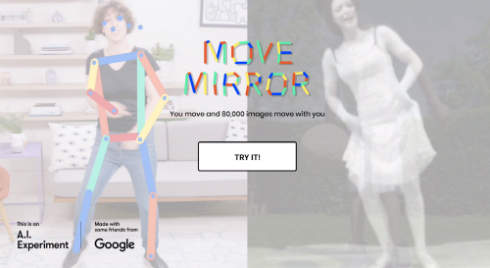

Googleが、普通の人にディープラーニングの面白さを紹介するWebサイトで「Move Mirror」を公開。PCのカメラの前で踊ってGIFとして録画すると、その隣に鏡のように同じポーズの老若男女の多様な画像が表示されるというものです。

GoogleさんはディープラーニングなどのAI研究にとても力を入れていて、その成果はGoogle検索はもちろん、マップや翻訳、スマートスピーカーなど、あらゆるサービスに反映されています。

研究成果の多くはオープンソース化されていて、普通の人向けにも「こんな面白いことができるようになるよ」と紹介するための「AI Experiments」というWebサイトも公開しています。

最近の例として、7月19日(現地時間)にこのWebサイトに追加された「Move Mirror」があります。動きを映す鏡。

Webサイトに行って、PCのカメラで自分の全身を映し、GIF動画として録画すると、そのポーズに似たポーズをしている人の画像が横に並ぶというものです。

*** 一部省略されたコンテンツがあります。PC版でご覧ください。 ***

普通のPC(カメラ付き)とWebブラウザがあれば、誰でも遊べます(アプリによるカメラへのアクセスを許可しておく必要があります)。古いPCだと時間がかかるかもしれませんが、私のPC(Core i7、Intel HD Graphics 620、メモリは16GB)ではほぼリアルタイムでした。

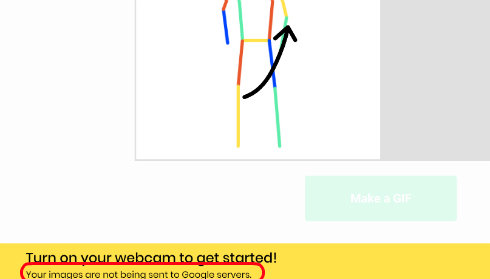

これまでは、AI Experimentsで遊ぶと、Googleさんの機械学習用データとして提供することになるものが多かった(例えばお絵描きの「AutoDraw」)ですが、Move Mirrorはなんと、すべてPCのWebブラウザ側で解析するので自分が変な格好で踊っているGIFを研究者さんに提供することにはなりません。

やり方は簡単です。なるべく背景がごちゃごちゃしていないところで、自分の全身が映るようにPCのカメラの位置を調節し、録画ボタンをクリック(タップ)します。5秒のカウントダウン中に撮影ポイントに移動し、適当に動き、もういいかな、というところで録画を終了するだけ。これで、左に自分のGIF動画、右にその動きに似たポーズの画像が動きに合わせてパラパラ漫画のように表示されます。

録画したGIFはダウンロードできて、シェアも可能。私は恥ずかしいのでシェアしませんが、ヨガの立木のポーズやら変なダンスやらをしてみたところ、老若男女、ぼんやりしたモノクロから高解像度のカラー画像まで、さまざまな似たポーズが表示されました。

Move Mirrorの画期的なところは、全部PC側でできるという点。これは、Googleさんが開発した、人間のポーズ(姿勢)を推定する機械学習モデル「PoseNet」の「TensorFlow.js」版(5月に公開されたばかり)のおかげです。TensorFlow.jsは、GoogleさんのディープラーニングシステムTensorFlowをJavaScriptで実行するという、しろうとな私にはそのすごさがよく分からないですが多分すごい技術です。

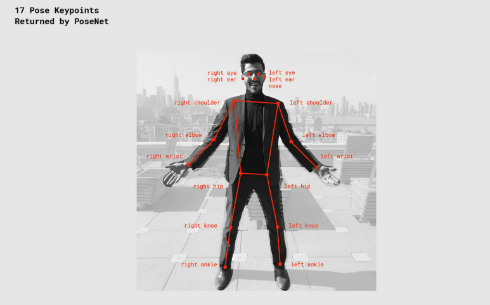

PoseNetは、画像や動画からまず人間を検出し、その人間の目鼻や肘、膝など17カ所をポイントとして認識します。

PoseNetを使えば、目の位置が分かるので目線を入れるツールを作ったり、ARゲームも作れそうです。

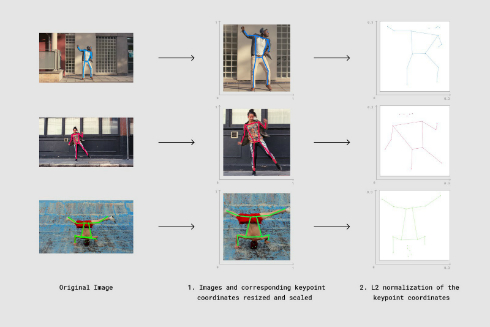

Move Mirrorでは、このPoseNetのTensorFlow.js版をGoogleがお得意の検索と組み合わせたわけです。大まかに言うと、GoogleがMove Mirrorのために集めた8万件の動画(すべて権利関係が大丈夫なもの)のポーズをあらかじめ解析してベクターデータにしたものと、ユーザーが録画したGIF画像から同じようにベクターデータにしたものをマッチングさせています。

なんて、書くのは簡単ですが、ここに到達するまでにいろんな苦労があり、その課程で新しい工夫を思いつき、という開発者さんであればわくわくするようなエピソードがブログで説明されているので、そちらもお勧めです。

Copyright © ITmedia, Inc. All Rights Reserved.