全方位から検証するコンテナデータセンターの優位性:Architecture for Modular Data Centers(2/2 ページ)

データセンターの構築、管理、増築にフル実装した搬送用コンテナを利用するという提案は、果たして賢者の選択なのだろうか? 本稿では、さまざまな角度からコンテナデータセンターの真の姿を明らかにしていく。

3-3:移動可能なデータセンターがビジネスに柔軟性を

少数の大規模データセンターにサービス配信を統合するための強力な経済議論が醸成される一方で、数多くの要因によってその推進が阻まれているという現実もある。

まず、地理的な冗長性が求められる。第2に、法律上、データのローカルでの保管が要求されたり、運用地域が制限されることがある。幾つかの企業やグループは、米愛国者法(パトリオット法)および関連する法律の対象になることを避けるため、米国内にデータを配置すべきではないと考えてている。

同様に、他国におけるプライバシー基準や、法的責任、知的財産などの問題がある。数多くのケースで、すでにオープンなインターネットを通じて多数の海外の法的管轄に流出しているデータに比べれば、こうした懸念はそれほど実際的ではないかもしれない。また、実際にデータ保管場所が制限されているケースでも、こうした制限の効力に関する広範な合意はまだ成立していない。

にもかかわらず、多くの企業がこの前提に立ってビジネス決定を行っており、データを保存する場所に制限を設けている。そのため、サービスプロバイダーはこうした企業にアピールするために地域のデータセンターを使うようになる。数多くのサービスプロバイダーは、効率的な運営には適さないにもかかわらず、世界に拡散するデータセンターのネットワークの利用を選んでいる。低価格のコンテナモデルは、遠隔地の小規模データセンターを手ごろな価格で構築することを支援する。

搬送用のコンテナは、コンピューティングとストレージの双方にとって、風雨に耐え得る住宅となる。したがって、過去何年にもわたってデータセンターの決定的な特徴とされてきた、広大なラックルームやフローティングフロアは不要となる。

中心となる建物は、セキュリティ、電力供給、ネットワーキング、冷却装置を収容するため依然として必要だが、コンテナは戸外に安全に配置できる。つまり、コンテナを配置するためにフェンスで囲われ、安全を保たれた舗装エリアを、中心となる建物の周辺に確保することが唯一の要件となる。このコンテナは、3〜5段に積み重ねることが可能であり(船上では7段で積載)、低価格の構築コストにおいて、高集積度のデータセンターを実現する。

このマクロモジュールで構成されたデータセンターは、構築費用が安いだけではなく、移動費用も安価である。別の場所で低コストなネットワーク帯域幅が利用できる場合や、有利な税制が適用できる場合、そして、現在の場所でデータセンターが不要になった場合には、データセンター全体をトラックで移動できる。固定資産は中心となるサービス用建物とフェンスで囲まれた構内だけであり、売却あるいは撤去の必要がある1億5000万ドルの施設ではない。

データセンターの設計と建設には時間が掛かる。15メガワットの施設を構築するのに、24カ月以上を要する。モジュール式のデータセンターにより、このプロセスを速めることが可能かもしれない。現実に、既存のデータセンターを拡大する際、このアプローチを用いれば建築許可は不要で、建築物に課される税金も発生しない。

3-4:フィールドメンテナンスを省いてコストを低減

現地でのハードウェアサービスは、データセンターごとに熟練したサービス要員の配属が必要なため、高くつく可能性がある。しかし、コンテナ型の提案を採用することで、そうした経費のかなりの部分が排除される。

データセンターにフルタイムのサービス技術者を配属することは、その設備が大規模なものでない限り、なかなか費用効果が上がらない。大半のサービスで、この作業は外部に依頼するため、その費用は3年間の耐用年数を通じて、システム価格の25%を占めることになる[14]。

しかし、コスト削減よりも重要なのは、データセンターにサービス要員を配置しないことでエラーを回避することである。アーロン・ブラウン氏のリポートでは、システム停止の原因における20〜50%が、人為的なミスとされている[3]。さらに言えば、サービスにおける全体的な可用性の向上は、コスト削減よりも重要なメリットである。

ここで提案するアプローチの場合、必要な現地でのサービスは、集中化された電力供給、冷却装置、ネットワーキング、セキュリティの設置と管理だけである。設置はネットワーク、冷却装置、電力供給しか必要としないため、現場で必要なスキルはほとんどない。

3-5:システムと電力の密度

現代の典型的なデータセンターでは、1平方フィート当たり約100ワットの電力密度がサポートされている。中には1平方フィート当たり350〜600ワットというレベルで運用されているデータセンターもある。

こうした比較的低い電力密度が、データセンターのフル運用を妨げている。また、充分な電力が供給可能な場合でも、熱密度がしばしば問題になる。ウルス・ヘルツル氏の説明によると、Googleのデータセンターが1Uのシステムデザインを採用し、それ以上の電力密度を検討しないのは、ほとんどのデータセンターで必要な電力と冷却の供給が不可能であるためだという[8]。

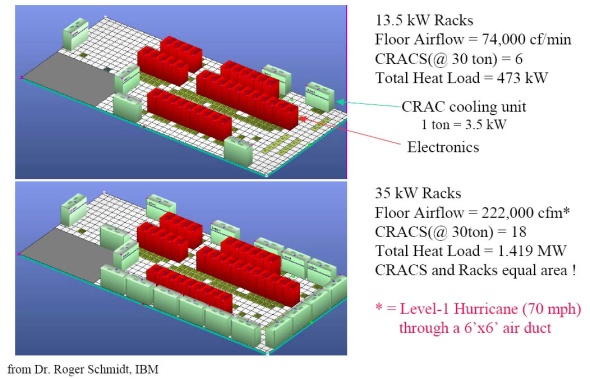

例えば、Oak Ridge National Labでは、35キロワット対応ラックのための冷却要件をモデル化している[13]。この仕様をサポートするために必要な気流は、断面が6フィート四方の冷却管を想定すると222,000CFM(立方フィート毎分)になる。

この研究では、必要になる台数分のコンピュータールーム空調設備(CRAC)が占めるスペースは、システム自身のスペースとほぼ同じになると結論付けられた。この結論には、ラック周りの気流および、メンテナンスに必要な通路のためのスペースは含まれていない。言い換えると、データセンターの床面積の50%以上が非生産的に占拠されているということだ。

Oak Ridge National Labの事例は、空水冷式冷却の効率の悪さを示している。この方式では、マシンルーム内のCRACを循環する冷却剤を、冷却プラントを用いて冷やす。CRACは排熱を取り除くためにラック間を循環している空気を冷却する。これが今日大半のデータセンターで用いられているアプローチである。

メインフレームの事例で周知の通り、直接的な液体冷却は集積度の高いシステムをサポートできる。空気と比べて液体の方が、ずっと高い比熱を持っているからだ。これは、それほど新しい発見ではないが、ソリューションとしては忘れられているように思われる。

液体による冷却というのは1960年代の主流で、例えばIBMは308x/309xシリーズの熱伝導モジュール(TCM)で1980年代半ばまで採用していた[9]。IBM研究所が最近構築したストレージシステムは、どれだけの熱密度に対して、直接的な液体冷却が効果的であるかを示している。IBM Ice Cubeと名付けられたこのシステムは、22.5インチの立方体に324台のディスクを収納する[13]。液体冷却式のシステムラックも現在購入が可能である[18]。しかし液体冷却は、その複雑さとサービスリスクのために、ラックを積み重ねるインターネットサーバファームでは広く受け入れられてはいない。

このマクロ・モジュール・コンテナは、CRACユニットのスペース要件を取り除くために、直接的な液体冷却を用いる。また、人的なサービスや大量の気流のためのスペースも必要ない。結果として、従来からの空気冷却式のラックと比較して、システムの集積度はずっと高いものになり得る。

直接的な液体冷却の唯一の欠点は、液体の漏れにより、システムにダメージを与えるリスクだろう。しかし、このサービスいらずのアプローチでは、コンテナ内の液体配管は工場出荷時に封印され、開かれることはない。

Contributor

監修:光安正年

九州電力株式会社情報通信部に在籍後、九電子会社の役員を経て株式会社インフォテック アドバイザリーを設立、代表取締役に就任。同社では、電気通信事業や情報通信技術などにかかわる調査・研究や、人材育成のアドバイザーなど幅広いコンサルティング業務を展開している。

翻訳協力:鵜澤幹夫

Windows ServerおよびAzure、Hadoopを専門とする、翻訳家でありコンサルタント。wipseの事務局長を務め、Azure User GroupのJapanローカルグループをホストしている。ブログは「Agile Cat」

content on this article is licensed under a Creative Commons License.

関連記事

データセンターのシステムパッケージングに対する発想の転換

データセンターのシステムパッケージングに対する発想の転換

データセンターの構築、管理、増築にコンテナを利用するという方法は、本当に夢物語なのだろうか? 本稿では、ほかに類を見ない粒度でのシステムの導入/展開/管理を3回に分けて考察する。今回は、今日のデータセンターのトレンドとその課題について考える。- サン、コンテナ型データセンター「Sun MD」の国内販売を開始

Sun Microsystemsが今年1月に発表したコンテナ型データセンター「Sun Modular Datacenter」の国内販売が10月1日に決まった。コンテナ型データセンターの市場がいよいよ動き始める。 - SGIのDNAはデータセンターに根付くか

日本SGIは、データセンターサーバ事業への進出を発表。Rackableによる買収を経た新生米SGIが生み出したCloudRackなどを携え、新たな勝負を開始する。  無能なITマネジャーと呼ばれないためのキーワードは「PUE」

無能なITマネジャーと呼ばれないためのキーワードは「PUE」

グリーンITが叫ばれる中、サーバの消費電力に目がいってしまうITマネジャーは筋が悪いといわざるを得ない。エネルギーコストをどう削減するかを考えるに当たって、圧倒的な電力効率を持つモバイルデータセンターがHPからリリースされた。その秘密に迫ってみたい。 Sun、輸送コンテナ型データセンターを投入

Sun、輸送コンテナ型データセンターを投入

米Sun Microsystemsは、輸送用コンテナにデータセンター機能を組み込んだ「Project Blackbox」の名称を変更し、製造、医療、通信分野の企業向けに提供を開始した。 今年最大の関心事は「電力」「冷却」:氷、コンテナ、液体冷却――エネルギー最適化への果てしない道

今年最大の関心事は「電力」「冷却」:氷、コンテナ、液体冷却――エネルギー最適化への果てしない道

データセンターにおけるエネルギーの最適化が叫ばれる中、管理者は日々頭を悩ませている。夜中に氷を作って日中の冷却に用いるなど、各企業のさまざまなアプローチを探る。 目指せ電力消費削減:「冷却」から考えるグリーンIT

目指せ電力消費削減:「冷却」から考えるグリーンIT

サーバコンピュータをはじめとするハードウェアの進化は、性能の向上の一方、今日のデータセンターに多くの課題をもたらした。中でも深刻なのが発熱を抑える「冷却」に関する課題だ。 今年最大の関心事は「電力」「冷却」:氷、コンテナ、液体冷却――エネルギー最適化への果てしない道

今年最大の関心事は「電力」「冷却」:氷、コンテナ、液体冷却――エネルギー最適化への果てしない道

データセンターにおけるエネルギーの最適化が叫ばれる中、管理者は日々頭を悩ませている。夜中に氷を作って日中の冷却に用いるなど、各企業のさまざまなアプローチを探る。 サン、輸送可能なDC“ブラックボックス”を披露

サン、輸送可能なDC“ブラックボックス”を披露

サン・マイクロシステムズは、輸送用コンテナにデータセンター機能を組み込んだ「Project Blackbox」を披露。システムを1度構築してさまざまな場所に運んで使うことができ、従来のデータセンターに比べて設置スペースが10分の1で済むのが特徴だ。- “冷却不要”のデータセンター実現へ

冷却設備を必要とせず、消費電力を大幅に削減できるデータセンターが将来実現する可能性があるか? の問いに、全員一致で「イエス」と答えたという。