スマートスピーカーが“ゴール”とは限らない? ヤフーが考えるこれからの音声技術の勝負どころ(2/2 ページ)

音声アシスタントや音声エージェントサービスなど、私たちにとって身近な存在になった音声サービス。それはどんな技術で作られ、どんな風に進化しようとしているのか。音声技術を積極的に開発しているというヤフーに聞いてみた。

音声理解の苦労は「言い方のバリエーション」

音声理解に必要な単語処理や構文処理は、自然言語処理と重なる部分が多い。Yahoo! JAPAN研究所で自然言語処理などを研究している颯々野学氏(同研究所 部長 情報学博士)は「音声対話や音声理解をやる前からヤフーは自然言語処理の分野に取り組んできた」と話す。

「テキスト中の『どの部分が固有名詞なのか』『地名なのか人名なのか』などを判定したり、文の構造を解析するシステムを作ったり……といったベーシックなところは全て取り組んでいて、それらを適宜音声理解へ利用している」(颯々野氏)

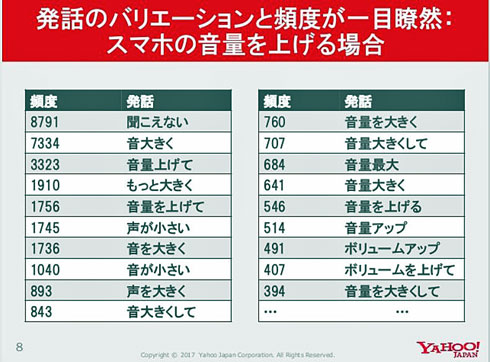

しかし長年研究を続けていても、実際にユーザーが利用することで初めて見えてきた課題もあるという。それは「言い方のバリエーション」だ。「あることをする時、どのような言い方をするかのバリエーションは、私たちが思っているよりもずっと多い。お客さまの言った通りに理解するのは実は難しい」と颯々野氏は言う。

同社がYahoo!音声アシストで5年にわたって蓄積した音声ログデータを調べたところ、スマートフォンの音量を上げるために使われた言葉で最も多いのは「聞こえない」だったという。他にも「声が小さい」「音が小さい」といった言い方もあれば、「音大きく」「音量上げて」や、「音量アップ」「ボリュームアップ」などの言い方もある。

「実際にユーザーに利用してもらいながらシステムを作っているので、皆さんがどういう表現をどれくらいするのか、ある程度分かってきた。今後は対応範囲を広げ、ユーザーにとってより自然な表現で意図が通じるようにしたい」(颯々野氏)

これからの音声技術の勝負どころ

今後の音声技術について三宅氏は「個人的な見解だが、3年後、5年後には音声認識の精度はどこも同じくらいになると思っている」と話す。だからこそ「音声から得られるコンテキスト――話者は男性か女性か、カフェテリアにいるのかテレビを見ているのか、などを理解し、ユーザーの体験を良くするために生かしていくのがわれわれの勝負どころだ」(三宅氏)と考えているという。

そのための取り組みの1つが、雑音やノイズのある場所での認識精度の向上だ。これまでは雑音の少ないクリーンな音声のデータを中心に機械学習を行ってきたが、クリーンな音声にさまざまな雑音を組み合わせて作った「雑音下で話しているような疑似音声データ」もたくさん学習させることで、雑音にも強い音声認識技術を開発しているという。

今後音声技術は、同社のサービスやアプリを中心に活用していく考えだ。一方で、スマートスピーカーのような新しいデバイスを開発する可能性もゼロではないという。

ヤフーの執行役員でデータ&サイエンスソリューション統括本部長である塚本浩司氏は「今のスマートスピーカーがゴールではないだろうと考えている」と話す。

「宅内というエリアの『解』はスマートスピーカーではないかもしれない。突然別のデバイスが出てくる可能性もある。そうした可能性に備えて常に新しい技術の研究を続けている」(塚本氏)

三宅氏も「日本ではまだスマートスピーカーは広く一般層に対しては普及していないが、どうなるかはまだ分からない。最先端の技術に置いていかれるとずっと置いていかれてしまうので、技術のキャッチアップは大切だ」と話した。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

ヤフー、音声認識にディープラーニング導入 騒音下での認識精度向上

ヤフー、音声認識にディープラーニング導入 騒音下での認識精度向上

ヤフーが自社の音声認識エンジンにディープラーニングを導入した。 ヤフーのスパコン「kukai」 ヤフートップや音声認識技術に活用

ヤフーのスパコン「kukai」 ヤフートップや音声認識技術に活用

7月28日の決算説明会で、ヤフーの宮坂社長がスーパーコンピュータ「kukai」の活用について言及。コンテンツのパーソナライズ精度向上などに役立てるという。 自然な音声作る「WaveNet」の衝撃 なぜ機械は人と話せるようになったのか

自然な音声作る「WaveNet」の衝撃 なぜ機械は人と話せるようになったのか

流ちょうな日本語を発声するスマートスピーカー。「こんな音声合成ができるにはあと10年かかると思っていた」と研究者は衝撃を受けている。これを実現したWaveNetとは何か。スマートスピーカーを作る技術がどんなものかを研究者に聞く。 「声を自由に変えられる技術」でコミュニケーションはどう変わる?

「声を自由に変えられる技術」でコミュニケーションはどう変わる?

特定の他人の声になれる、音声変換技術はコミュニケーションにどのような影響を及ぼすのか。