ファッション写真から服やアクセを抽出する「Fashionpedia」 Googleなどが開発:Innovative Tech

ファッションフォトから専門的な分類を行う。

Innovative Tech:

このコーナーでは、テクノロジーの最新研究を紹介するWebメディア「Seamless」を主宰する山下裕毅氏が執筆。新規性の高い科学論文を山下氏がピックアップし、解説する。

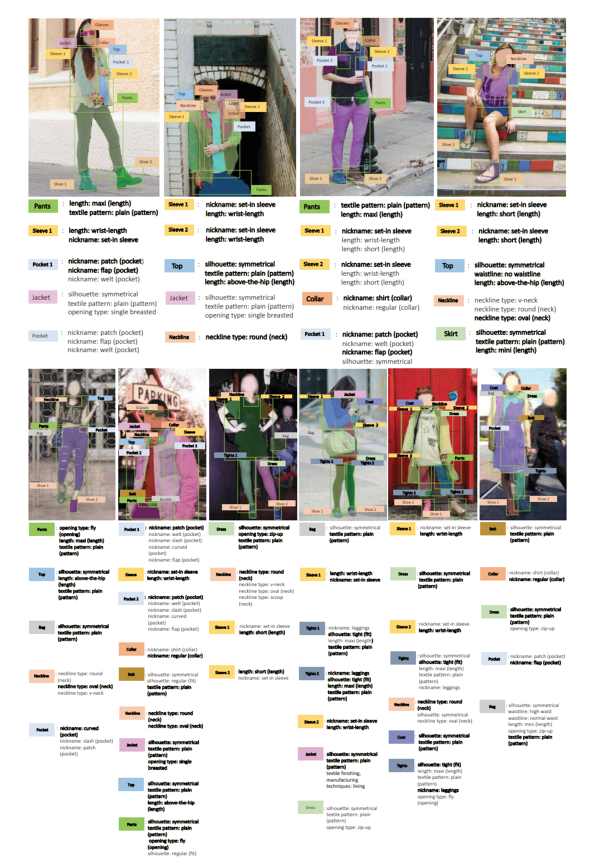

コーネル大学、コーネルテック、Google Research、Hearst Magazinesからなる米国の研究チームが開発した「Fashionpedia」は、ファッション画像から、衣服やアクセサリーを細かく分類するシステムだ。画像内の物体が重なっていてもピクセル単位で区別しマスク化し、それぞれに属性を付与する。

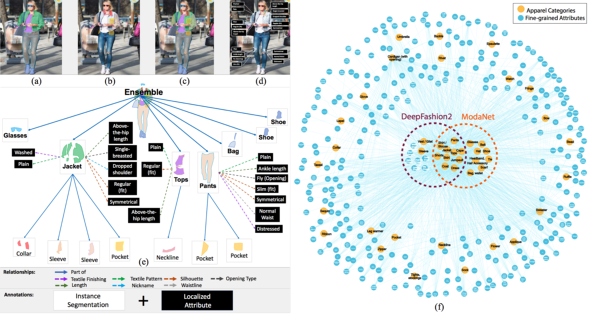

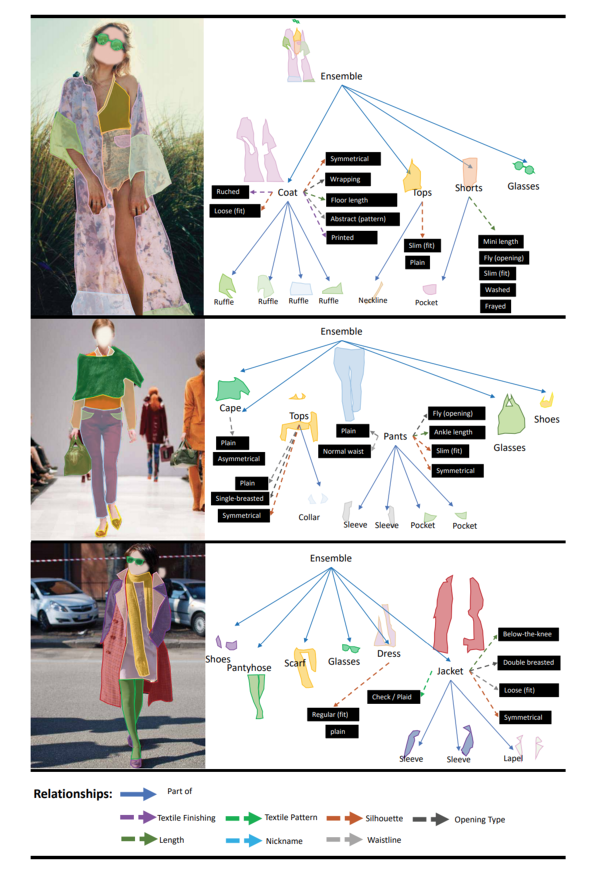

このシステムは、27の主要なアパレルカテゴリ(ジャケット、ドレス、パンツなど)、19のアパレルパーツ(襟、袖、ポケット、ボタン、刺繍など)、294の細かい属性とそれらの関係を含める「オントロジー」(専門家によって構築された、ベースとなる概念定義)と画像データセットで構成。オントロジー内の衣服とパーツ、カテゴリ、属性の関係を利用することでナレッジグラフを作成できる。

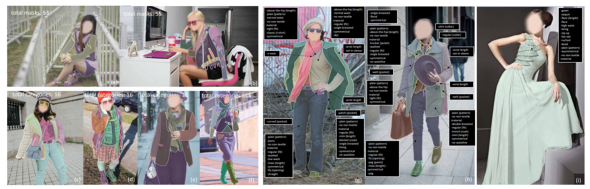

画像データセットには合計4万8825枚(日常生活、ストリートスタイル、セレブイベント、ランウェイ、オンラインショッピングなど)の着衣画像が含まれ、オントロジーを用いた衣料品のセグメンテーションと、カテゴリの細かい属性をアノテーションしている。平均して、画像1枚あたりのマスク数は7.3個。

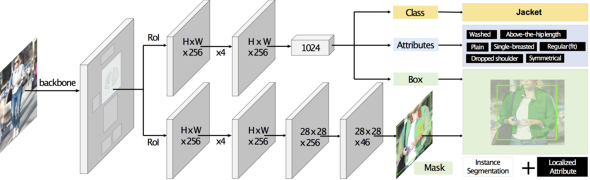

物体検出やセグメンテーション手法であるMask R-CNNをベースとしたモデル「Attribute-Mask RCNN」を設計した。

この手法で学習されたモデルは、オンラインショッピングにおける商品レコメンデーションの改善、視覚的な検索結果の強化、テキストクエリにおけるファッション関連ワードの名前解決など、多くの応用が可能であるとしている。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

スクリーンが動いても高速追従 液体レンズを使ったAFプロジェクションマッピング

スクリーンが動いても高速追従 液体レンズを使ったAFプロジェクションマッピング

動的なプロジェクトマッピングで課題となっていたフォーカス問題を解消する。 20機の小型ロボット群をハンドジェスチャーで直感操作 スタンフォード大など開発

20機の小型ロボット群をハンドジェスチャーで直感操作 スタンフォード大など開発

群ロボットの操作を不慣れなユーザーがしやすいようにした。 一般人が撮影したネット上の写真から建物を高品質に3D化するGoogleの機械学習技術

一般人が撮影したネット上の写真から建物を高品質に3D化するGoogleの機械学習技術

観光客が撮影してネットで公開している写真を利用できる。