ニュース

歯でジェスチャー入力 機械学習で13パターンを区別 コーネル大など「TeethTap」開発:Innovative Tech(2/2 ページ)

島村ジョーのように加速はできないけど、奥歯をスイッチにすることはできる。

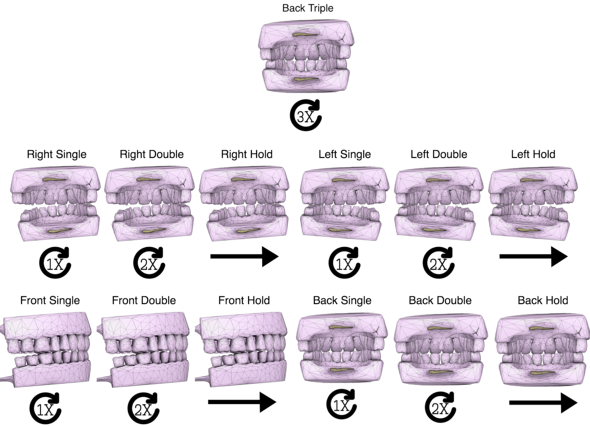

歯の入力は、歯を接触させる場所4つ(左側、右側、前後)と、接触させる方法4つ(シングルタップ、ダブルタップ、トリプルタップ、ホールド)を組み合わせた最大13種類の個別の歯のジェスチャーを認識する。

耳下の顎ラインに位置するIMUは、歯を動かした際に動く顎の上下左右の動きを検出し、コンタクトマイクは歯を噛んだ際の音響信号を皮膚の上から検出する。コンタクトマイクは、音響信号の増幅とフィルタリングを行うカスタマイズされたPCBボードに接続されている。

フィルタリングされた音響データとIMUからのジャイロスコープデータは、コンピュータに無線で送られ処理。コンピュータ側では、機械学習アルゴリズムによって最大13種類の歯のジェスチャーに分類する。

入力ジェスチャー13種類の分類精度をテストした実験では、平均90.9%の結果を示した。後ろで噛むトリプルタップに関しては、99.1%以上と最も精度が高かった。片側だけにセンサーを配置した場合の精度も計測した結果、噛んだ位置を必要としないタッチのみの認識に関しては片側のセンサーだけでも十分だと分かった。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

表裏に同時投影できるスクリーン NTTドコモの「ヤヌスの投影」

表裏に同時投影できるスクリーン NTTドコモの「ヤヌスの投影」

ヤヌスの鏡ならぬヤヌスのスクリーン。 炭酸飲料の刺激を強化するコップ 飲むと同時に電気刺激 法政大学が開発

炭酸飲料の刺激を強化するコップ 飲むと同時に電気刺激 法政大学が開発

コップの電気パワーで炭酸マシマシに。 音声に合わせ顔の動きを深層学習で作成 Adobeなど「MakeItTalk」開発

音声に合わせ顔の動きを深層学習で作成 Adobeなど「MakeItTalk」開発

リアルな写真からアニメキャラまで、深層学習によりリップシンクと表情の転写を行う。