TikTokも未成年保護の新たな取り組み InstagramやGoogleに続き

TikTokは未成年保護のための新たな取り組みを発表した。ダイレクトメッセージの初期設定をオフにするなどだ。未成年保護に関する発表は、Instagram、Apple、Googleに続くものだ。

中国ByteDance傘下の米TikTokは8月12日(現地時間)、13歳〜17歳のユーザーを保護するための新たな4つの取り組みを発表した。向こう数カ月かけて世界でロールアウトしていく計画だ。

ダイレクトメッセージ設定をデフォルトで「オフ」に(16歳〜17歳)

ダイレクトメッセージは、ユーザー同士が非公開でやりとりするメッセージ。昨年4月から16歳未満は使えなくなっている。今回の改定で、16歳〜17歳のユーザーの場合、ダイレクトメッセージは初期設定で「オフ」にする。設定は「誰でも」「友達のみ」「オフ」のいずれかから選ぶようになっているが、自分からダイレクトメッセージを発信する際も積極的に初期設定を変更しなければならなくなる。

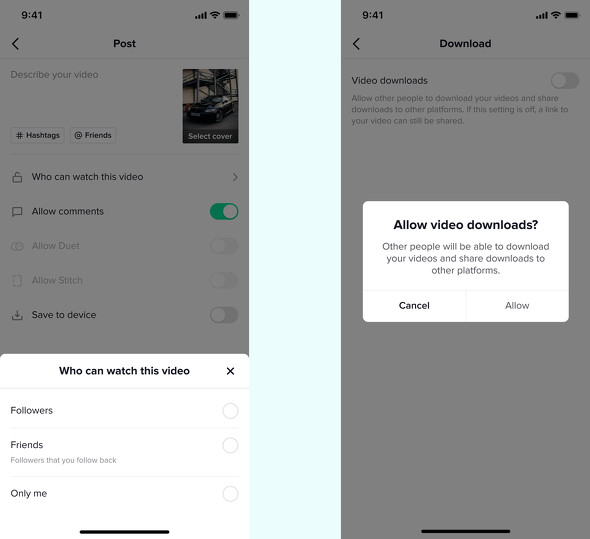

初動画投稿時、「動画を見ることができる人」を選択するよう通知(16歳未満)

16歳未満のユーザーが初めて動画を公開する際、ポップアップカードで動画を視聴できる相手を選択するよう求める。選択肢は「公開」「フォロワー」「友達」「非公開」の4段階。

自分の動画のダウンロードを許可するか投稿ごとに尋ねる(16歳〜17歳)

16歳〜17歳のユーザーが公開設定で動画を投稿する際、投稿ごとにその動画の他者によるダウンロードを許可するかどうかを尋ねるポップアップを表示するようになる。ダウンロードを許可すると、その動画は別のプラットフォームで勝手に公開される可能性がある。

なお、16歳未満のユーザーの公開動画はダウンロードできないようになっている。

未成年保護については、この数カ月の間に、米FacebookのInstagram、米Apple、米Googleが取り組みを発表した。米Axiosは、各社が英国政府が9月に施行するネットを利用する未成年を守るための新たな法律に備えていると指摘した。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

Google、未成年向け広告ターゲティング制限他、多数の保護対策を世界で実施へ

Google、未成年向け広告ターゲティング制限他、多数の保護対策を世界で実施へ

Googleは、18歳未満のユーザーを保護する多数の機能制限を発表した。例えばYouTubeを含むすべてのサービスでの18歳未満向け広告で、年齢・性別・関心に基づくターゲティングをブロックする。18歳未満では「セーフサーチ」をデフォルトでオンにする。 Apple、児童保護目的でユーザーの「メッセージ」とiCloudの「写真」の画像検出を実施へ

Apple、児童保護目的でユーザーの「メッセージ」とiCloudの「写真」の画像検出を実施へ

Appleは児童保護の目的でユーザーのコンテンツを検出する機能を追加する。「メッセージ」とiCloudの「写真」が対象。まずは米国で年内に開始する計画だ。 Instagram、16歳(18歳)未満アカウントの初期設定を非公開に 広告にも制限

Instagram、16歳(18歳)未満アカウントの初期設定を非公開に 広告にも制限

Facebookが傘下のInstagramを含むサービスで若いユーザーを保護する新機能を複数発表した。Instagramでは16歳未満がサインアップする際、初期設定で非公開にする。また、アクティビティに基づく広告ターゲティングを禁止する。 TikTok、16歳未満のアカウントは初期設定非公開、おすすめ表示オフに

TikTok、16歳未満のアカウントは初期設定非公開、おすすめ表示オフに

若いユーザーが多いTikTokが、18歳未満ユーザーのアカウントの設定を変更した。16歳未満は初期設定が「非公開」、デュエット設定は「自分のみ」で変更不可など厳格になった。