Appleのフェデリギ上級副社長、児童ポルノ検知ソフト批判に回答

Appleが導入すると発表した児童ポルノ画像の検知・通報ソフトウェアについて、クレイグ・フェデリギ上級副社長がインタビューに応じた。

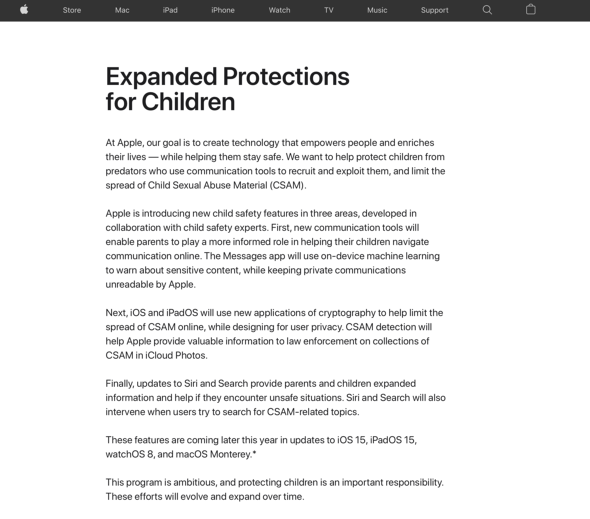

Appleが発表した子どもたちへの保護の拡充機能「Expanded Protections for Children」に関して、Appleのソフトウェアエンジニアリング担当上級副社長であるクレイグ・フェデリギ氏へのインタビューを、WSJが公開している。

フェデリギ氏は、児童ポルノ画像の検知・通報ソフトウェアに関して、公平な監視が可能との認識を示すとともに、2つの機能を同時に発表したことが混乱を招く要因になったと話した。

1つ目の機能は児童の性的な画像について、AppleのクラウドストレージサービスであるiCloudに保存されている既存の画像と照合するもので、2つ目は、子どもがテキストメッセージでやり取りした画像を親が監視しやすくするもの。これらを同時に発表したことで「多くのメッセージがごちゃ混ぜになった」とし、「もう少し分かりやすくすればよかった」と弁明している。

Appleの手法では、既知の児童ポルノ画像と一致する件数が一定の水準に達した場合にのみ、それも問題の画像に限定されると説明。「風呂に入っている子どもの写真を持っているどうかを分析するようなことではない。あるいは、他の種類のポルノ画像を持っているかどうかということもだ」と述べている。

iMessage(メッセージ)を通じた画像の送受信で子どもを保護する機能については、性的な画像が含まれているとiPhone搭載ソフトが検知したメッセージは親に報告されるが、Appleには報告されない。

Copyright (C) 1998 Mac Treasure Tracing Club. All rights reserved.

関連記事

物議をかもすiPhone内の“児童ポルノ画像検知”にAppleがFAQ公開 「メッセージは見ない」「他の写真は検知しない」

物議をかもすiPhone内の“児童ポルノ画像検知”にAppleがFAQ公開 「メッセージは見ない」「他の写真は検知しない」

Appleが児童性的虐待コンテンツ(CSAM)対策として米国でiOS/iPadOS 15から実施すると発表した新機能が物議を醸している。Appleはそれらの懸念に応えるFAQを公開した。 Apple、児童保護目的でユーザーの「メッセージ」とiCloudの「写真」の画像検出を実施へ

Apple、児童保護目的でユーザーの「メッセージ」とiCloudの「写真」の画像検出を実施へ

Appleは児童保護の目的でユーザーのコンテンツを検出する機能を追加する。「メッセージ」とiCloudの「写真」が対象。まずは米国で年内に開始する計画だ。 「Appleにはあなたのデータとプライバシーを守る責任がある」とクックCEO

「Appleにはあなたのデータとプライバシーを守る責任がある」とクックCEO

Appleのティム・クックCEOは、「iPhone SE」などを発表したイベントの冒頭で、FBIへの協力拒否問題に触れ、「われわれはデータとプライバシーを保護する責任から逃れるつもりはない」と語った。