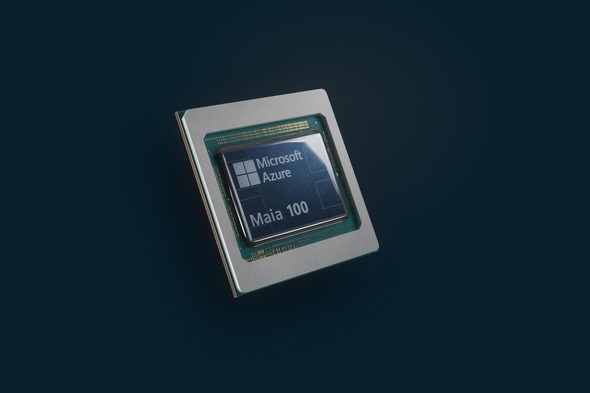

Microsoft、AI最適化チップ「Azure Maia 100」と汎用Armチップ「Azure Cobalt」:Microsoft Ignite

Microsoftは2つのカスタム設計チップ、AIに最適化した「Maia 100」とArumベースの汎用「Cobalt 100」を発表した。「インフラストラクチャスタックのすべての層を最適化して統合することが重要」とガスリー氏。

米Microsoftは11月15日(現地時間)、開発者向け年次イベント「Microsoft Ignite」で、2つのカスタム設計チップ、AIに最適化した「Microsoft Azure Maia 100 AI Accelerator」(以下「Maia 100」)とArmベースの汎用「Microsoft Azure Cobalt 100 CPU」(以下「Cobalt 100」)を発表した。

Microsoftは現在、Azureデータセンターで主に米NVIDIAのGPUを採用しているが、「インフラストラクチャスタックのすべての層を最適化して統合することが重要」だとクラウドおよびAIグループのエクゼクティブバイス・プレジデント、スコット・ガスリー氏は公式ブログで語った。「自社製チップの追加は、すべての要素がMicrosoftクラウドおよびAIワークロードに合わせて調整されるようにする方法」だとしている。

これと並行して、2024年にはNVIDIAの最新GPU「H200」も追加していく計画だ。また、米AMDのアクセラレーションVM「MI300X」をAzureに追加することも発表した。

パートナーのチップやハードウェアに自社製チップを追加することで、顧客に価格と性能の選択肢を増やすとしている。

Maia 100は、1050億個のトランジスタを含む5ナノメートルチップ。Azureハードウェアスタック専用で、Microsoft Azure上で実行される最大規模の内部AIワークロードの一部を強化する。MicrosoftはMaiaの設計を米OpenAIと共有し、OpenAIは改良で協力した。同社のサム・アルトマンCEOは「AzureのAIアーキテクチャはMaiaによってシリコンに至るまで最適化されており、より有能なモデルをトレーニングし、そのモデルを顧客に安価に提供する道を切り開く」と語った。

Cobalt 100は、クラウドネイティブ製品でより高い効率と性能を提供するよう最適化されている。データセンター全体でのワット当たりの性能を最適化することが目的。

Maia 100とCobalt 100は、2024年初頭にAzureデータセンターへの展開を開始する予定。Microsoftの一連のCopilotやAzure OpenAI Serviceなどのサービスを強化していく計画だ。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

Microsoft、「Bing Chat」を「Copilot」にリブランド GPTも作れる「Copilot Studio」も発表

Microsoft、「Bing Chat」を「Copilot」にリブランド GPTも作れる「Copilot Studio」も発表

Microsoftは2月に立ち上げた“AI採用のWebの副操縦士”「Bing Chat」の名称を「Copilot」にリブランドした。法人向け「Copilot」には商用データ保護が適用される。また、「GPTs」やカスタムCopilotを作れる「Copilot Studio」も立ち上げた。 NVIDIAのファンCEOがCOMPUTEXで披露した生成AI関連製品まとめ

NVIDIAのファンCEOがCOMPUTEXで披露した生成AI関連製品まとめ

NVIDIAは「COMPUTEX 2023」で、多数の生成AI関連製品を発表した。大容量AIスパコン「DGX GH200」やゲームキャラに命を吹き込む「Avatar Cloud Engine」など、ジェンスン・ファンCEOが発表した主な製品をまとめてみた。 Microsoft、生成系AI支援のVMをAzureでプレビュー開始 NVIDIA H100搭載

Microsoft、生成系AI支援のVMをAzureでプレビュー開始 NVIDIA H100搭載

MicrosoftはNVIDIAのH100を8基搭載する仮想マシン(VM)「Azure ND H100 v5」の提供をプレビューとして開始した。大規模で複雑な生成系AIモデルのトレーニング向けだ。「Azureは大規模な変革型AIワークロードを開発、実行するための場だ」とスコット・ガスリー氏。 AWS、クラウド基盤用のカスタムチップ「AWS Nitro v5」発表 パケット処理能力など向上 AWS re:Invent 2022

AWS、クラウド基盤用のカスタムチップ「AWS Nitro v5」発表 パケット処理能力など向上 AWS re:Invent 2022

AWSがクラウド基盤用のカスタムチップ「AWS Nitro v5」を発表。パケット処理能力が60%向上し、レイテンシは30%減少、電力当たりの能力は40%改善したという。Nitro v5を用いた新しい「C7gn」インスタンスも発表した。