ニュース

Appleの研究者、マルチモーダルLLM「MM1」の論文発表 視覚タスクではGPT-4Vに匹敵

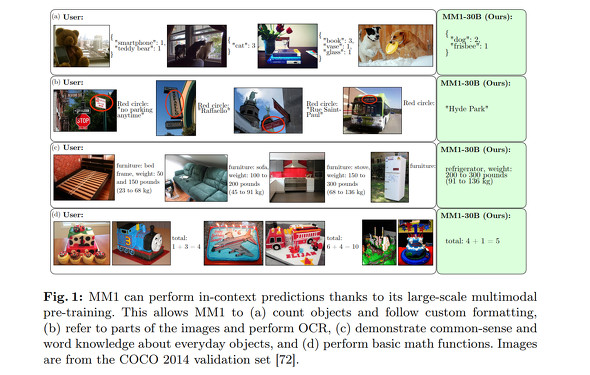

Appleの研究者は、独自開発のマルチモーダルLLM「MM1」の論文を発表した。画像へのキャプション追加や画像とテキストを使った質問への回答、自然言語推論を行えるよう設計。サイズはコンパクトながら視覚タスクではOpenAIのGPT-4Vに匹敵するとしている。

米Appleの研究者らは3月14日(現地時間)、独自開発のマルチモーダルLLM(MLLM)「MM1」の論文を発表した。画像へのキャプション追加や画像とテキストを使った質問への回答、自然言語推論を行えるよう設計したとしている。

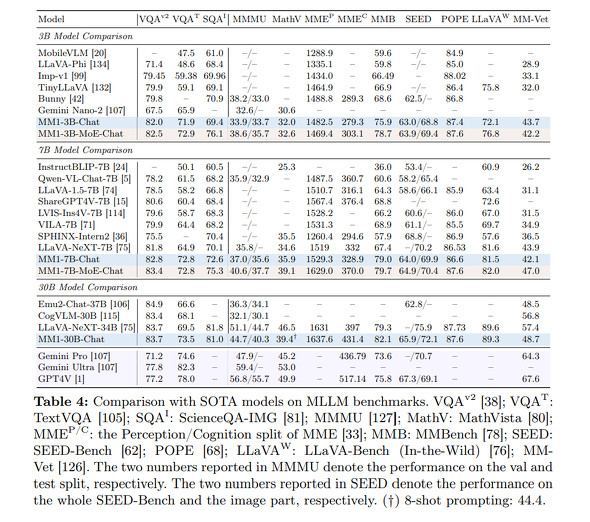

MM1は、画像とテキストのペア、画像とテキストの混合データ、テキストのみのデータの混合でトレーニングされている。Mixture-of-Experts(MoE)や教師あり微調整でパラメータを300億までスケールアップすることで、比較的コンパクトなサイズでも競合するMLLMに匹敵する結果をベンチマークで達成したとしている。

視覚タスクでは、米OpenAIの「GPT-4V」や米Googleの「Gemini」に匹敵している。

MM1のアーキテクチャなどは公開されていない。Appleの研究者らは論文の結論を「ここで得られた知見が、コミュニティが特定の単一モデルアーキテクチャやデータ戦略を超えて、強力なモデルを構築するのに役立つことを願っている」と結んだ。

Appleの研究者らは、昨年12月ごろから複数のLLM関連の論文を発表してきた。

Appleのティム・クックCEOは2月の業績発表で、年内にAI分野で進行中の取り組みの詳細を共有すると語った。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

Apple、UCSBと共同でマルチモーダルLLM採用のテキストベースの画像編集「MGIE」発表

Apple、UCSBと共同でマルチモーダルLLM採用のテキストベースの画像編集「MGIE」発表

AppleとUCSBの研究者らは、マルチモーダル大規模言語モデル(MLLM)によるテキストベースの画像編集ツール「MGIE」を発表した。Hugging Faceでデモを試すこともできる。 Apple、5四半期ぶりの増収 「年内にAIの取り組みの詳細を共有する」とクックCEO

Apple、5四半期ぶりの増収 「年内にAIの取り組みの詳細を共有する」とクックCEO

Appleの10月〜12月期の決算は、増収増益だった。増収は5四半期ぶり。クックCEOは「AIの取り組みの詳細を年内に共有する」と語った。 Apple、iPhone上でのLLM実行を可能にする手法の論文を発表

Apple、iPhone上でのLLM実行を可能にする手法の論文を発表

Appleは「LLM in a flash:Efficient Large Language Model Inference with Limited Memory」という論文を発表した。メモリ容量が限られた端末上でLLMを実行するための革新的な手法を編み出したとしている。 AI一色にはならなかったWWDCでAppleが発表したAI関連まとめ

AI一色にはならなかったWWDCでAppleが発表したAI関連まとめ

AppleのWWDC 2023では、「生成AI」というバズワードはほぼ使われなかった。とはいえ、MRヘッドセットの「Persona」など幾つかの“機械学習”採用技術が発表された。本稿ではそれを簡単にまとめた。 Appleは「何年も前から生成AIを研究している」 クックCEOが米CNBCのインタビューで語る

Appleは「何年も前から生成AIを研究している」 クックCEOが米CNBCのインタビューで語る

米Appleが発表した2023年度第3四半期決算に関して、米CNBCがティム・クックCEOへのインタビューを実施。そこで、Appleは何年も前から生成系AIに取り組んできたと語ったと伝えている。