Databricks、“オープン”な汎用LLM「DBRX」リリース 商用利用可

AI企業のDatabricksは“オープンな”汎用LLM「DBRX」をリリースした。サイズは1320億パラメータとMetaのLlama 2のほぼ2倍だが、速度もLlama 2の2倍という。

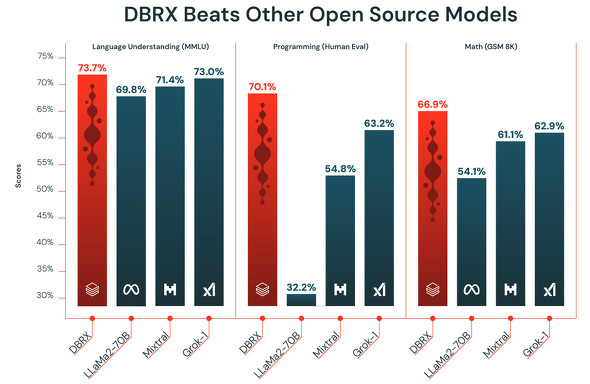

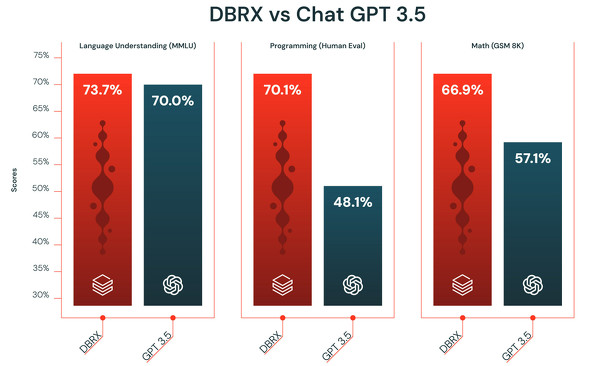

米AI企業のDatabricksは3月27日(現地時間)、“オープンな”汎用LLM「DBRX」を発表した。同社によると、DBRXは標準的なベンチマークで既存のすべてのオープンモデルより優れたパフォーマンスを発揮するという。ただし、マルチモーダルではない。

DBRXは、オープンソースプロジェクトMegaBlocksに基づいて構築されたMoE(Mixture of Experts;混合エキスパート)を採用した。このMoEは、他のMoEと比較してトレーニング速度が2倍以上、計算効率も最大2倍になるという。

サイズは1320億パラメータと米MetaのLlama 2のほぼ2倍だが、速度はLlama 2の2倍という。言語理解、プログラミング、数学、ロジックのベンチマークで、Llama 2 70B、仏Mistral AIのMixtral 8x7B、米XのGrok-1、米OpenAIのGPT-3.5を上回っているとしている。

DBRXは、3.2TbpsのInfinibandで接続された3072基のNVIDIA H100を使用して、パブリックデータソースとライセンス供与されたデータソースで3カ月トレーニングし、品質および安全性の改善のための人間のフィードバックを収集し、モデルを手動で実験した。

基本モデル(BRX Base)と微調整モデル(DBRX Instruct)をHugging Facedeから入手し、研究および商用目的で自由に利用できる。開発者は、Databricksプラットフォーム上で独自のデータに基づいたカスタムDBRXモデルを構築することもできる。

DBRXをプライベートにホスティングしたい場合は、Databricks Marketplaceからモデルをダウンロードし、Model Servingでモデルをデプロイできる。少なくとも4基のH100を搭載したPCあるいはサーバが必要だ。

あるいは、Databricksの従量課金制プランに加入して「Databricks Mosaic AI Foundation Model API」を使うことで、すぐに使い始められる。

商用利用向けに、パフォーマンス保証、ファインチューンされたモデルのサポート、追加のセキュリティとコンプライアンスを提供するプロビジョニングされたスループットオプションも提供している。

Databricksは2013年創業の米カリフォルニア州サンフランシスコに拠点を置くAI企業(日本にも支社がある)。Lakehouse、Apache Spark、Delta Lake、MLflowの開発者らによって設立された。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

楽天グループが大規模言語モデルを公開 Mistralベースの70億パラメータ 商用利用も可能

楽天グループが大規模言語モデルを公開 Mistralベースの70億パラメータ 商用利用も可能

楽天グループは、日本語に特化した大規模言語モデル(LLM)「Rakuten AI 7B」などを公開した。フランスのAIスタートアップ企業のMistral AIのLLM「Mistral-7B-v0.1」を基盤に開発した70億パラメータのLLM。商用利用も可能。 イーロン・マスク氏のxAI、LLM「Grok-1」をオープンに

イーロン・マスク氏のxAI、LLM「Grok-1」をオープンに

イーロン・マスク氏のAI企業xAIは、予告通りLLM「Grok-1」の基本モデルの重みとアーキテクチャをオープンソース化した。GitHubでApache 2ライセンスで配布している。マスク氏はXでChatGPTのアカウントに「“オープン”について説明して」とコメントした。 Google、オープンな生成AIモデル「Gemma」公開 商用利用OK、Geminiと同じ技術の軽量LLM

Google、オープンな生成AIモデル「Gemma」公開 商用利用OK、Geminiと同じ技術の軽量LLM

米Googleは、大規模言語モデル(LLM)「Gemma」を公開した。同社が開発するLLM「Gemini」に使ったのと同じ技術を活用して開発した軽量版LLMで、同社は「オープンなAIモデル」として位置付けている。商用利用も可能としている。 機械に話しかけて設定できる時代が来る? なぜ“小規模”なLLMが求められるのか

機械に話しかけて設定できる時代が来る? なぜ“小規模”なLLMが求められるのか

LLMにおいて、学習パラメータ数は性能に直結する。一方で、注目を集めているのがLLaMaのような小規模なモデルだ。それはなぜか。