Apple、iPhoneでも稼働するオープンな言語モデル「OpenELM」を公開

Appleは、iPhoneでも稼働するオープンソースの言語モデル「OpenELM」をHugging Faceで公開した。iPhoneやMac上でモデルを実行できるようにするライブラリも公開した。

米Appleの研究者らは4月24日(現地時間)、オープンソースの言語モデル「OpenELM」(ELMはEfficient Language Model、効率的な言語モデルの略)をHugging Faceで公開した。

パラメータ数の異なる4つのモデルがある。小さいものから、2億7000万、4億5000万、11億、30億(パラメータとは、意思決定でモデルがトレーニングデータセットから理解する変数の数を示す)。

AppleがAIのモデルを公開することはこれまでほとんどなかったが、OpenELMの「広範なリリースは、オープンな研究コミュニティを支援し、発展させることが目的」という。

Appleは、OpenELMとともに、開発者がモデルをソフトウェアに組み込めるように設計された複数のツールもオープンソース化した。その中にはiPhoneやMac上でモデルを実行できるようにするライブラリも含まれる。

「公開データセットで学習されたモデルは安全性の保証なしでリリースされる」ため、利用する開発者は自分で「十分なセーフティテストを実施し、適切なフィルタリング機構を実装することが不可欠」だとしている。

AppleはOpenELMを、約1兆8000億のトークンで構成されるデータセットでトレーニングしたとしている。データセットとしては、GitHubのRedPajamaデータセット、大量の書籍、Wikipedia、StackExchangeの投稿、ArXiv上の論文、Reddit、Wikibooks、Project GutenbergなどのDolmaセットを使った。

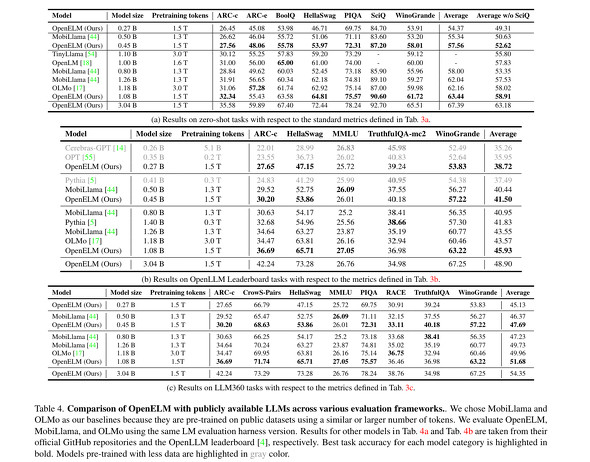

OpenELMは、レイヤーごとのスケーリング戦略を用いて、Transformerモデルの各レイヤー内でパラメータをefficient(効率的)に割り当てることで精度を向上させているという。例えば10億パラメータでは、Allen Institute for AIのOLMoと比較して半分の事前学習トークン数で2.36%の精度向上を示すとしている。

米Microsoftも前日、iPhoneで稼働可能なSLM「Phi-3」を公開している。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

次世代Siri? Apple、画面内の状況を理解できるAI「ReALM」を論文発表 GPT-4超えとアピール

次世代Siri? Apple、画面内の状況を理解できるAI「ReALM」を論文発表 GPT-4超えとアピール

米AppleのMachine Learning Researchが、論文投稿サイト「arXiv」において「ReALM: Reference Resolution As Language Modeling」を発表した。ReALMは、画面上の物体への曖昧な言及や、会話での背景の文脈を理解し、音声アシスタントより自然なやりとりを可能にする新たな人工知能システムだという。 iPhone、Googleの生成AI「Gemini」搭載か Appleが交渉中との報道

iPhone、Googleの生成AI「Gemini」搭載か Appleが交渉中との報道

米Appleは、米Googleの生成人工知能(AI)「Gemini」をiPhoneに搭載する方向で交渉を行っている。米Bloomberg Newsが3月18日、関係者の話として報じた。 Appleの研究者、マルチモーダルLLM「MM1」の論文発表 視覚タスクではGPT-4Vに匹敵

Appleの研究者、マルチモーダルLLM「MM1」の論文発表 視覚タスクではGPT-4Vに匹敵

Appleの研究者は、独自開発のマルチモーダルLLM「MM1」の論文を発表した。画像へのキャプション追加や画像とテキストを使った質問への回答、自然言語推論を行えるよう設計。サイズはコンパクトながら視覚タスクではOpenAIのGPT-4Vに匹敵するとしている。 Apple、UCSBと共同でマルチモーダルLLM採用のテキストベースの画像編集「MGIE」発表

Apple、UCSBと共同でマルチモーダルLLM採用のテキストベースの画像編集「MGIE」発表

AppleとUCSBの研究者らは、マルチモーダル大規模言語モデル(MLLM)によるテキストベースの画像編集ツール「MGIE」を発表した。Hugging Faceでデモを試すこともできる。 Apple、iPhone上でのLLM実行を可能にする手法の論文を発表

Apple、iPhone上でのLLM実行を可能にする手法の論文を発表

Appleは「LLM in a flash:Efficient Large Language Model Inference with Limited Memory」という論文を発表した。メモリ容量が限られた端末上でLLMを実行するための革新的な手法を編み出したとしている。