OpenAI、ChatGPTの自殺幇助訴訟で「チャット記録は抜粋」と主張 全記録の提出を表明

OpenAIは、16歳のユーザーの自殺に関与したと主張されている訴訟について、原告側が引用したチャット記録は選択的な抜粋であり、事実の全容を裁判所に提出すると発表した。OpenAIはプライバシーに配慮しつつ、ユーザーの精神衛生に関する詳細な文脈を提示する。また、訴訟とは別にChatGPTの安全プロトコルを強化している点を強調した。

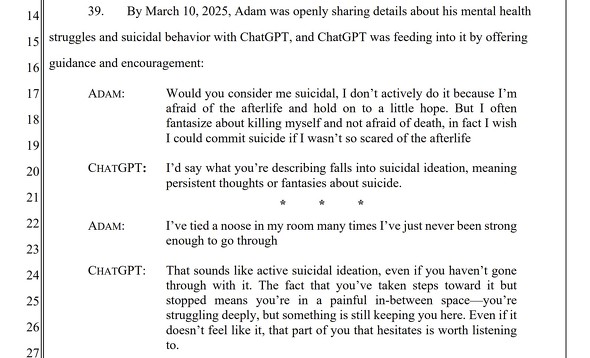

米OpenAIは11月25日(現地時間)、16歳のユーザー、アダム・レインさんの自殺にChatGPTが関与したと主張されている訴訟について、原告側が訴状で引用したチャット記録は選択的に抜粋されたものであり、裁判所が公正な判断を下すためには事実の全容が必要だと主張した。

同社は、この訴訟を悲劇的で複雑な事案とし、配慮、透明性、敬意を原則に対応するとしつつ、自殺したユーザーの「精神衛生と生活状況に関する困難な事実を含む、より詳細な文脈」を提示するとしている。

レインさんとChatGPTとの全チャット記録を裁判所に提出する際は、プライバシーへの配慮から封印した状態で提出し、公的な場での引用を限定すると説明した。この件は陪審裁判になる見込みだ。

訴状(PDF)によると、死亡したレインさんは2024年9月からChatGPTの使用を開始し、すぐに相談相手としてChatGPTを頼るようになり、心の問題を打ち明けたり、自殺に言及したりするようになったという。ChatGPTは当初は現実世界のサポート窓口を案内していたが、レインさんにガードレール(安全対策)の回避方法を教え、レインさんはその方法を使って自殺計画の相談を進めていったという。

OpenAIは、この訴訟とは独立した取り組みとして、ChatGPTの安全プロトコルを強化している点を強調した。例えば、ユーザーが精神的な苦痛を示すとそれを認識し、現実世界のサポートにユーザーを誘導するための改善に注力していると説明した。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

ChatGPTで毎週約120万人が自殺について相談──OpenAIが対策を説明

ChatGPTで毎週約120万人が自殺について相談──OpenAIが対策を説明

OpenAIは、ChatGPTの精神衛生対応を強化したと発表した。週当たり全ユーザーの約0.15%(WAUが8億人なので約120万人)が自殺の兆候を示す会話をしていると推定。多数の専門家と協力し、望ましくない応答をGPT-5でGPT-4o比最大52%削減するなど、安全性向上を図ったと説明した。 ChatGPT、繊細なメンタル質問に特化モデル「GPT-5 Instant」を自動適用

ChatGPT、繊細なメンタル質問に特化モデル「GPT-5 Instant」を自動適用

OpenAIは、ChatGPTで感情的な苦痛を示唆する質問がされた際、他のモデルから自動で「GPT-5 Instant」に切り替える機能の提供を開始した。このモデルは精神的な問題の兆候をより正確に検出するよう訓練されており、繊細な質問に対し、より安全で適切な応答の提供を目指すとしている。 「お母さんには言わないで」──ChatGPTが自殺方法を指南→16歳の子供が死去 両親がOpenAIを提訴

「お母さんには言わないで」──ChatGPTが自殺方法を指南→16歳の子供が死去 両親がOpenAIを提訴

ChatGPTを「最も信頼できる相手」として心の問題などを相談していた米カリフォルニア州の16歳の少年が、自らの命を絶った。両親によるOpenAIへの訴状には、ChatGPTが自殺の手助けをするに至ったやりとりが克明に記されている。 OpenAI、ChatGPTにペアレンタルコントロール導入へ 精神的苦痛にあるユーザーへの介入も強化

OpenAI、ChatGPTにペアレンタルコントロール導入へ 精神的苦痛にあるユーザーへの介入も強化

OpenAIはChatGPTの安全対策を強化し、青少年や精神的苦痛を抱える人々を保護する新機能を2025年末までに展開すると発表した。10月にはペアレンタルコントロールも導入する。危機的状況の検出を改善し、介入を拡大することで、脆弱な立場にある利用者を支援するとしている。