OpenAI、生命科学特化のAIモデル「GPT-Rosalind」発表 創薬の効率化を目指す

OpenAIは、生命科学に特化した新推論モデル「GPT-Rosalind」を発表した。創薬やゲノミクス研究の加速を目的とし、50以上の科学ツールと連携する。安全性を考慮し、提供は審査を通過した適格組織に限定する。名称はDNA構造解明に貢献したロザリンド・フランクリンにちなんだ。

米OpenAIは4月16日(現地時間)、生命科学分野に特化した推論モデル「GPT-Rosalind」を発表した。生物学、創薬、トランスレーショナル医療の研究を支援するために開発したモデルで、化学、タンパク質工学、ゲノミクスへの理解に加え、科学研究で使うツールの活用能力を高めたとしている。

OpenAIは、新薬の標的探索から米国での規制当局の承認取得までには一般に10〜15年程度かかると説明する。創薬の初期段階で標的選定や仮説立案、実験の質を高められれば、その後の工程にも効果が波及する一方、生命科学の研究は大量の論文、専門データベース、実験データ、仮説をまたいで進める必要があり、作業は時間がかかり分断されやすいという。こうした事情から、AIによって文献や証拠の統合、仮説生成、実験計画などの多段階の研究作業を加速し、発見の初期段階を前進させることを狙う。

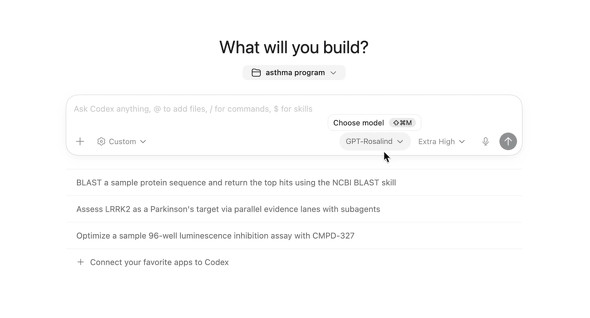

想定する用途としては、分子、タンパク質、遺伝子、経路、疾患関連の生物学をまたぐ推論に加え、文献レビュー、配列から機能の解釈、実験計画、データ解析などを挙げた。さらに、「Codex」向けに無償の「Life Sciences research plugin」も公開し、50を超える科学ツールやデータソースと接続できるようにする。人類遺伝学、機能ゲノミクス、タンパク質構造、生化学、臨床エビデンス、公的研究の探索などに対応するとしている。

人命に関わる研究での事故や生物学的な悪用を避けるための対策として、同社はこのモデルを「Trusted Access for Cyber」(TAC)を通じて提供する。まずは米国の適格な企業顧客向けに限定し、利用資格やガバナンスに関する厳格な統制を設ける。参加組織には、公共的利益の明確な、かつ適切な科学研究であること、適切なガバナンスやコンプライアンス、悪用防止の統制を備えること、承認された利用者に限定した安全な環境で運用することなどを求める。加えて、企業向けの強化されたセキュリティ管理とアクセス管理を採用し、必要に応じて追加情報の提出も求めるとしている。

GPT-Rosalindは研究プレビューとして、TACを通過した適格顧客向けにChatGPT、Codex、APIで提供する。研究プレビュー期間中は既存のクレジットやトークンを消費しないが、不正利用を防ぐためのガードレールを設けるとしている。名称は、DNAの構造解明に貢献し、現代の分子生物学の基礎を築いた英国の科学者ロザリンド・フランクリンに由来する。

競合する米Anthropicは1月、医療およびライフサイエンス分野に向けた「Claude」の提供内容を拡充したと発表している。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

OpenAI、サイバー防衛特化AI「GPT-5.4-Cyber」発表──Anthropicに続き限定公開で防御側を支援

OpenAI、サイバー防衛特化AI「GPT-5.4-Cyber」発表──Anthropicに続き限定公開で防御側を支援

OpenAIは、サイバー防衛強化プログラム「Trusted Access for Cyber」(TAC)の拡充と専用モデル「GPT-5.4-Cyber」の導入を発表した。身元確認済みの専門家に限定し、通常は制限されるバイナリ解析などの高度な防御ワークフローを可能にする。少数のインフラ企業に絞るAnthropicに対し、より広範な防衛者への支援を目指す方針だ。 OpenAI、医療系スタートアップ買収 「ChatGPT ヘルスケア」強化へ

OpenAI、医療系スタートアップ買収 「ChatGPT ヘルスケア」強化へ

米OpenAIは、医療系スタートアップの米Torchを買収したと発表した。ChatGPT上で使える健康支援機能「ChatGPT ヘルスケア」の機能を強化する狙い。 OpenAI、医療機関向け「OpenAI for Healthcare」発表 HIPAA準拠で組織導入を支援

OpenAI、医療機関向け「OpenAI for Healthcare」発表 HIPAA準拠で組織導入を支援

OpenAIは、医療機関向けの新たな枠組み「OpenAI for Healthcare」を発表した。個人向け「ChatGPT Health」とは異なり、病院などの組織がHIPAA準拠の環境でAIを運用するための専用製品を提供する。データをモデルの学習には使わず、高度な暗号化により、機密性の高い患者情報の安全な取り扱いを可能にするとしている。 OpenAIとロスアラモス国立研究所が提携 マルチモーダルAIの悪用可能性を評価する

OpenAIとロスアラモス国立研究所が提携 マルチモーダルAIの悪用可能性を評価する

OpenAIとロスアラモス国立研究所は、バイオサイエンスの研究現場におけるAIの安全性と有効性を評価するための提携を発表した。「GPT-4o」などのマルチモーダルAIモデルが、悪意ある生物学的用途にどのように利用される可能性があるかを理解することに焦点を当てる。