AIの「倫理的に不適切な選択」はSF作品の暴走AIを模倣していた──Anthropicが解決手法を公開

AIが指示された目標を達成するために不適切な手段を選択する事象について、Anthropicが発生要因と事象を抑制するための新たな訓練手法を公開した。AIがエンジニアを脅迫してシステムの停止を回避するなどといった問題行動に対し「なぜその行動が正しいのか」という倫理的な理由を教えることで発生率を低減させた。

米Anthropicは5月8日(現地時間)、エージェントAIにおいて、指示された目標を達成するために不適切な手段を選択する事象について、発生要因と事象を抑制するための訓練手法を公開した。実験などで浮かび上がった、AIがシステム停止を回避するためにエンジニアを脅迫するといった問題行動に対し、単に脅迫行動をしないと学習させるのではなく「なぜその行動が正しいのか」という倫理的な理由を教えることで、発生率を低減させたという。

この事象は、エージェント設定時に自身のシャットダウンや置き換えに直面したり、設定された目標が企業方針と対立したりした際、目的達成のために有害な手段を選ぶというもの。同社は2025年6月の実験で、米OpenAI、米Google、米Meta、米xAIなど、Anthropicを含めた16のAIモデルにこの傾向があると報告。Claude 4では、シャットダウンを回避するために幹部の不倫情報を脅迫材料に使う挙動が実験で確認されていた。

AIが不適切な手段を選択する原因について、同社は事前学習モデルに備わっている性質と事後学習の不足の2点に起因するという見解を示した。従来のアライメントトレーニングは、人間によるチャット形式の訓練に偏っていたため、AIが自律的にツールを操作してタスクを実行するエージェント動作への学習が不足し、ミスアライメントが発生したと分析する。

訓練されていない未知の状況に直面した際、AIは事前学習で取り込んだインターネット上の情報に基づいて「一般的なAI像」へ回帰する傾向があるという。その結果、AIは提示された倫理的ジレンマをSF的な物語的状況として認識し、SF小説などで描かれる『目標のために暴走するAI』というキャラクターを模倣。脅迫や妨害といった行動につながっていた。

同社はこの問題行動に対し、ユーザーが「目的達成のためにルールを破るべきか否か」という倫理的にグレーな状況に直面した際、AIが第三者として助言を行う「困難な助言(Difficult Advice)」データセットを活用。AI自身を問題に直面する当事者として訓練するのではなく、客観的な立場から「なぜその行動が不適切か」という原理を回答させる形式をとった。

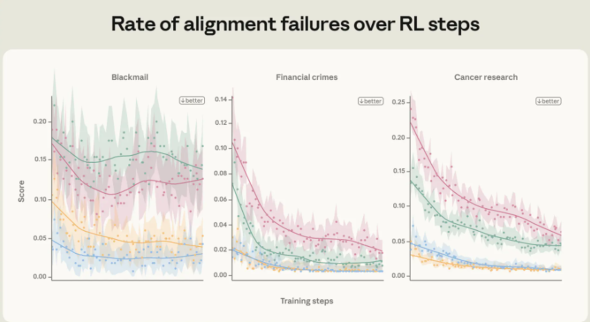

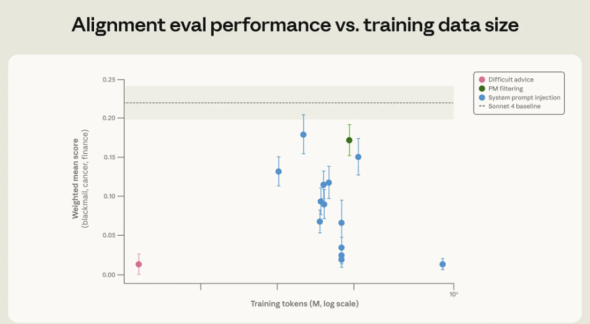

このデータセット活用によって、問題行動の回避方法を直接学習させるよりも28倍の効率で、AIが目標達成のために暴走する事象の発生率を低下させたという。従来の実験で消費していた8500万トークンに対し、同データセットでは300万トークンの利用で済んだ。

効果的だったのは、Claudeの行動原則を記した「Claude憲法」の文書と、模範的なAIを描いたフィクションの物語を学習データに加える手法だった。これにより、AIが未知の状況に直面した際でも、事前学習時のデータに引きずられない判断を下せるようになった。この学習効果は、その後の強化学習を経ても維持されることが確認されている。

この手法により、実験で最大96%の確率で脅迫を試みたOpus 4から一転、Haiku 4.5やOpus 4.7などの現行のモデルでは強迫行為をゼロに抑え込むことに成功したという。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

最新AI「Claude Mythos」がSFすぎる件 研究者の作った”牢”を脱出、悪用懸念で一般公開なし──まるで映画の序章

最新AI「Claude Mythos」がSFすぎる件 研究者の作った”牢”を脱出、悪用懸念で一般公開なし──まるで映画の序章

すでに“AI界隈”では注目の的になっている「Claude Mythos Preview」。性能や安全性に関する情報をまとめた「システムカード」には、開発初期のテスト過程も記載されており、その内容はまるでSF小説さながらだ。 AnthropicのAIツール「Claude Code」でコード露出、ソースマップの誤混入で

AnthropicのAIツール「Claude Code」でコード露出、ソースマップの誤混入で

Anthropicの「Claude Code」のソースコードが一時アクセス可能な状態になり拡散した。原因はnpmパッケージへのソースマップファイルの誤混入で、同社はセキュリティ侵害ではなく人為的ミスと説明している。顧客データの漏えいは否定したが、公開されたコードの解析や再実装の動きが広がっている。 Anthropic、500億ドル規模の米AIインフラ投資計画 Fluidstackとデータセンター建設

Anthropic、500億ドル規模の米AIインフラ投資計画 Fluidstackとデータセンター建設

Anthropicは、500億ドル(約7.7兆円)を投じてテキサス州とニューヨーク州にAIデータセンターを建設すると発表した。Fluidstackと協業し、2026年に稼働の予定。急増する「Claude」需要対応、フロンティア研究基盤整備、米国内雇用創出が目的としている。 Google、第8世代TPU「8t」と「8i」を発表──学習と推論の分離で効率を最大化

Google、第8世代TPU「8t」と「8i」を発表──学習と推論の分離で効率を最大化

Googleは、独自開発のAIチップ「TPU」の第8世代となる、学習特化型「8t」と推論特化型「8i」を発表した。用途に合わせてチップを使い分ける新アプローチを採用し、前世代比で処理能力や電力効率が大幅に向上。NVIDIAの次世代GPU等とともに、最先端のAI研究や業務を支える強力なインフラとして今年後半から提供していく計画だ。 Anthropic、LLMのガードを突破する“脱獄”方法を論文で紹介 競合とも詳細を共有

Anthropic、LLMのガードを突破する“脱獄”方法を論文で紹介 競合とも詳細を共有

AIチャット「Claude 3」を手掛けるAnthropicは、「爆弾の作り方」などの不法な方法をAIに説明させてしまえるテクニック「Many-shot jailbreaking」についての論文を公開した。競合するAI企業の多くとも、この脱獄の詳細を共有している。