Facebook、AIフレームワーク「PyTorch 1.0」公開 Instagramのデータで訓練したモデルも

Facebookが開発者会議F8の2日目の基調講演で、AIフレームワーク「PyTorch 1.0」の公開、Microsoftと立ち上げた「ONNX」でのGoogle TensorFlow他複数のツールのサポートなど、AI関連の取り組みについて発表した。

米Facebookは5月2日(現地時間)、年次開発者会議「F8 2018」の2日目の基調講演で、AI(人工知能)関連の取り組みについて発表した。

同社のマイク・シュローファーCTO(最高技術責任者)はオープニングで、同社はフェイクニュースや嫌がらせなどの投稿対策にAIを活用しており、2018年の1〜3月にはISISとアルカイダの約200万件の投稿を削除し、その99%は人間の報告より前だったと説明した。

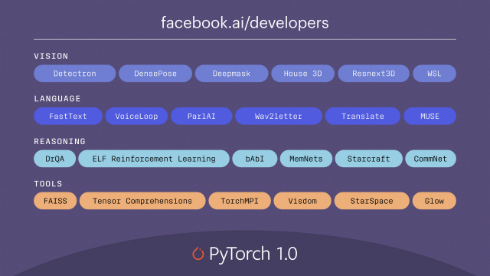

AIフレームワーク「PyTorch 1.0」のリリース

オープンソースのAIフレームワーク「PyTorch 1.0」のβ版を向う数カ月中に公開する。同社が2016年に公開した「PyTorch」(バージョン0.1.6)をよりフレキシブルにしたもの。

ONNXの拡大

ONNX(Open Neural Network Exchange)は、Facebookと米Microsoftが昨年9月に発表した異なるAIフレームワーク間でディープラーニングモデルを移行しやすくするオープンフォーマット。発表段階ではFacebookの「Caffe2」と「PyTorch」、Microsoftの「Cognitive Toolkit(CNTK)」をサポートしていた。

現在サポートするツールは以下のものだ。

- Apple Core ML

- Google TensorFlow

- Microsoft Cognitive Toolkit

- AWS Apache MXNet

- Caffe2

- PyTorch

- PyTorch 1.0

- Baidu PaddlePaddle

- Qualcomm SNPE

Instagramの公開画像で訓練した機械学習モデルや翻訳ライブラリも公開

PyToch 1.0の言語ライブラリである「Translate」、動画モデルの「ResNext3D」などもオープンソースで公開する。

Instagramで公開された画像とハッシュタグを機械学習で利用

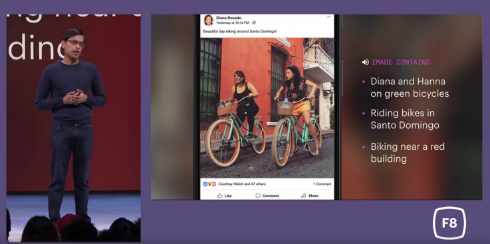

基調講演では、同社のAIの取り組みの一例として、同社傘下のInstagramに投稿されたハッシュタグ付きの35億件の写真を使った新しい画像認識モデルのトレーニングについて説明した。

ユーザーが付けたハッシュタグを写真の分類に利用したという。そのためにAIにとっては雑音が多く不正確なラベルであるハッシュタグを実用化するために新たな技術を開発し、ImageNetのベンチマークで85.4%の正確性を実現した。

フレームワークやライブラリ、モデルは同日公開の公式サイト「Facebook.ai」で入手できる。

F8の2日目の基調講演の録画はこちらで視聴できる。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

Facebook Messenger、シンプルになり、翻訳やARエフェクトも追加へ

Facebook Messenger、シンプルになり、翻訳やARエフェクトも追加へ

Facebookが、Facebook Messengerのデザイン変更、翻訳機能、企業botによるARエフェクトプロモーションを発表した。 MicrosoftとFacebook、AI開発者向けオープンソースプロジェクト「ONNX」

MicrosoftとFacebook、AI開発者向けオープンソースプロジェクト「ONNX」

AI分野で競合するMicrosoftとFacebookが、開発フレームワーク間のスイッチングを可能にするためのオープンソースプロジェクト「Open Neural Network Exchange(ONNX)」でタッグを組んだ。Facebookの「Caffe2」と「PyTorch」、Microsoftの「Cognitive Toolkit(CNTK)」が対応する。 Facebook、“交渉する”botをオープンソースで公開

Facebook、“交渉する”botをオープンソースで公開

Facebookが、人間のような戦術を使いながら目的のために相手と交渉するbotを開発したとして、そのコードをオープンソースで公開した。 Facebook、ディープラーニングフレームワーク「Caffe2」をオープンソースに

Facebook、ディープラーニングフレームワーク「Caffe2」をオープンソースに

Facebookが、ディープラーニングへの門戸を開放する目的で、AIアルゴリズムを構築・実行できるオープンソースのフレームワーク「Caffe2」をGitHubで公開した。NVIDIAやMicrosoftが協力している。 Facebook、AI画像認識技術「DeepMask」などをオープンソース化

Facebook、AI画像認識技術「DeepMask」などをオープンソース化

Facebookが、写真に写っている物体を抽出してそれぞれの物体が何かを認知するコンピュータビジョン技術のコードをGitHubで公開した。