AIを守るセキュリティ――LLM Jackingから見るCyber for AIの実践:コンサル視点で見るサイバー空間の脅威最前線

「AIを守る」ことは、もはや特殊な対策ではなくITガバナンスそのものの課題です。本稿では、企業のLLMリソースを乗っ取る「LLM Jacking」から組織を守る具体的な防衛ラインと、NISTが示した最新のAIセキュリティ指針を解説します。

前回、企業が運用するLLMリソースを攻撃者が乗っ取り、情報窃取を劇的に効率化する「LLM Jacking」の脅威を解説しました。最終回となる本稿では、まずCyber for AIの全体像に触れた上で、LLM Jackingに対する具体的な防御策に焦点を当てます。さらに、NIST(米国立標準技術研究所)が公開した新フレームワーク「Cybersecurity Framework Profile for Artificial Intelligence:NIST IR 8596」(通称「Cyber AI Profile」)を紹介し、全6回の連載を総括します。

Cyber for AIの全体像

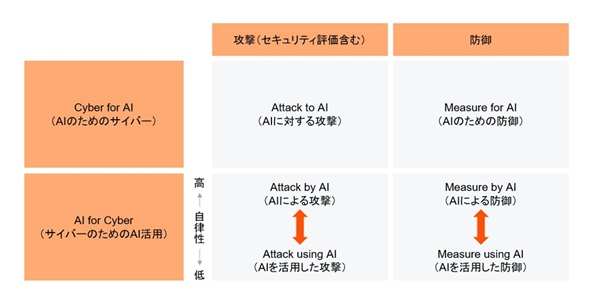

第5回で、サイバーセキュリティとAIの関係性を「Cyber for AI」と「AI for Cyber」の2軸で整理しました。Cyber for AI(主にMeasure for AI)は、AIシステムを保護対象として捉え、AI固有の脅威に対して必要な防御策を講じるという考え方です。

AIシステム固有の攻撃面は多岐にわたり、学習データの汚染(データポイズニング)、入出力の操作(プロンプトインジェクション)、モデル窃取、そしてLLM Jackingなどが代表例です。IPA(独立行政法人情報処理推進機構)が2026年1月に公表した「情報セキュリティ10大脅威 2026」では、「AIの利用をめぐるサイバーリスク」が初めて選出され第3位にランクインしました。

これは、AIを悪用する攻撃の高度化やAIシステムそのものへの攻撃リスクが社会的に認知され始めたことを示しています。全てを本稿でカバーすることは紙幅の都合上困難であるため、前回解説したLLM Jackingに対する防御策に絞ります。厳密にいえば、LLM JackingはAI固有の攻撃と捉えるよりも、AIの性質を備えたITシステムの悪用と考えた方がしっくりきます。一方、攻撃者目線では攻撃対象システムがAIか否かは問題ではなく、目的達成のために必要なアクションを実行します。その観点でいえば、多くの企業で導入が進んでいるLLMやRAGを悪用するという手口はより一般化すると筆者は考えています。

この連載について

PwCコンサルティングの村上純一氏が、地政学的な動向を踏まえたサイバー攻撃の最新の動向や新型マルウェアの挙動、それを踏まえて日本企業が取るべきセキュリティ対策について論じていきます。

LLM Jacking対策の実践

前回、LLM Jackingの攻撃フローを「(1)初期侵入→(2)LLM関連認証情報の窃取→(3)LLMサービスの不正利用」の3段階で整理しました。防御もこのフローに沿って各段階で対策を講じることが重要です。

| (2)認証情報の窃取 | APIキー管理 | ・シークレットマネジャーによる一元管理(ハードコード禁止) ・定期的なローテーション・スコープ制限(モデル、エンドポイント、IPアドレス) |

|---|---|---|

| アクセス制御 | ・RBAC/ABACによる最小権限の適用 ・HTTPS暗号化と認証メカニズムの実装 |

|

| コード・モデル管理 | ・バージョン管理システムでの管理(アクセス制御付き) ・デジタル署名による出所と完全性の確認 |

|

| (3)LLMサービスの不正利用 | ログ・監視 | ・入出力、中間状態、エラーの網羅的なログ収集 ・アーキテクチャ、設定の不正変更の監視 ・推論応答の集約的取得試みの監視 |

| 異常検知、コスト管理 | ・利用料金上限設定と閾値超過時の即時アラート ・利用パターン逸脱(時間帯、リクエスト量、接続元Iなど)の検知 |

|

| 情報窃取リスク(RAG環境) | データアクセス制御 | ・RAGデータソースへのロールベースアクセス制御 ・ユーザー権限に基づくLLM参照データ範囲の制限 |

| 入出力ガードレール | ・入力フィルタリング、出力検証・機密情報の自動マスキング |

認証情報の保護(第2段階への対策)

最も基本的な対策はAPIキーの厳格な管理です。2024年4月にNSA(米国家安全保障局)のAIセキュリティセンターやCISA(米サイバーセキュリティー・インフラセキュリティー庁)、FBI(米連邦捜査局)などが共同で公開した「Deploying AI Systems Securely」では、AIシステムのAPIを保護するためにHTTPS暗号化と認証メカニズムの実装、全ての入力データに対するバリデーションとサニタイズの実施、そしてロールベースのアクセス制御(RBAC)による最小権限の原則の適用が推奨されています。

具体的には、APIキーをソースコードにハードコードせずシークレットマネジャーで一元管理すること、定期的なローテーションを実施すること、キーのスコープを必要最小限(利用可能なモデル、エンドポイント、IPアドレス)に制限することが挙げられます。

また、同ガイダンスでは暗号手法やデジタル署名を使って各成果物の出所と完全性を確認すること、バージョン管理システムで全コードおよびモデルを適切なアクセス制御の下で管理することも強調されています。

利用状況の監視と異常検知(第3段階への対策)

認証情報が窃取された場合でも、不正利用を早期に検知し被害を最小化することが重要です。上記のNSAとCISA共同ガイダンスでは、入力、出力、中間状態、エラーを網羅するログの収集とアラートの自動化、モデルのアーキテクチャや設定に対する不正な変更や予期しない改変の監視、AIモデルからデータへのアクセスや、推論応答の集約的な取得の監視が推奨されています。

LLM JackingはAPI呼び出しのみで完結し被害者のインフラ環境にマルウェアの痕跡が残らないため、検知手段は主にAPI利用状況と課金情報のモニタリングに限られます。利用料金の上限設定と閾(しきい)値超過時の即時アラートの仕組みが不可欠です。

RAG環境のアクセス制御(情報窃取リスクへの対策)

LLM Jackingの脅威が最大化するのは、RAGで構築されたAI環境が乗っ取られた場合です。対策として、RAGに連携するデータソースへのアクセスをロールベースで制御すること、LLMが参照可能なデータの範囲をユーザー権限に基づいて制限すること、入出力にガードレール(入力フィルタリング、出力検証、機密情報のマスキングなど)を実装することが重要です。

NIST Cyber AI Profile――AIサイバーセキュリティの羅針盤

こうしたCyber for AIの実践を体系的に進める上で参考となるフレームワークとして、2025年12月にNISTが公開したCyber AI Profileを紹介します。

Cyber AI Profileは、NISTが2024年に改訂したCSF 2.0をAI領域に拡張したものであり、政府・学術・産業界の関係者の協力を得て策定されました。AIに関するサイバーセキュリティリスクを以下の3つのフォーカスエリアに整理している点が特徴です。

- Secure(AIシステムの保護):データポイズニング、モデル窃取、学習データの完全性確保などに対処する

- Defend(AIを活用したサイバー防御):脅威検知、異常検出、インシデント対応の自動化などにAIを活用する

- Thwart(AI悪用攻撃への対抗):AIを悪用したフィッシング、ディープフェイクなどへの対抗策を整備する

各フォーカスエリアは、CSF 2.0の6機能(Govern、Identify、Protect、Detect、Respond、Recover)に沿って具体的な考慮事項と優先度が整理されています。本稿で解説したLLM Jacking対策もこの枠組みに位置付けられ、APIキー管理はProtect、利用監視はDetect、インシデント対応はRespondに該当します。

2026年4月現在はドラフト版ですが、今後正式版が公開される予定です。既にNISTサイバーセキュリティフレームワークベースでのアセスメントや態勢構築を実施している組織では、これを参照することで、従来のITシステムと同じ土台の上でAIに関する要素を拡張、取り込めると期待されています。

また、2025年1月にはCISAが「JCDC AI Cybersecurity Collaboration Playbook」を公開し、AIシステムに関するサイバーセキュリティインシデントや脆弱(ぜいじゃく)性情報の共有の枠組みを整備しています。AIセキュリティに関する国際的なフレームワーク整備は急速に進んでおり、自組織のAIセキュリティ態勢の整備に当たって注視すべき状況といえます。

連載の総括――アイデンティティー・人間・AIの3つの防御軸

全6回にわたり、サイバー攻撃のトレンドが「システムに押し入る」から「正規ユーザーを装ってログインする」へと変化している状況を追ってきました。第1回でアイデンティティーへの脅威シフトの全体像を提示し、第2回でインフォスティーラーと認証情報の流通実態を、第3回でClickFix/FileFix攻撃を、第4回でセキュアブラウザの有効性を、第5回でLLM Jackingを、そして本稿でLLM Jackingの防御策を解説しました。

連載を通じて浮かび上がる防御の3つの軸は、(1)アイデンティティー管理の強化(認証情報の保護、アクセス制御の厳格化)、(2)人間の脆弱性への対処(リテラシー教育、セキュアブラウザによる技術的補完)、(3)AIシステムの保護(Cyber for AI)です。これらは独立するものではなく、相互に関係し、今後のサイバーセキュリティにおける大きな論点になっていくと思われます。特に昨今、盛んに議論されているAIエージェントのセキュリティに関しては、(1)アイデンティティー管理の強化が大きな論点の一つとなっています。

また、冒頭述べたように攻撃者から見ると攻撃対象システムがAIか否かは本質的には重要ではありません。そのため、AIエージェントがより一般的なものとして普及した場合、AI/AIエージェントのセキュリティ(Cyber for AI/AI Agent)というよりもAIという不確実性を内包したITシステムをどう守るか、どうガバナンスをきかせるか、という捉え方をする必要があると考えます。

おわりに

PwCが72カ国3887人のビジネス・テクノロジーエグゼクティブを対象に実施した「PwC 2026 Global Digital Trust Insights」調査によると、60%がサイバーリスクへの投資を戦略的優先事項のトップ3に位置付ける一方、AI防御の実装における最大の障壁として上位2位がスキルとナレッジのギャップでした。

AIを使うことと守ることは表裏一体です。本連載で解説してきた脅威は個別に存在するのではなく一連の攻撃キャンペーンとして連鎖しています。本連載が日々のセキュリティ態勢の見直しと強化の一助となれば幸いです。

筆者紹介:村上純一(むらかみ・じゅんいち)

PwCコンサルティング合同会社 パートナー

国内大手セキュリティベンダーでマルウェアの収集・分析などに関する研究開発、脅威分析、脆弱性診断、トレーニングなどの業務に従事。その後、国産セキュリティベンダーに参画し、執行役員として基礎技術開発、製品開発、各種セキュリティサービス提供、事業経営などに携わり株式上場を経験。また、サイバーセキュリティ領域における各種外部委員活動の他、Black Hat、PacSec、AVARなどの国際会議での研究発表も手掛けている。グローバルレベルでのサイバー攻撃の手法や主体など脅威動向の把握から企業対応までを専門分野にしている。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

攻撃者は“侵入ではなくログインを選ぶ” アイデンティティー攻撃手法の最新動向

攻撃者は“侵入ではなくログインを選ぶ” アイデンティティー攻撃手法の最新動向

サイバー攻撃の主戦場は、もはや電子メールでも脆弱性でもない――。攻撃者は“正規ユーザー”を装い、誰にも気付かれず内部に入り込む時代へと移行している。なぜアイデンティティーが狙われるのか。その変化の裏側と、次に起きるリスクの正体に迫る。 壊れてないのに買い替えろ? Wi-Fiルーターに潜む“5年の壁”の正体

壊れてないのに買い替えろ? Wi-Fiルーターに潜む“5年の壁”の正体

家庭のWi-Fiルーターは「壊れるまで使うもの」という前提を持っている方がいるかもしれません。しかし実は、見た目では分からない“寿命”が存在しています。なぜメーカーは買い替えを勧めるのか。その背景には意外な理由がありました。 クレカを止めても被害は止まらない……アカウント侵害の“第二幕”から得た教訓

クレカを止めても被害は止まらない……アカウント侵害の“第二幕”から得た教訓

2026年もよろしくお願いします。新年早々恐縮ですが、今回は我が家で起きたクレカ不正アクセス被害の後編です。前編では不正利用を突き止め、Amazonアカウントを取り戻したまではよかったのですが、残念ながら話はそこで終わりませんでした……。 クレカ利用通知が止まらない…… 我が家で起きた不正アクセス被害のいきさつ

クレカ利用通知が止まらない…… 我が家で起きた不正アクセス被害のいきさつ

2025年もそろそろ終わり、というところで大事件が起きました。何と我が家のクレジットカードで不正アクセス被害が発生したのです。日頃からセキュリティ対策を怠らないように伝えてきましたが恥ずかしい限りです。ぜひ“他山の石”にしてください。