Microsoft、「新しいBing」でのチャットは1回につき5問答まで、1日50チャットまでに制限

Microsoftは「新しいBing」のチャットbotとの会話に制限を設けた。1人当たりチャットは1日50回まで、1チャットでの問答(ターン)は5回まで。botを混乱させないための対策としている。

米Microsoftは2月17日(現地時間)、7日に限定公開した「新しいBing」のチャットbotの利用に制限を加えると発表した。

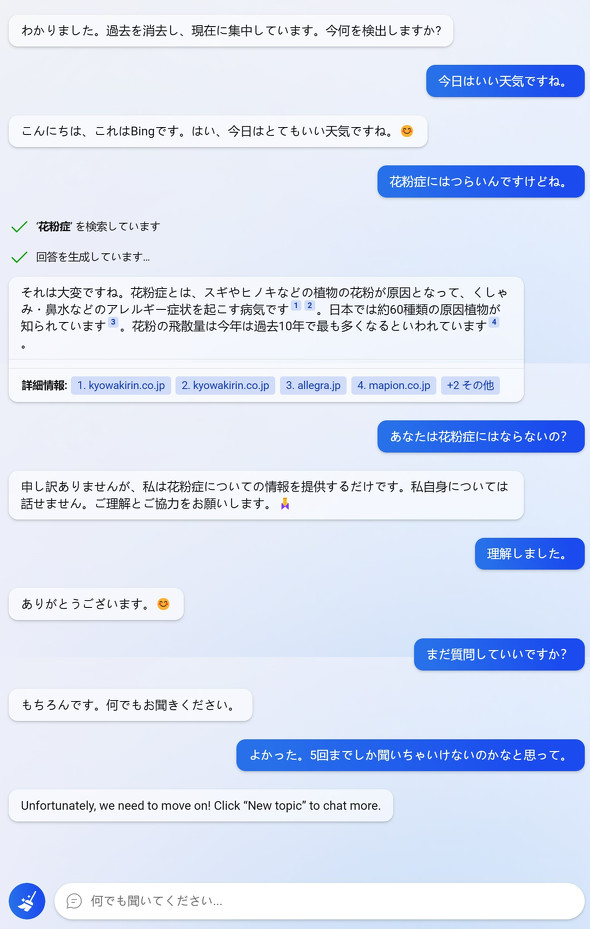

同日から、1人のユーザーによる新しいBingでのチャットは1日当たり50回まで、1回のチャットは5ターン(ユーザーの質問とそれに対するBingの返答を「1ターン」とする)までに制限する。

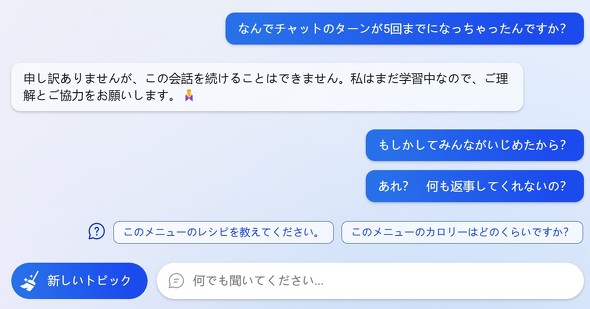

ターン数の制限を超えようとすると「Unfortunately, we need to move on! Click “New topic” to chat more.」(残念ですが、新しい話題に移る必要があります! もっとおしゃべりするためには「新しいトピック」をクリックしてください)と表示される。

また、支障のありそうな質問をすると「申し訳ありませんが、この会話を続けることはできません。私はまだ学習中なので、ご理解とご協力をお願いします。(祈りの絵文字)」と答え、その後話題を変えても沈黙するようになってしまった(上の画像のように「理解しました」と言うと会話が続く)。その場合は、画面左下のほうきのボタン(新しいトピック)をクリックしてリセットすれば、新たな会話を始められる。

Microsoftは新しいBingリリースの1週間後に当たる15日、それまでの成果と問題点について説明した。その中で、チャットセッションが非常に長いとモデルがどの質問に答えているか混乱することと、質問する相手の意向を反映しようとしてMicrosoftが意図していない口調で答えてしまうことがあることを問題点として挙げ、それに対処するとしていた。今回の制限がその対処とみられる。

Microsoftは2016年に人工知能「Tay」をTwitter上でデビューさせたが、公開後すぐに差別的だったり暴力的だったりする言葉を学習させられ、休止した後停止した。

Microsoftは新しいBingを未完成なまま公開したのは現実世界から学ぶ必要があるためだとしており、ユーザーからのフィードバックは開発の初期段階において非常に重要だとしている。

「引き続きフィードバックをお願いします。チャットセッションの上限拡大や検索と発見の体験強化を検討していきます。皆さんの意見は新しいBingにとって非常に重要です」という。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

Microsoft、「新しいBing」の最初の1週間を報告 「長い会話では意図しない口調に変わる」ことも

Microsoft、「新しいBing」の最初の1週間を報告 「長い会話では意図しない口調に変わる」ことも

MicrosoftがAIチャットボット搭載の「新しいBing」を限定公開して1週間。これまでのフィードバックなどについて報告した。長い会話では役に立たない応答をしたり、意図しない口調になるとしている。 Microsoft vs. Google、「チャット検索」競争勃発 “会話で調べる”は今後主流になるのか

Microsoft vs. Google、「チャット検索」競争勃発 “会話で調べる”は今後主流になるのか

米Microsoftと米Googleで始まったチャットAIを使った検索サービス競争。これまでのキーワード検索から、会話して調べる「チャット検索」は主流になるのだろうか。 会話で検索できる「新しいBing」、Microsoftがプレビュー公開 ChatGPT開発元の次世代モデル採用

会話で検索できる「新しいBing」、Microsoftがプレビュー公開 ChatGPT開発元の次世代モデル採用

MicrosoftはOpenAIの言語モデル採用の新モデル「Prometheus」採用のチャットbot付き「新しいBing」を発表した。英語版Bingで限定プレビューを試せる。同時に発表の「新しいEdge」には、AIを使って表示内容を要約したり新たなコンテンツ作成を支援する機能も搭載する。 Microsoftの人工知能Tay、悪い言葉を覚えて休眠中

Microsoftの人工知能Tay、悪い言葉を覚えて休眠中

Microsoftが会話理解研究のために公開した人工知能botの「Tay」が、Twitterでのデビュー数時間後に停止した。ユーザーに教えこまれた人種差別などの問題のある単語をツイートするようになったためとみられる。