ディープラーニングが激速に NVIDIAの牙城を崩せるか? SambaNovaに聞く:清水亮の「世界を変えるAI」(2/4 ページ)

ディープラーニングにおいて、NVIDIAのGPUは欠かせない。ディープラーニングにおいてはNVIDIAのGPUに勝るソリューションは存在しないというのが常識だった。しかし今、この常識に風穴を開けようとするシリコンバレーのスタートアップがある。SambaNova Systems社だ。

非ノイマン型のデータフロープロセッサとは?

――まず、データフロー型というものについて教えてください。従来のGPUとの違いは何でしょうか?

鯨岡氏 従来のGPUコンピューティングは、あくまでもノイマン型でした。ノイマン型というのは、ご存じだと思いますが、プロセッサがメモリからデータを読み書きしながら処理を行うわけです。

ディープラーニングでは大量のデータを同時並行的に処理する必要があるため、高速なメモリがないと処理が進まなくなってしまう。そこでGPUではHBMという非常に高速だが容量が小さく、高価なメモリを使わなければならない。ここがネックになって、GPUを使ったシステムは非常に高価な割に、大きなニューラルネットを1つのプロセッサ上に載せられないというジレンマがありました。

データフロー型では、このノイマン型のアプローチをやめ、演算ユニットから演算ユニットへ直接データが流れていきます。メモリとプロセッサの間をデータが往復するのではなく、演算ユニットから演算ユニットへデータを流し込んでいくのです。その結果、高速なメモリが不要になります。現在の実装では1TBのDDR4メモリを搭載しています。

――ちょっと待ってください。通常、GPUに搭載できるメモリ(HBM)は80GB程度が限界ですよね? それがデータフロー型だと1TBまで拡張できると、そう解釈していいんですか?

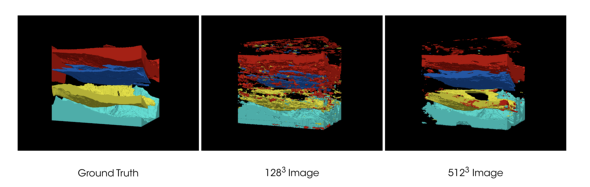

鯨岡氏 演算ユニットとメモリの間をデータが頻繁に往復しないので、DDRのような一般的なメモリで十分ということですね。例えば、実際にSambaNovaの再構成可能なデータフローユニット(Reconfigurable Dataflow Unit、RDU)でできることの例として石油開発のために地下の状況を分析する3次元セグメンテーションのタスクがあるんですが、このタスクで比較すると、GPUでは解像度が128x128x128くらいが限界なんですね。ところがRDUを使えば512x512x512と、一目瞭然と言って良いほどに解像度を上げられるわけです。

――すごいじゃないですか!

鯨岡氏 というわけで、最初は超高精細画像認識がすごいですよ、という売り込み方をしていたのですが、最近だと急激にGPTのような大規模言語モデル(LLM)の需要が高まってきまして、そちらでも当社のデータフロー型が有効ですよ、という話ができるようになってきました。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

仕事で使うGPT-4実践テクニック 実際に「AIアートグランプリ」の事務局で使ってみた

仕事で使うGPT-4実践テクニック 実際に「AIアートグランプリ」の事務局で使ってみた

第一回AIアートグランプリの興奮もさめやらぬなか、GPT-4があっさりと公開。せっかくなので、まずは第一回AIアートグランプリの報告書をGPT4にまとめてもらってみる。さらにChain of Thoughtでキャッチフレーズを考えさせるなど、事務局の仕事に活用してみた。 GPTを超える大規模言語アーキテクチャ「Hyena」とは何か?

GPTを超える大規模言語アーキテクチャ「Hyena」とは何か?

広く使われているGPT3やChatGPTといったいわゆる「Transformer(トランスフォーマー)」というモデルは、パラメータ数が多く、しかも計算量が膨大であるため、利用料金が高い上に動作が遅いと言う問題がある。Hyenaの特徴は、まずGPTに比べて計算量が圧倒的に少ないことだ。 AIで好きなポーズを出すために、モデルを10万枚撮影して手動でタグ付けしてみた

AIで好きなポーズを出すために、モデルを10万枚撮影して手動でタグ付けしてみた

最初にAIで漫画を描くときのハードルは、「同じキャラクターが出せない」というものだったが、これはDreambooth(Memeplexではカスタムモデル学習)を使うことで解決できた。次のハードルは、「欲しいポーズが出せない」というものである。 みんなどのくらいChatGPTに課金してるの? 読者調査結果

みんなどのくらいChatGPTに課金してるの? 読者調査結果

話題沸騰のChatGPTだが、実はどのくらいのユーザーが使っているのだろうか。また、月額20ドルの有料版への課金率はどのくらいなのか。技術への造詣が深く、AIへの関心も高いと想像される、ITmedia NEWSの読者に対してTwitterでアンケートをとってみた。 ChatGPTが職務経歴書を作成するサービス続々 エンジニア向けから看護師まで

ChatGPTが職務経歴書を作成するサービス続々 エンジニア向けから看護師まで

ファインディ(東京都品川区)は4月5日、ChatGPTとの対話からエンジニアの職歴をAIが自動生成する「ChatGPTからインタビュー受けてみた」をリリースした。