Google、Armベースの初カスタムCPU「Axion」発表 今年後半に提供へ

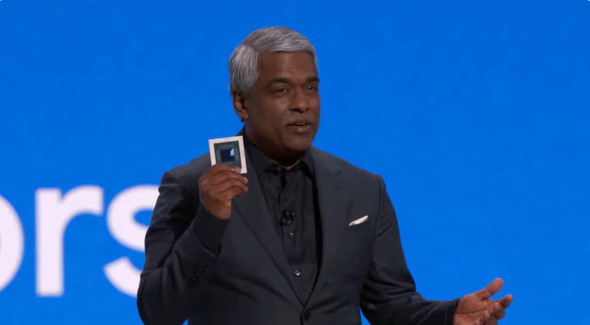

Googleは年次イベント「Google Cloud Next」で、同社初となるArmベースのカスタムCPU「Google Axion」を発表した。生成AIのトレーニングと推論に最適としており、今年後半に顧客への提供を開始する計画。

米Googleは4月9日(現地時間)、年次イベント「Google Cloud Next」の基調講演で、英ArmベースのカスタムCPU「Google Axion」を発表した。データセンター向けで、今年後半にGoogle Cloudの顧客に提供する予定。

GoogleはTPU(Tensor Processing Unit)など、2015年からカスタムチップを構築しているが、ArmベースのカスタムCPUはこれが初。

ARMv9アーキテクチャと命令セットを採用する「Neoverse V2」設計に基づいているということ以外、コア数やメモリ構成などの詳細は発表されていない。

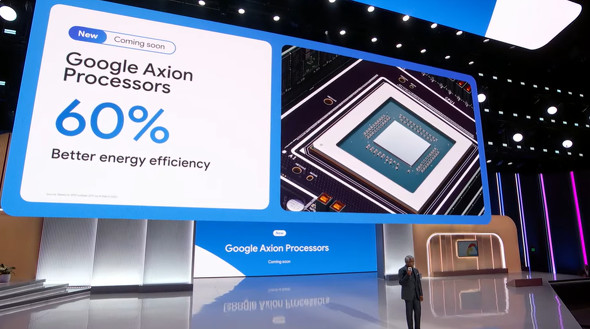

Google Cloudのトーマス・クリアンCEOは基調講演で、Axionは現在入手可能な最速の汎用Armベースインスタンスよりも約30%優れたパフォーマンスを提供すると語った。また、“現行世代のプロセッサ”と比較して、最大50%高速で60%効率が高いとも説明した。

Axionは生成AIのトレーニングと推論に最適という。社内では、BigQueryやGoogle Earthのエンジン、YouTube広告などで採用していく。

Google Cloud顧客への具体的な提供開始時期や価格などについてはまだ発表されていない。

データセンターで競合する米AmazonのAWSは2018年にArmベースのCPUを発表しており、米Microsoftは昨年ArmベースのカスタムCPUを発表している。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

Google、マルチモーダル生成AIモデル「Gemini」リリース

Google、マルチモーダル生成AIモデル「Gemini」リリース

Googleは、5月に予告したマルチモーダルな生成AIモデル「Gemini」の最初のバージョンを発表した。3つのサイズで提供する。最大の「Ultra」は来年の提供になるが、「Pro」は英語版の「Bard」で、「Nano」は「Pixel 8 Pro」で利用可能になっている。 AWS、AIモデルのトレーニングと実行向け新チップ「Graviton4」と「Trainium2」を発表

AWS、AIモデルのトレーニングと実行向け新チップ「Graviton4」と「Trainium2」を発表

Amazon傘下のAWSは、MLトレーニングや生成AIアプリを含む広範な顧客のワークロード向けの次世代チップ、「Graviton4」と「Trainium2」を発表した。いずれも先代より大幅に性能が向上したとしている。 大手クラウドはクラウド専用チップで戦う時代へ 各社がクラウド基盤に専用SoC、サーバにArm、AI処理に独自プロセッサを相次いで採用

大手クラウドはクラウド専用チップで戦う時代へ 各社がクラウド基盤に専用SoC、サーバにArm、AI処理に独自プロセッサを相次いで採用

AWS、Microsoft Azure、Google Cloudの3大クラウド事業者は本格的にクラウド専用チップで戦う時代に。各社におけるチップレベルの取り組みをまとめる。 Microsoft、AI最適化チップ「Azure Maia 100」と汎用Armチップ「Azure Cobalt」

Microsoft、AI最適化チップ「Azure Maia 100」と汎用Armチップ「Azure Cobalt」

Microsoftは2つのカスタム設計チップ、AIに最適化した「Maia 100」とArumベースの汎用「Cobalt 100」を発表した。「インフラストラクチャスタックのすべての層を最適化して統合することが重要」とガスリー氏。