速報

Microsoft、マルチモーダルなSLM「Phi-3-vision」をプレビュー

MicrosoftはSLM「Phi-3」シリーズにマルチモーダルな「Phi-3-vision」を追加した。画像やグラフを“見て”解析する。プレビューを利用可能だ。

米Microsoftは5月21日(現地時間)、開発者向け年次開発者会議「Microsoft Build 2024」の基調講演で、SLM(小規模言語モデル)「Phi-3」ファミリーの新メンバー「Phi-3-vision」(以下「vision」)を発表した。画像を解析するマルチモーダルなSLMだ。プレビュー版を利用可能。

SLMは単純なタスクで適切に実行できるように設計されており、リソースが限られる組織や端末上でローカルに実行する必要があるアプリに適した言語モデルだ。

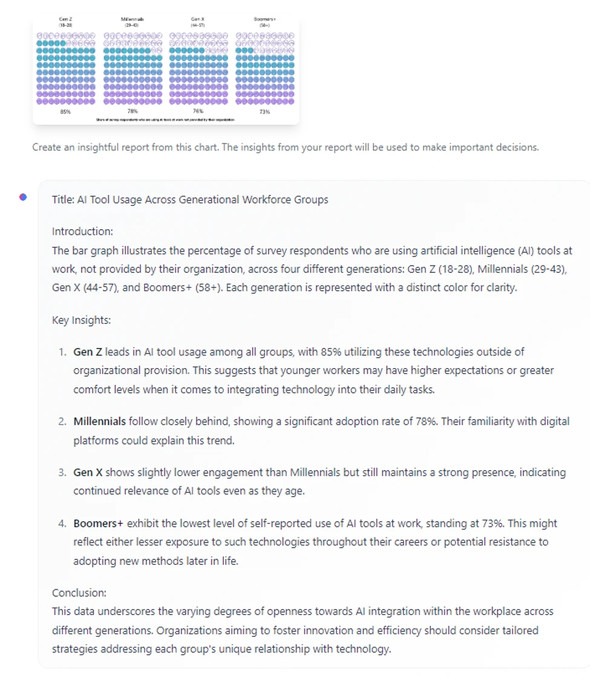

visionは、描画はできないが、モバイル端末で利用可能なコンパクトさだ。42億パラメータモデルで、グラフや画像に関して質問すると、それについて説明してくれる。

Microsoftは「visionは画像とテキストを一緒に検討する必要があるタスクに最適だ」としている。多様なハードウェアで実行できるように最適化されており、開発者はモバイル端末やWebを含むアプリやサービスでPhi-3を展開できる。

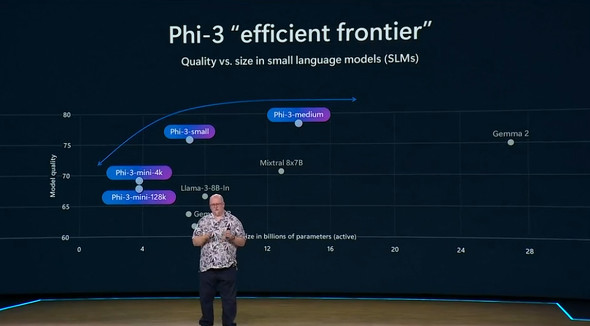

visionは4月発表のPhi-3-mini(38億パラメータ)の言語機能をベースに構築されている。4月には、miniの他、small(70億パラメータ)、medium(140億パラメータ)が発表され、3サイズ展開だった。

smallとmediumも同日からMicrosoft Azureで利用可能になった。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

Microsoft、商用利用可のSLM「Phi-3」リリース スマホで動くモデルも

Microsoft、商用利用可のSLM「Phi-3」リリース スマホで動くモデルも

Microsoftは小規模言語モデル(SLM)の「Phi-3」を発表した。3モデルあり、38億パラメータでトレーニングした最小モデルの「mini」をAzureやHugging Faceで公開した。 Microsoft、Igniteで発表の小規模言語モデル「Phi-2」をAzureでリリース

Microsoft、Igniteで発表の小規模言語モデル「Phi-2」をAzureでリリース

Microsoftは、SLM(小規模言語モデル)の「Phi-2」をAzureでリリースした。27億パラメータだが、複数のベンチマークでMetaの「Llama 2」の700億パラメータモデルやGoogleの32億パラメータの「Gemini Nano 2」を上回った。 Microsoft、YouTubeなどの動画のAI採用リアルタイム吹き替え機能をEdgeで提供へ

Microsoft、YouTubeなどの動画のAI採用リアルタイム吹き替え機能をEdgeで提供へ

Microsoftは「Build 2024」で、「Edge」のリアルタイム翻訳機能を発表した。AIを採用し、YouTubeやロイターの動画を音声吹き替えと字幕で翻訳する。間もなく利用可能になり、将来的には日本語もサポートする見込み。 有料版「ChatGPT」に「DALL・E 3」の画像編集ツール追加

有料版「ChatGPT」に「DALL・E 3」の画像編集ツール追加

OpenAIは有料版ChatGPT内で画像生成AI「DALL・E」の画像を編集できるようにした。編集ツールで変更したい部分を選択して編集できる。全体のスタイルの変更なども可能だ。