速報

Instagram、10代の“自傷検索”を保護者に自動通知へ

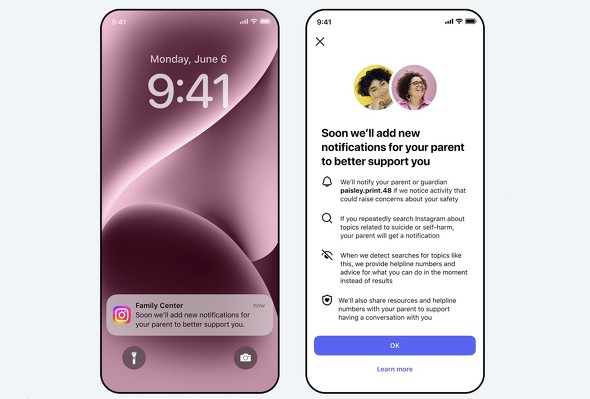

Metaは未成年保護の一環として、Instagramに10代のユーザーが自殺や自傷行為に関連する用語を短期間に繰り返して検索した場合、保護者に通知する新機能を導入する。米国などで先行展開し、年内に他の地域へ拡大していく予定だ。

米Metaは2月26日(現地時間)、Instagramに新たな未成年保護機能を追加すると発表した。10代のユーザーが自殺や自傷行為に関連する用語を短期間に繰り返し検索した場合に、保護者へ通知を送る仕組みだ。

保護者がInstagramのペアレンタルコントロール機能を有効にしていると、通知がメール、テキスト、WhatsApp、アプリ内通知など複数のチャネルで届く。通知には、専門家による支援リソースやセンシティブな会話への対応方法も含まれており、保護者が適切な対話や支援を行えるよう設計されているとしている。

Instagramには既に、自殺や自傷行為に関連する検索をブロックし、利用者を支援リンクへ誘導する仕組みがある。新機能は、検索行動から早期に懸念を察知し、保護者に知らせることを目的としている。Metaは過度の通知が有用性を損なわないよう、専門家の助言を踏まえ「短期間に複数回の検索」という基準でアラートを出す方針を示している。

提供開始は米国、英国、オーストラリア、カナダの保護者向けに3月初週から開始し、2026年後半にはその他の地域でも展開する予定。また、10代ユーザーがMeta AIなどの生成AIに支援を求めるケースが増えている状況を踏まえ、今年後半にAIチャットに関連する会話が問題の兆候を示した場合にも保護者に通知する仕組みを構築中という。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

Meta、10代へのAIキャラとの会話機能を停止へ 同社の全アプリで

Meta、10代へのAIキャラとの会話機能を停止へ 同社の全アプリで

米Metaが、AIで生成したキャラクターとの会話機能を10代のユーザーに対し提供を停止する。昨年、同社のAIチャットbotが未成年に恋愛感情をほのめかす回答をして批判を浴びた問題を受けた措置だ。 Meta、豪年齢制限法で54万アカウント削除 アプリストアの責任を指摘

Meta、豪年齢制限法で54万アカウント削除 アプリストアの責任を指摘

Metaは、オーストラリアのSNS年齢制限法に基づき54万5000件のアカウントを削除したと報告した。InstagramやFacebookでの16歳未満の利用を遮断する一方、Metaは「個別アプリでの年齢確認には限界がある」と指摘。アプリストア側で年齢確認を義務化し、業界全体で規制のすり抜けを防ぐ仕組み作りを訴えた。 FacebookとMessengerで10代保護「ティーンアカウント」日本でも

FacebookとMessengerで10代保護「ティーンアカウント」日本でも

Metaは「ティーンアカウント」をFacebookとMessengerにも拡大し、日本でも順次、適用を始めた。 欧州委員会、MetaをDSA違反の可能性で調査開始 インスタの中毒性に懸念

欧州委員会、MetaをDSA違反の可能性で調査開始 インスタの中毒性に懸念

EUの欧州委員会は、MetaをDSA(デジタルサービス法)違反の可能性で調査を開始した。FacebookやInstagramの未成年ユーザーを守る措置が不十分な可能性があるとしている。