NVIDIA、「NemoClaw」発表 OpenClawを1コマンドで導入、安全に実行可能に:GTC 2026

米NVIDIAが、年次カンファレンス「GTC 2026」でAIエージェントプラットフォーム「OpenClaw」向けソフトウェアスタック「NemoClaw」を発表した。1コマンドでNemotronモデルとOpenShellランタイムをインストールし、プライバシーとセキュリティを担保したままAIエージェントを常時稼働できる環境を構築できるという。

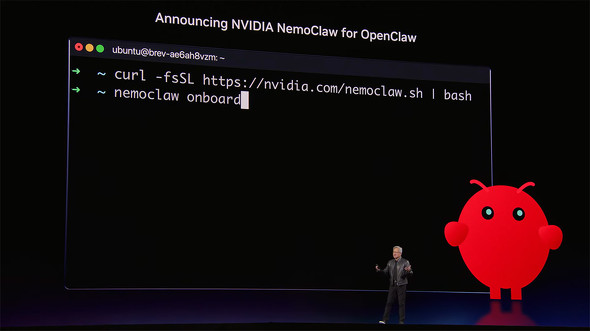

米NVIDIAは3月16日(現地時間)、年次カンファレンス「GTC 2026」で、AIエージェント向けオープンソースプラットフォーム「OpenClaw」に対応するソフトウェアスタック「NVIDIA NemoClaw」を発表した。1コマンドで導入でき、プライバシーとセキュリティの制御機能を自律AIエージェントに追加する。

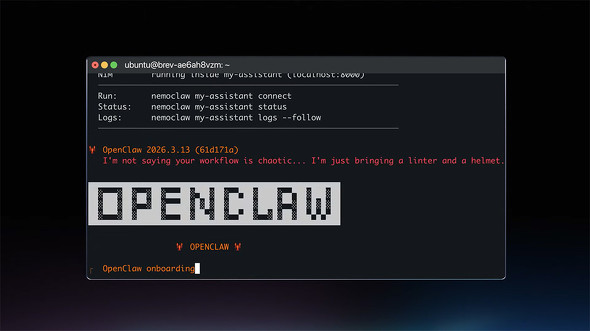

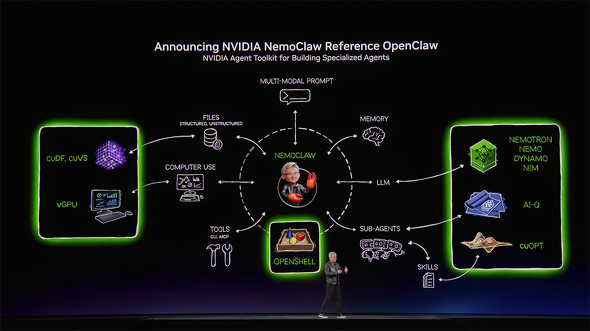

NemoClawは、「NVIDIA Agent Toolkit」を使用し、同社のオープンなAIモデル群「NVIDIA Nemotron」と、実行環境「NVIDIA OpenShell」を1つのコマンドでインストールする。OpenShellはオープンモデルと隔離されたサンドボックス環境を提供し、自律エージェントが作業するうえで必要なアクセス権限を与えつつ、セキュリティ、ネットワーク、プライバシーのガードレールを与えるとしている。

さまざまなコーディングエージェントを利用可能で、ローカルではNemotronなどのオープンモデルをシステム上で直接呼び出せるほか、クラウドのフロンティアモデルはプライバシールーターを経由してアクセス可能。ローカルとクラウドを組み合わせることで、エージェントは定義されたプライバシー・セキュリティポリシーの範囲内で新しいスキルを習得し、タスクを実行する基盤を構築できるという。

NemoClawの導入は、GeForce RTXを搭載したPC・ノートPC、RTX PROを搭載したワークステーション、「DGX Station」や「NVIDIA DGX Spark」といったAIスーパーコンピュータなどが対象となる。

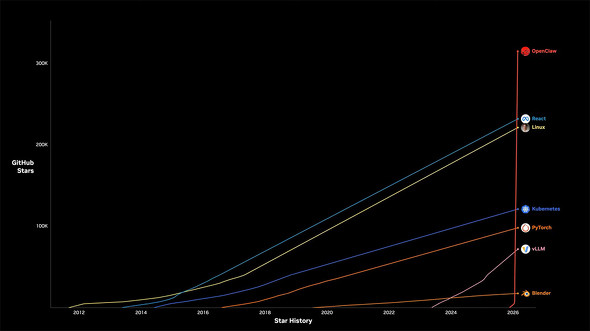

OpenClawはピーター・スタインバーガー氏が作成したAIエージェントのオープンソースプラットフォーム。NVIDIAのジェンスン・ファンCEOは「史上最速で成長したオープンソースプロジェクト」「MacとWindowsが個人用コンピュータのOSなら、OpenClawはパーソナルAIのOS」と紹介した。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

NVIDIA、ムラティ氏率いるThinking Machines Labに大規模出資 Vera Rubin導入でAI開発加速

NVIDIA、ムラティ氏率いるThinking Machines Labに大規模出資 Vera Rubin導入でAI開発加速

ミラ・ムラティ氏率いるThinking Machines Labは、NVIDIAと複数年にわたる戦略的提携を締結した。1GW規模の次世代AIシステム「Vera Rubin」を導入し、最先端モデルの学習とカスタマイズ可能なAIプラットフォーム構築を推進する。NVIDIAは同社へ大規模出資も実施する。 NVIDIAのフアンCEO、「推論の王者はBlackwell」 次世代Rubinへの自信も

NVIDIAのフアンCEO、「推論の王者はBlackwell」 次世代Rubinへの自信も

NVIDIAの2025年11月〜2026年1月期決算は、売上高が前年比73%増の約681億ドルと過去最高を更新した。純利益も94%増と急成長。データセンター部門が牽引し、次世代「Blackwell」への強い需要が継続している。フアンCEOは、自律型AIの普及に伴い、計算力が直接収益を生む「AIファクトリー」への投資は今後も加速すると強調した。 現実世界で動き始めたAI――自動運転にロボット、「フィジカルAI」に突き進むNVIDIAのビジョン

現実世界で動き始めたAI――自動運転にロボット、「フィジカルAI」に突き進むNVIDIAのビジョン

米ラスベガスで開催中の「CES 2026」。米NVIDIAが1月5日(現地時間)に行った基調講演では、ジェンスン・フアンCEOが登壇。次世代AIスパコン「Vera Rubin」と、推論で思考を語ることができる自動運転AI「Alpamayo」を発表。AIが現実世界に浸透する未来像を示した。 NVIDIA、次世代AIプラットフォーム「Rubin」量産開始 推論コストを10分の1へ

NVIDIA、次世代AIプラットフォーム「Rubin」量産開始 推論コストを10分の1へ

NVIDIAは、次世代AIプラットフォーム「Rubin」の量産開始を発表した。GPUやCPUなど6つの新チップを“extreme codesign”で一体化。先代Blackwell比で推論コストを10分の1に低減する。2026年後半に提供開始予定で、OpenAIやxAIなど主要各社がこぞって採用を表明した。 NVIDIA、エージェント型AI開発向けオープンモデル「Nemotron 3」発表

NVIDIA、エージェント型AI開発向けオープンモデル「Nemotron 3」発表

NVIDIAは、エージェント型AI構築に最適化されたオープンな基盤モデルファミリー「Nemotron 3」を発表した。ハイブリッドなMoEアーキテクチャを採用し、最大100万トークンのロングコンテキストに対応する。開発者は自由に派生モデルを作成できる。