NVIDIA、推論特化チップ「Groq 3 LPU」発表 「Vera Rubin」と組み合わせてAI性能最大35倍に:GTC 2026

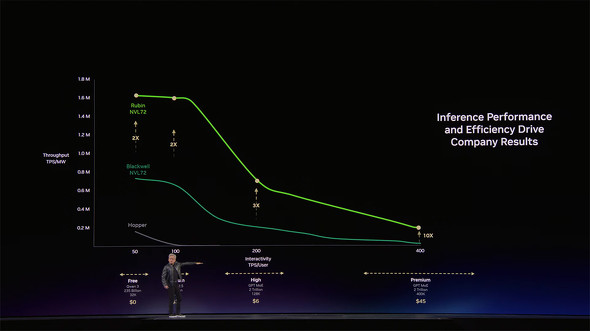

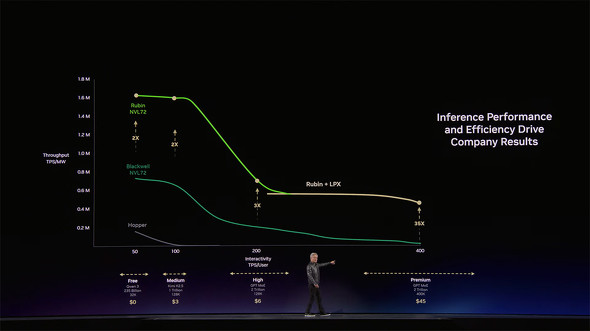

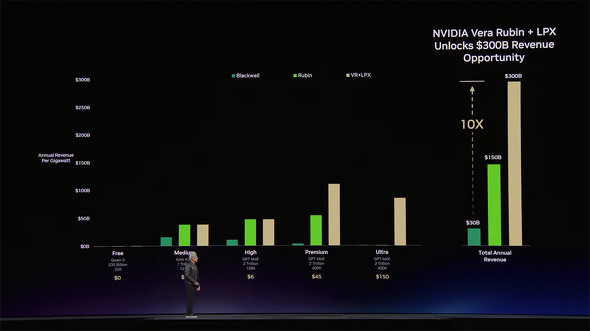

米NVIDIAが、エージェンティックAI向け次世代プラットフォーム「Vera Rubin」の全容を公開した。7種の新チップがフル生産体制に入り、今年後半にパートナー各社から提供予定という。新たに推論特化の「Groq 3 LPU」を発表。Vera Rubinと組み合わせることで、Blackwellと比較してスループットが最大35倍向上するとしている。

米NVIDIAは3月16日(現地時間)、年次イベント「GTC 2026」で、次世代のAIインフラプラットフォーム「NVIDIA Vera Rubin」の本格的な量産体制に入ったと発表した。新たにAI推論に特化したチップをファミリーに統合、搭載製品はパートナー各社から2026年後半での提供を予定する。

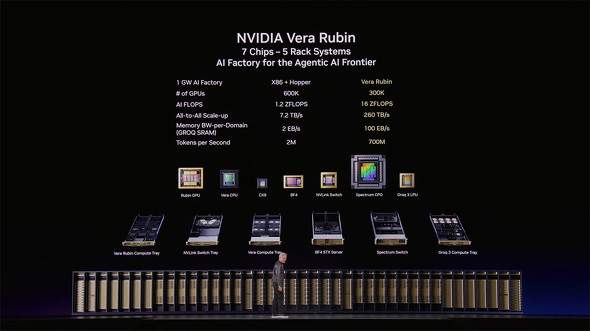

Vera Rubinは、GPU「Rubin」、CPU「Vera」、「NVLink 6」スイッチ、SuperNIC「ConnectX-9」、DPU「BlueField-4」、Ethernetスイッチ「Spectrum-6」に、今回新たに統合されたLPU(Language Processing Unit、言語処理ユニット)の「Groq 3 LPU」を加えた7チップで構成される。これらを搭載する5種のラックが1台のAIスーパーコンピュータとして機能する設計だ。

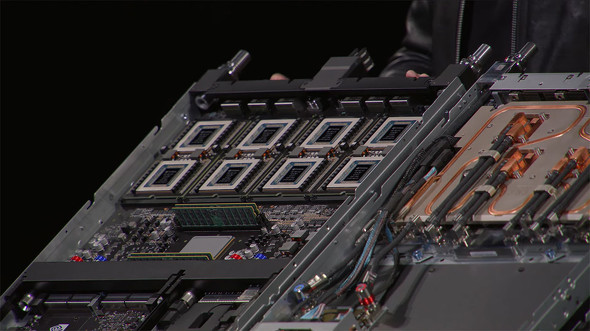

メインの「Vera Rubin NVL72」ラックは、72基のRubin GPUと36基のVera CPUをNVLink 6で接続し、ConnectX-9 SuperNIC、およびBlueField-4 DPUを統合。MoEアーキテクチャモデルのトレーニングは先代「Blackwell」の4分の1のGPU数で対応でき、推論スループットはワットあたり最大10倍、トークンあたりのコストは10分の1になるとしている。

エージェンティックAIの強化学習環境を担う「Vera CPUラック」は256基のVeraを搭載する。VeraはNVIDIAが自社設計したCPUで、Armベースの「Olympusコア」を88基搭載。従来のものと比べて処理効率は2倍、50%高速化しているほか、1コアで2つのタスクを実行できる。メモリはLPDDR5Xで、最大1.2TBの帯域幅を実現するという。

「Groq 3 LPU」の威力

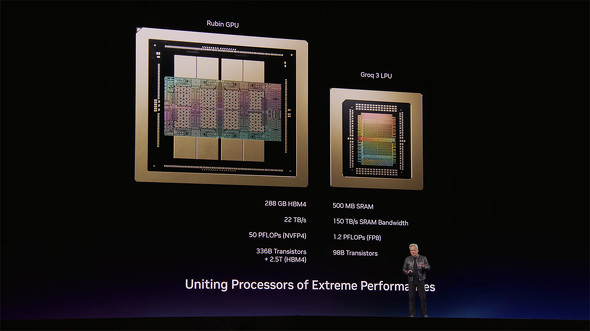

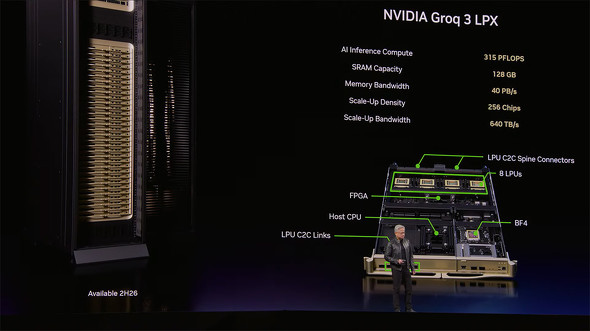

Groq 3 LPUは、NVIDIAが2025年12月に締結を発表した、AIアクセラレーターを手掛けるスタートアップ米Groqとの非独占ライセンスにより実現したもの。1チップあたりの演算性能は1.2PFLOPs(FP8)で、500MBのSRAMを内蔵。メモリ帯域は150TB/sを実現する。なお、GPUのRubinは、288GBという大容量のHBM4メモリを搭載し、メモリ帯域は22TB/s、50PFLOPsの演算性能を持つ。

今回新たに加わった「Groq 3 LPXラック」は、256基のGroq 3 LPUを接続することで128GBのオンチップSRAMと、40PB/sのメモリ帯域幅を実現。Vera Rubin NVL72と組み合わせることで、メガワットあたりの推論スループットは旧モデルのBlackwellと比べて最大35倍に上るとしており、兆パラメータ規模のモデルと最大100万トークンのコンテキスト処理に最適化されているという。

AWS、Google Cloud、Microsoft Azure、Oracle Cloud InfrastructureなどがVera Rubinベースの製品を今年後半に提供する計画。Anthropic、Meta、Mistral AI、OpenAIもVera Rubinの採用を検討しているとしている。Dell Technologies、HPE、Lenovo、Supermicroなど主要システムメーカーもサーバ製品の提供を予定する。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

NVIDIA、ムラティ氏率いるThinking Machines Labに大規模出資 Vera Rubin導入でAI開発加速

NVIDIA、ムラティ氏率いるThinking Machines Labに大規模出資 Vera Rubin導入でAI開発加速

ミラ・ムラティ氏率いるThinking Machines Labは、NVIDIAと複数年にわたる戦略的提携を締結した。1GW規模の次世代AIシステム「Vera Rubin」を導入し、最先端モデルの学習とカスタマイズ可能なAIプラットフォーム構築を推進する。NVIDIAは同社へ大規模出資も実施する。 NVIDIA、次世代AIプラットフォーム「Rubin」量産開始 推論コストを10分の1へ

NVIDIA、次世代AIプラットフォーム「Rubin」量産開始 推論コストを10分の1へ

NVIDIAは、次世代AIプラットフォーム「Rubin」の量産開始を発表した。GPUやCPUなど6つの新チップを“extreme codesign”で一体化。先代Blackwell比で推論コストを10分の1に低減する。2026年後半に提供開始予定で、OpenAIやxAIなど主要各社がこぞって採用を表明した。 NVIDIAのフアンCEO、「推論の王者はBlackwell」 次世代Rubinへの自信も

NVIDIAのフアンCEO、「推論の王者はBlackwell」 次世代Rubinへの自信も

NVIDIAの2025年11月〜2026年1月期決算は、売上高が前年比73%増の約681億ドルと過去最高を更新した。純利益も94%増と急成長。データセンター部門が牽引し、次世代「Blackwell」への強い需要が継続している。フアンCEOは、自律型AIの普及に伴い、計算力が直接収益を生む「AIファクトリー」への投資は今後も加速すると強調した。 NVIDIA、CoreWeaveに約3100億円出資 次世代「Rubin」基盤のAIデータセンターを5GW規模で構築へ

NVIDIA、CoreWeaveに約3100億円出資 次世代「Rubin」基盤のAIデータセンターを5GW規模で構築へ

NVIDIAは、AIクラウドのCoreWeaveに20億ドルを出資し、提携を強化した。2030年までに5GW規模のAIデータセンター構築を目指し、次世代の「Rubin」プラットフォーム等を優先導入する。 Googleの元TPU開発者がNVIDIA入り 創業したGroqの推論技術ライセンス契約締結で

Googleの元TPU開発者がNVIDIA入り 創業したGroqの推論技術ライセンス契約締結で

NVIDIAは、LLMの処理に特化した独自のプロセッサ「LPU」を手掛けるGroqと、AI推論技術の非独占的ライセンス契約を締結した。元GoogleのTPU開発者として知られるジョナサン・ロスCEOら主要メンバーはNVIDIA入りし、技術開発と普及を推進する。NVIDIAはGroqの推論技術を取り込み、AIインフラの競争力を強化する狙いだ。