「gpt-oss」はチャット機能以外にも活用方法がたくさん? 最新のWeb情報を利用するやり方も伝授:“超”初心者向けローカルAI「gpt-oss」導入ガイド(3)(3/5 ページ)

本連載ではローカルLLMの導入方法から活用方法に至るまで、「手元にハイエンドPCがあって、生成AIをローカル環境で動かしてみたい」という初心者の方にも分かりやすく連載で解説する。

LM StudioとWeb Search MCP Serverを接続する

ここまで完了したら、LM StudioとWeb Search MCP Serverを接続し、gpt-oss-20bでWeb検索できるように設定しよう。

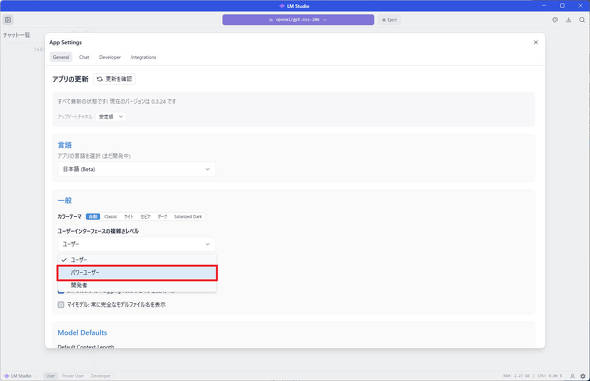

前回、LM Studioを導入した際は、初めての利用を想定して「ユーザーインタフェースの複雑さレベル」を「ユーザー」に指定していたが、MCP Serverを利用する場合、「パワーユーザー」への変更が必要なので、LM Studioの設定画面から変更しよう。

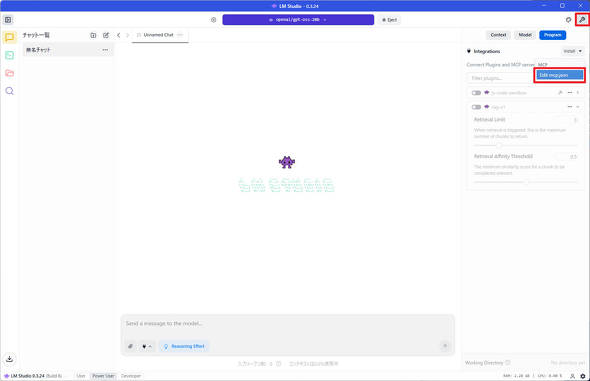

設定が完了したら、チャットインタフェースを開いた後、画面右上の「スパナアイコン」をクリックし、「Program」→「Install」→「Edit mcp.json」の順にクリックしよう。

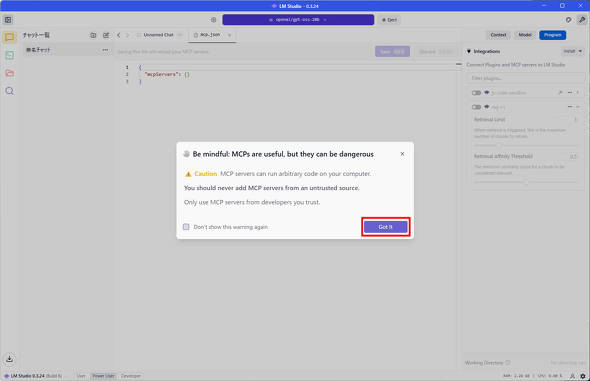

すると上図の通り、MCP Serverを利用する際の注意事項が表示される。MCP Serverは便利な反面、PC上での操作が自動化されることもあって、危険な物も中には存在しており、信頼できない物は利用しないように注意を促してくれる機能だ。

今回はEDRを導入している筆者の環境でも特に問題ないことを確認しているため、「Got it」をクリックする。

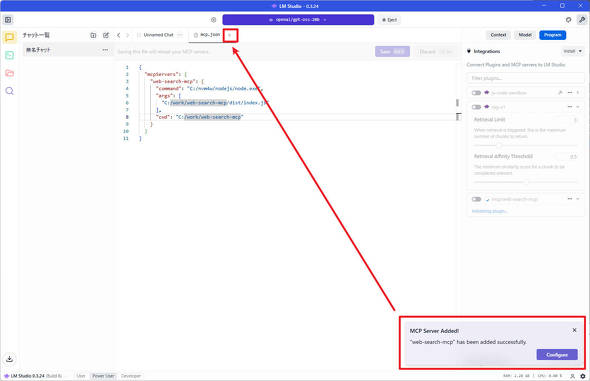

「mcp.json」という設定ファイル編集画面が表示されるので、下記の例の通り記載した上で「Save」をクリックしよう。

なお、Windowsはフォルダーパスの区切りとして「\」マークを利用しているが、mcp.json内では「\」を「/」に置き換えて設定して欲しい。

{

"mcpServers": {

"web-search-mcp": {

"command": "C:/nvm4w/nodejs/node.exe",

"args": [

"C:/work/web-search-mcp/dist/index.js"

],

"cwd": "C:/work/web-search-mcp"

}

}

}

無事追加が完了すると、画面右下に「MCP Server Added!」と表示されるので、画面左上のチャット一覧から、先ほど開いたチャットインタフェースをクリックしよう。

もしエラーが発生した場合は、それぞれのフォルダパスが合っていることや、フォルダパスの区切り文字が「/」に書き換えられているか、再度確認してほしい。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

手元にあるゲーミングPCを活用して生成AIを動かす! 無料で使える「LM Studio」のキホンを解説

手元にあるゲーミングPCを活用して生成AIを動かす! 無料で使える「LM Studio」のキホンを解説

本連載ではローカルLLMの導入方法から活用方法に至るまで、「手元にハイエンドPCがあって、生成AIをローカル環境で動かしてみたい」という初心者の方にも分かりやすく連載で解説する。 手元にゲーミングPCがあれば、オフライン環境でも生成AIが利用できるってホント? ローカルLLM(大規模言語モデル)導入を解説

手元にゲーミングPCがあれば、オフライン環境でも生成AIが利用できるってホント? ローカルLLM(大規模言語モデル)導入を解説

本連載ではローカルLLMの導入方法から活用方法に至るまで、「手元にハイエンドPCがあって、生成AIをローカル環境で動かしてみたい」という初心者の方にも分かりやすく連載で解説する。 米AMD、RyzenやRadeonで生成AIをローカル実行するハウツーガイドを公開

米AMD、RyzenやRadeonで生成AIをローカル実行するハウツーガイドを公開

GPTベースのLLM(大規模言語モデル)を使ったAIチャットbotの実行、LLMをローカルでカスタマイズできる検索拡張生成(RAG)の導入、プログラミングにおけるコーディングアシスタントの実行という3つの手順を紹介している。 NVIDIAがPC上のデータを使うAIチャットbotツール「Chat with RTX」公開/AMD製CPUに複数の脆弱性

NVIDIAがPC上のデータを使うAIチャットbotツール「Chat with RTX」公開/AMD製CPUに複数の脆弱性

うっかり見逃していたけれど、ちょっと気になる――そんなニュースを週末に“一気読み”する連載。今回は、2月11日週を中心に公開された主なニュースを一気にチェックしましょう!