AI規制の最先端「EU AI Act」の全体像

EUの最新AI規制、AIモデル・システム開発企業が取るべき対応は?

2024年5月、世界に先駆けて、欧州連合(EU)ではAIに対する包括的な規制「EU AI Act」(EU AI規制法)が成立した。AIシステムをEU域内に投入する各国・地域の企業にも適用され、世界に大きな影響を与えている。この法律が禁止するAIは25年2月から適用され、他の要件も今後数年かけて順次適用されていく。まさに今、企業はその備えをすべきタイミングだ。

本連載では、各企業がこの法律に対応するための基礎的な内容と抑えておくべきポイントなどを全3回にわたって解説する。連載第2回の本稿では、EU AI規制法の中でも、AIシステム/AIモデルを開発するプロバイダーの義務に焦点を当て、「ハイリスクAIシステム」「汎用目的AIモデル」に区分されるAIへの対応を考察する。

著者プロフィール:KPMGコンサルティング 執行役員 パートナー 熊谷堅(くまがい けん)

システム開発等に従事した後、外資系コンサルティング会社を経て2002年にKPMGビジネスアシュアランス(現KPMGコンサルティング)に入社。デジタル化やデータに関わるガバナンス、サイバーセキュリティ、IT統制に関わるサービスを数多く提供。現在は、KPMG各国事務所と連携し、KPMGジャパンにおけるTrusted AIサービスをリード。法規制対応を含むAIガバナンス構築プロジェクトを手掛ける。

“プロバイダー”は誰? 特定するにも時間がかかる可能性

EU AI規制法では、法的義務が課される事業者をいくつかに分類している(本連載第1回参照)。そのうち、多くの条文はAIシステムやAIモデルを開発する「プロバイダー」を対象とするものだ。AIを規制する上で、プロバイダーが重要な位置付けであることは言うまでもないだろう。

AIが含まれるか否かに限らず、一般的にシステム開発やサービス提供は数多くの関係者で構成される。EU AI規制法上のプロバイダーを特定することは一律的に判断できない場合もあり、注意が必要だ。

法律の条文にも、「バリューチェーンに沿った責任」(Responsibilities along the AI value chain)とあり、社名や商標の掲載、使用目的を変える仕様変更、システムへの実質的な変更などの場合、最終的な製品製造業者を含む他の役割(デプロイヤーなど)を担う事業者がプロバイダーとしての義務を負うケースが規定され、実務上多様なケースがあることを認めている。

また、生成AIのファウンデーション(基盤)モデルは、その利活用形態として複製や一部修正する場合などが考えられ、誰がプロバイダーかどうかが判断しにくい場合もある。法律の細部の確認はもちろんのこと、場合によっては関係者との協議を含め、時間を要する場合があるだろう。

ハイリスクAIに求められる品質管理

連載初回でも述べた通り、EU AI規制法は、リスクベース・アプローチとしてAIシステム/AIモデルをいくつかに分類しており、プロバイダーの義務もその分類に応じて条文が構成されている。まずは「ハイリスクAIシステム」に分類されるシステムを巡り、プロバイダーが課される義務について確認しよう。

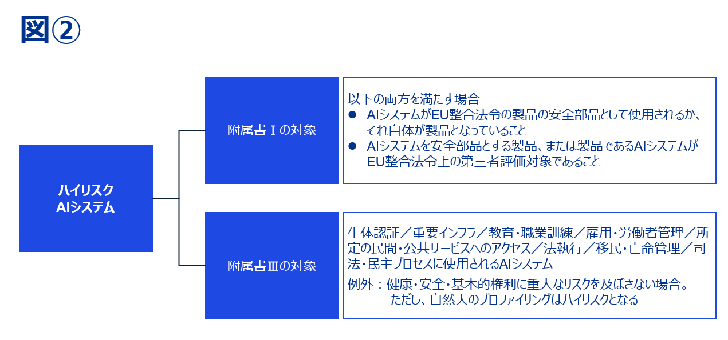

ハイリスクAIシステムは、大きく分けて2つある。1つ目は欧州の「機械指令」「無線機器指令」「医療機器規則」など、EUによる既存の法令の対象。つまり製品の市場流通に「CEマーク」を必要とする、AIシステムが安全部品の構成要素となっているものだ。具体的な条件はEU AI規制法の「附属書I」に対象リストの記載がある。図2にも条件をまとめた。

2つ目は、生体認証、重要インフラ、教育・職業訓練、雇用・労務管理などに利用されるAIシステムで、基本的な権利への影響が大きいとされるものだ。

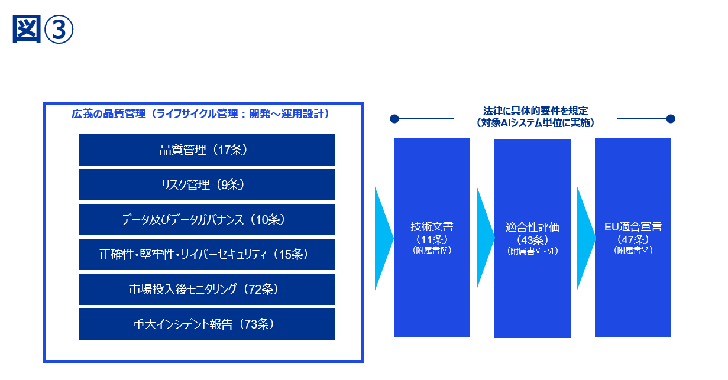

ハイリスクAIシステムを提供するプロバイダーに対しては、健康、安全、基本的な権利に対する負の影響を懸念し、さまざまな義務が課される。特に重要なのは品質管理への要求だ。

EU AI規制法では、品質管理に関する要求は、AIシステムの設計、開発、テスト、開発前・途上・開発後の審査、変更手続き、データ管理など、開発ライフサイクルの手順や体系化された活動の整備が求められる。また品質管理の条文中には、リスク管理、データガバナンス、正確性・堅牢性・サイバーセキュリティ、稼働後モニタリングなども規定され、包括的にプロバイダーの義務としている。

ハイリスクAIシステムを扱うプロバイダーへの要求にはAIガバナンスのエッセンスが凝縮されており、特にライフサイクル管理の考え方は、リスク管理やサイバーセキュリティにも直接言及され、準拠対応を進める上では不可欠になるだろう。

AIガバナンスの基本は、AIライフサイクル各工程を定義し、バリューチェーン上の各プレイヤーの役割を明確化することにある。EU AI規制法対応はもちろんのこと、経済産業省と総務省が公表している「AI事業者ガイドライン(第1.0版)」や、米国立標準技術研究所(NIST)による「AIリスクマネジメントフレームワーク」(AI RMF)に準拠した態勢構築などを進める場合にも共通する。

欧州規制特有の適合性評価についても触れる。プロバイダーは、ハイリスクAIシステムが法律の要件を満たすことを評価するために必要な情報を、技術文書として作成しなければならない。その評価についても方法や評価主体が規定されている。

CEマーキングの法規制に関係するハイリスクAIシステム(附属書Iのリスト)は、認定された第三者による適合性評価を受ける。一方、「附属書III」規定の条件に合致するハイリスクAIシステムは、自己評価と第三者評価の条件が規定されている。

さらに、EU適合宣言書の作成と署名、製品・サービスのパッケージや付属書類への名称や商標記載、CEマーク貼付、EUのデータベースへの登録などの義務を負うため、EUへの市場投入にあたっての事務手続き負担も大きい。

「汎用目的AIモデル」を巡る義務

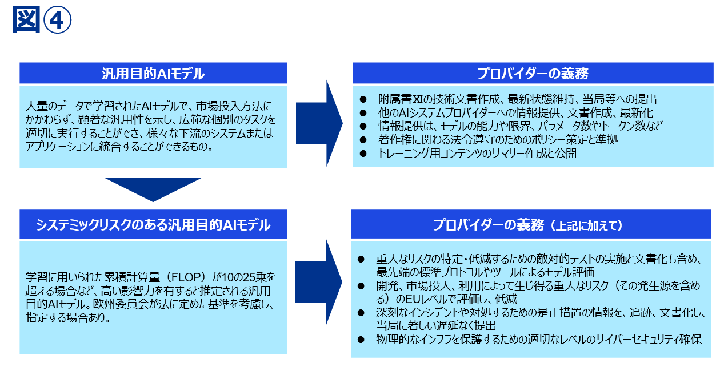

「汎用目的AIモデル」を巡るプロバイダーの義務も説明する。EU AI規制法において、汎用目的AIモデルとは、大量データを使用した訓練、高い汎用性を示すこと、広範な個別のタスクの実行などを条件に、さまざまなシステムまたはアプリケーションに統合できるAIモデルを意味するものと定義されている。

法律の前文では、少なくとも10億個のパラメータを持ち、大量のデータでトレーニングされたモデルが重要な一般性を示す広範なタスクを適切に実行できると考えるべきとされており、大規模言語モデル(LLM)が典型例とされる。

汎用目的AIモデルのプロバイダーには、ハイリスクAIシステム同様に技術文書の作成が義務付けられる。技術文書には、トレーニング及びテストのプロセスと評価結果を含むこととし、統合可能なAIシステムの性質、リリース日や配布方法、アーキテクチャやパラメータ数といった基礎情報のほか、使用説明書、データや訓練に関わる情報、計算資源や推定エネルギー消費量などの詳細情報を記載しなければならない。

汎用目的AIモデルは、マーケットプレースにおける入手(ダウンロード、コピー)、公開されるAPIによる接続など、提供形態も多様である。他のプロバイダーによって、当該モデルをそのまま活用、あるいは一部修正してAIシステムが構築されることも想定される。

そのため、プロバイダーに対してはAIモデルの性能・制約などの情報提供とその最新化、学習に用いたコンテンツの概要情報、「EU著作権指令」に基づくポリシー準拠なども求められる。

さらに、学習に用いられた累積計算量が10の25乗を超える場合など、所定の基準を超えるモデルは、EU市場に重大な影響を与え、バリューチェーン全体に波及し得るシステミックリスク(分散不能なリスク)があると見なされる。プロバイダーには欧州委員会に通知する義務が課せられ、そのリストも公開されることになる。

当然、通常の汎用目的AIモデル以上の高い要求があり、システミックリスクの特定と軽減を目的とした「敵対的テスト」(AIモデルに誤った予測や判断を引き出させる攻撃「敵対的サンプル」に対する堅牢性を高める措置やテスト)の実施と文書化、システミックリスクの評価、重大インシデントの当局報告などの対応が義務付けられている。具体的な内容は、25年5月までに実践規範(Code of Practice)が公表される予定だ。本稿執筆時点では、ドラフト第2版が公表されている。

次回は、「透明性義務のあるAIへの規制」「デプロイヤーに対するハイリスクAIへの規制」に求められる対応について、それぞれ説明していく。

Copyright © ITmedia, Inc. All Rights Reserved.

AI規制の最先端「EU AI Act」の全体像

世界に先駆けて、欧州連合(EU)ではAIに対する包括的な規制“EU AI Act”(EU AI規制法)が、2024年5月に成立した。本連載では、各企業がこの法律に対応するための基礎的な内容と抑えておくべきポイントなどを全3回にわたって解説する。

この記事の著者

関連記事

こんなメディアも見られています

ITmedia AI+に関連する情報をお探しであれば、こちらのメディアもお役に立てるかもしれません。

SpecialPR

よく見られているカテゴリー

アクセスランキング

-

1

Google、“動画版Nano Banana”こと「Gemini Omni」公開 会話で映像を生成・編集

-

2

Appleが5年がかりで開発したセキュリティ対策を5日で突破 「Mythos」が見せつけた脆弱性攻撃の威力

-

3

GPT-5.5は最高性能ではないのに、なぜエンジニアが熱狂? カギは“最後まで自走する力”

-

4

日立、Anthropicと提携 グループ29万人に「Claude」などAI導入 社会インフラ分野にも展開へ

-

5

生成AIで3Dモデルを自動作成 専門スキル不要でテキストや画像から3D化

-

6

【やさしいデータ分析】ベイズ統計入門 ~ 古典的な統計との違いと使い分け

-

7

GoogleのAIサブスク、最上位プランを値下げ 月額1万4500円の新プランも

-

8

「最新のAI創薬ラボ」なのに会議室みたい!? 製薬大手がラブコール送る“異色のAI企業”による新拠点とは

-

9

みずほFGが実現 2週間かかるAIエージェント開発を最短数日にする仕組みとは?

-

10

伊藤忠商事や三菱ケミカルなど16社が参画 大手企業の「暗黙知」を活用する新プロジェクト

SpecialPR

ITmedia AI+ SNS

インフォメーション

注目情報をチェック

ITmedia AI+をフォロー

あなたにおすすめの記事PR

@itm_aiplusをフォロー

@itm_aiplusをフォロー