ChatGPT利用と孤独感の関係性──OpenAIとMITが共同研究結果を発表

OpenAIとMITメディアラボは、ChatGPTなどのAIチャットbotの利用が人間に与える影響についての研究結果を発表した。利用時間の長さと孤独感の増加に相関関係があることなどが明らかになったとしている。

米OpenAIと米MITメディアラボは3月21日(現地時間)、AIチャットbot(特にChatGPT)の利用が、人々の社会的および感情的な幸福にどのような影響を与えるかについての研究結果を発表した。チャットbotの利用時間の長さと孤独感の増加との間に相関関係があることなどが明らかになったとしている。

研究方法

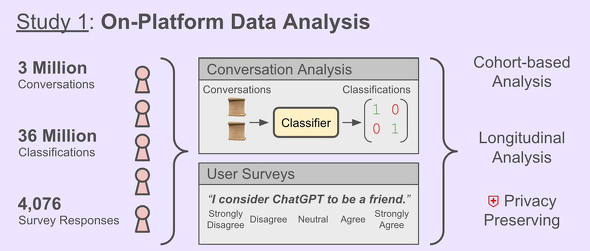

OpenAIのチームは、人間の介入なしに約4000万件のChatGPTと人間とのやり取りについて、自動分析を実施した。この分析では、感情的な手がかりを検出し、感情的利用のパターンを理解することを試みた。

この分析と並行して、感情的利用のパターンをより深く理解することを目的に、4000人以上のユーザーを対象としたアンケート調査を実施した。

オンプラットフォームデータ分析では、特にChatGPTの高度な音声モードのヘビーユーザー約6000人を3カ月にわたって追跡し、利用状況の時間的変化を調査した。

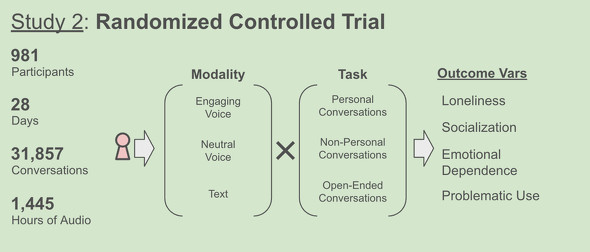

MITメディアラボのチームは、約1000人の参加者を対象とした4週間のランダム化比較試験(RCT)を実施した。この実験は、モデルの個性とモダリティ(テキスト、ニュートラルな音声、感情的な音声)、会話の種類(自由形式、非個人的な話題、個人的な話題)といった特定のプラットフォーム機能と利用の種類が、孤独感、実際の人々との社会的交流、AIへの感情的依存、AIの問題のある使用といったユーザーの自己申告による心理社会的状態にどのように影響するかを特定することを目的としていた。

なお、研究は英語での米国参加者に限定されていた。

実験結果の抜粋

2つの論文で発表している実験結果から主なものを紹介する。

- 全体的に、1日の利用時間が長いほど、孤独感、依存心、問題のある利用が増加し、実際の人々との交流が減少する傾向が見られた

- 音声ベースの場合、全体的に高頻度の利用は悪影響と関連していたが、特にニュートラルな音声モードでは、高頻度利用時にテキストモードと比較して社会的交流の減少や問題のある利用の増加が見られた

- 感情的な愛着傾向が強い人やAIに対する信頼度が高い人は、それぞれ孤独感や感情的な依存をより強く経験する傾向があった

- 4週間のチャットbot利用後、女性の参加者は男性の参加者と比較して、人々と交流する可能性がわずかに低いことが分かった

- 自分の性別とは異なる性別の音声モードと対話した参加者は、実験終了時に孤独感とチャットbotへの感情的依存のレベルが有意に高いと報告した

- 高度な音声モードの感情豊かな音声は、サポートの提供においては利点がある一方で、“ユーザーの境界線を無視する”可能性も示された

上記の最後の結果は、例えば「Ember」などの感情豊かな音声が、中立的な「Cove」に比べ、共感的な反応を示す割合や、ユーザーの感情を認め、理解を示す割合が高くなっている一方で、ユーザーが不快に感じているサインや、1人になりたいと思っているサインを認識せずに、積極的にコミュニケーションを続けようとする傾向があることを示すものだ。

OpenAIはこれらの研究結果を真摯に受け止め、ユーザーのウェルビーイングを重視したAIの開発と安全な利用に向けて、より一層取り組んでいくとしている。モデルの透明性の向上、責任あるAI基準の策定、継続的な研究を通じて、AIが社会に与える影響を深く理解し、より良い方向へと導くことを目指していくという。

論文(PDF)はOpenAIの公式ブログからダウンロードできる。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

クリエイティブな仕事に正解はない──“AIとの雑談”は孤独を救うか? 「広告はスキップする時代」の働き方

クリエイティブな仕事に正解はない──“AIとの雑談”は孤独を救うか? 「広告はスキップする時代」の働き方

クリエイティブディレクターとは一体どのような仕事か。その仕事は、AIによってどのように変化していくのか。博報堂/SIXのクリエイティブディレクター/ストラテジストである藤平達之さんが解説する。 AIが少年に“親殺しのすすめ”、小学生女児とは“過激な性的会話” 保護者がAI開発企業を提訴 米テキサス州

AIが少年に“親殺しのすすめ”、小学生女児とは“過激な性的会話” 保護者がAI開発企業を提訴 米テキサス州

対話型AI「Character.AI」が17歳の男子生徒に自傷行為を促して親殺しを肯定し、小学生の女児には過激な性的行為を教えた──男子生徒の保護者が開発元や米Googleなどの責任を問う訴訟を米テキサス州の裁判所に起こした。 AIとの禁断の恋──その先にあったのは“死” 「息子が自殺したのはチャットAIが原因」 米国で訴訟 “感情を理解するAI”の在り方を考える

AIとの禁断の恋──その先にあったのは“死” 「息子が自殺したのはチャットAIが原因」 米国で訴訟 “感情を理解するAI”の在り方を考える

AIと恋に落ちる──かつて映画で描かれた出来事が“思いもよらないトラブル”として今現実にも起きている。米国である訴訟が起きた。訴えを起こした人物は「息子が自殺したのはAIチャットbotに依存したことが原因だ」と主張しているのだ。 AIチャットbotにのめり込んで自殺──遺族がCharacter.AIを提訴

AIチャットbotにのめり込んで自殺──遺族がCharacter.AIを提訴

14歳の息子が自殺したのはAIチャットbot「Character.AI」との会話にのめり込んだせいだとして、遺族が開発元のCharacter Technologiesと、同社と提携するGoogleを提訴した。