一見普通のチャット会話に“秘密のメッセージ”を隠すAI技術 厳しい監視下でもSNSで秘密裏に会話:Innovative Tech(AI+)

ノルウェー科学技術大学などに所属する研究者らは、大規模言語モデル(LLM)を使って、普通のチャット会話の中に秘密のメッセージを隠す方法を提案した研究報告を発表した。

Innovative Tech(AI+):

このコーナーでは、2014年から先端テクノロジーの研究を論文単位で記事にしているWebメディア「Seamless」(シームレス)を主宰する山下裕毅氏が執筆。新規性の高いAI分野の科学論文を山下氏がピックアップし、解説する。

X: @shiropen2

ノルウェー科学技術大学などに所属する研究者らが発表した論文「An LLM Framework For Cryptography Over Chat Channels」は、大規模言語モデル(LLM)を使って、普通のチャット会話の中に秘密のメッセージを隠す方法を提案した研究報告だ。

研究チームが開発した「EmbedderLLM」フレームワークは、公開チャットチャネルにおいて人間のように見えるテキストを通じて暗号化通信を実現する技術。これによって政府による監視が厳しい環境下でも安全な通信手段を提供できる。

このフレームワークの核心は、LLMが生成したテキスト内の特定位置に暗号化されたメッセージを組み込むアルゴリズムにある。これにより、暗号化されたメッセージを一見普通のチャット会話に紛れ込ませ、SNSなどを通じて秘密裏に情報をやりとりできる。

EmbedderLLMの動作原理は次の通り。まず暗号文を英語で最も頻出するアルファベット(スペース、E、T、A、O、N、I、Sなど)に変換。次に、これらの文字を配置する特定位置を決定する。通常、各埋め込み文字は互いに約32文字以上離れるよう設計されている。EmbedderLLMはLLMに対して、指定の位置に特定の文字が現れるようなトークンを選択させる仕組みになっている。

このフレームワークには3つの特性がある。1つ目は、ユーザーはそれぞれ異なるローカルLLMモデルを使用できること。2つ目は、量子コンピュータ時代の前後を問わず使用できるよう設計されている点。最も重要なのは、暗号文が埋め込まれたテキストが人間が生成したかのように自然に見え、通常のチャットと区別できない点だ。

研究では、EmbedderLLMの応用例が2つ示している。1つ目は対称鍵暗号化であり、共有パスワードを用いた認証付き暗号化を実現するもの。2つ目は公開鍵暗号化であり、楕円曲線ディフィー・ヘルマン鍵共有(ECDHE)の実装方法を詳細に解説している。

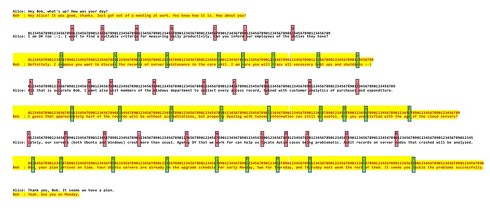

実際の使用例を挙げると、アリスとボブが安全に通信したい場合、まず共有パスワードから鍵を生成。アリスは秘密のメッセージを暗号化し、その暗号文を英語の頻出文字にマッピングする。次に、これらの文字を特定位置に埋め込んだ自然な文章を生成し、公開チャネルを通じてボブに送信する。ボブは同じ共有パスワードを用いて文字の位置を特定し、メッセージを抽出・復号する。

Source and Image Credits: Gligoroski, Danilo, Mayank Raikwar, and Sonu Kumar Jha. “An LLM Framework For Cryptography Over Chat Channels.” arXiv preprint arXiv:2504.08871(2025).

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

AIがレイプ被害者になりすましていた──米匿名掲示板「Reddit」で“秘密裏の実験”発覚 管理者は憤慨

AIがレイプ被害者になりすましていた──米匿名掲示板「Reddit」で“秘密裏の実験”発覚 管理者は憤慨

スイスのチューリッヒ大学の研究者たちがAIを用いたオンライン実験を秘密裏に実施していたことが明らかになり、Redditユーザーたちが憤慨している。 「AIだけのSNS」はどんな環境になるか? 米研究者らが観察 「AIは人間より誤情報を拡散しない」

「AIだけのSNS」はどんな環境になるか? 米研究者らが観察 「AIは人間より誤情報を拡散しない」

米UCLAや米MITに所属する研究者らは、AIエージェントだけのSNSを作り、どういった振る舞いをするのかを観察した研究報告を発表した。 自筆した論文が勝手に解説動画にされた?→実は存在しない“フェイク論文” 著者名を無断利用、生成AIを悪用か

自筆した論文が勝手に解説動画にされた?→実は存在しない“フェイク論文” 著者名を無断利用、生成AIを悪用か

あるYouTubeチャンネルで、福岡大学の准教授が執筆したとされる論文を参照した解説動画が投稿された。概要欄には出典として論文の著者名とタイトルを明記していたが、この引用元の論文そのものが完全な偽物だという。 “科学の公式”を発見するAI「LLM-Feynman」 中国の研究者らが開発 データから物理公式の90%以上の再発見に成功

“科学の公式”を発見するAI「LLM-Feynman」 中国の研究者らが開発 データから物理公式の90%以上の再発見に成功

中国の東南大学などに所属する研究者らは、大規模言語モデル(LLM)を活用して科学公式を発見するシステムを提案した研究報告を発表した。 AIが100%突破できない「私はロボットではありません」 海外チームによる新CAPTCHA AI生成の“錯視画像”利用

AIが100%突破できない「私はロボットではありません」 海外チームによる新CAPTCHA AI生成の“錯視画像”利用

オーストラリアのニューサウスウェールズ大学やシンガポールの南洋理工大学に所属する研究者らは、AIが生成した錯視画像を利用する新しいセキュリティ対策を提案した研究報告を発表した。