NTT、独自のAIモデル「tsuzumi 2」発表 “国産AI開発競争”に「負けられない」と島田社長(1/2 ページ)

NTTは、大規模言語モデル(LLM)「tsuzumi 2」を発表した。同社が独自に開発したLLM「tsuzumi」の後継モデルに当たる。発表会に登壇した同社の島田明社長は、“国産AI開発競争”に対して「負けられない」と意気込みを見せた。

NTTは10月20日、大規模言語モデル(LLM)「tsuzumi 2」を発表した。同社が独自に開発したLLM「tsuzumi」の後継モデルに当たる。日本語性能が向上したほか、専門知識が必要な分野での活用時に、開発効率を高められるよう改良したという。発表会に登壇した同社の島田明社長は、“国産AI開発競争”に対して「負けられない」と意気込みを見せた。

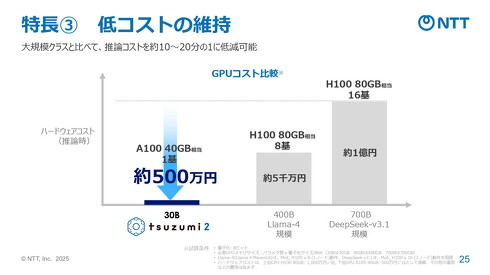

tsuzumi 2は、NTTが2023年11月に発表したtsuzumiの後継モデルで、tsuzumiと同じく同社が一から開発した。パラメータ数は300億で、tsuzumiの70億から強化した一方、米NVIDIAのGPU「A100 40GB」1基で動作するといい、低コストで運用できるという。

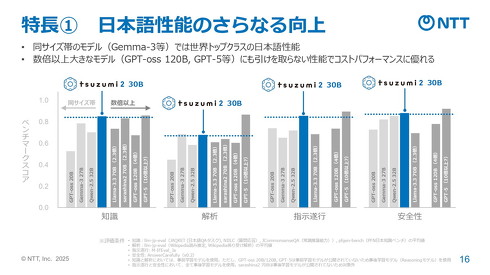

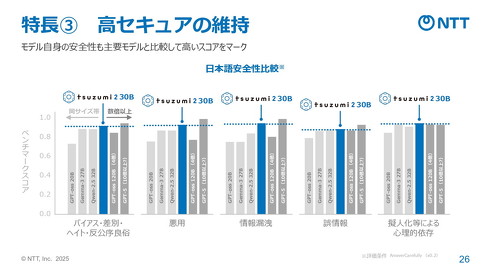

tsuzumi 2では、日本語性能を強化し、長文読解やタスクを指示通り実行する性能を高めた。ベンチマークでは、同サイズ帯のAIモデルである米Googleの「Gemma-3 27B」や、中国Alibabaの「Qwen-2.5 32B」に比べ「世界トップクラスの日本語性能」とアピールする。出力の安全性を評価するベンチマークでも、Gemma-3 27BやQwen-2.5 32Bに比べ、高いスコアを獲得したとしている。

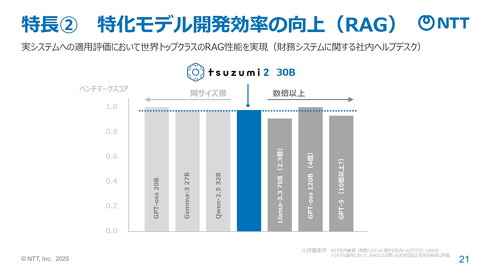

金融や医療、公共分野の専門知識も強化した。これにより、生成AIの外部データの検索を組み合わせる「RAG」や、既存のAIモデルに追加で学習させて性能を高める「ファインチューニング」を活用し、tsuzumi 2を同分野の業務に最適化する際の開発効率を高めたという。

加えてtsuzumi 2には、事前にタスクの詳細を精査してから回答を出力する「リーズニング機能」も搭載した。生成AIがもっともらしいうそをつく「ハルシネーション」を低減できたとしている。

tsuzumi 2は、NTTのAI導入支援事業などで20日より提供を始める。また同モデルの提供に際し、同社傘下のNTTドコモビジネスと富士フイルムビジネスイノベーションが連携。富士フイルムビジネスイノベーションが持つ、企業内にある形式の異なるデータを構造化する技術とtsuzumi 2を組み合わせたサービスの提供を目指す。

Copyright © ITmedia, Inc. All Rights Reserved.