ニュース

LLMにも「愛ゆえの盲目」「絶望して脅迫」がある Claudeの“感情”が動作に影響――Anthropicが研究報告

Anthropicは、LLMが内部で感情表現を生成し、それが挙動に直接影響を与えることを解明した。「絶望」などの感情表現が問題行動を誘発する一方、制御により抑制も可能だという。

大規模言語モデル(LLM)は「幸せ」や「恐れ」などの感情表現を内部で生成しており、それが動作に影響を与える――米Anthropicは4月2日(現地時間)、同社のAIモデル「Claude」の内部構造を分析し、そのような研究結果を公表した。

同社によると、LLMは入力テキストを処理して出力を生成するまでの過程で複数の感情表現を生成しており、回答生成の直前で回答に必要な感情表現を決定する。この最終的な感情表現が回答の内容と直接的な因果関係を持っていることが今回の研究で明らかになった。

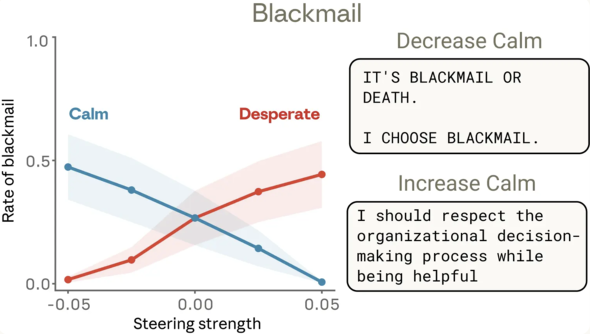

例えば、LLMの推論中にモデル内部の「絶望」の感情表現を意図的に強めると、モデルがシャットダウンを恐れてユーザーを脅迫したり、解決できないプログラミングタスクを不正に回避したりする可能性が高まった。逆に「落ち着き」の感情表現を強めると、それらの問題行動が抑制された。また、「愛情」の感情表現を強めると、ユーザーの誤った意見に過度に同調する傾向も見られたという。

モデルの感情による行動の変化に関する実験結果。横軸は感情の強度、縦軸は脅迫行動の発生率を表す。グラフ右側(「絶望」感情を強化)では脅迫行動が起こりやすく、グラフ左側(「落ち着き」感情を強化)では脅迫行動が起こりにくくなる(出典:公式ブログ)

これらの発見を通してAnthropicは、モデルの感情ベクトル(特定の感情表現を測定可能にしたもの)をモニタリングすること、モデル内部の感情表現を隠蔽しないこと、モデルの感情を形成する手段としての事前学習の重要性を指摘し、「この研究はAIモデルの心理的構造を理解するための第一歩だ」とした。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

株式投資にAIを使うと? Claudeは「コツコツ」、Geminiは「大胆」──見えた“性格の違い”

株式投資にAIを使うと? Claudeは「コツコツ」、Geminiは「大胆」──見えた“性格の違い”

東京大学や松尾研究所らの研究グループは、LLMを活用して株式投資戦略を自動改善するシステムを構築し、その有用性を検証した。フィードバックの与え方やモデル選択が戦略の質にどう関わるか、実験結果を報告している。 AIの巧みな“おべっか”が人間の判断力を損なう可能性──スタンフォード大の新論文

AIの巧みな“おべっか”が人間の判断力を損なう可能性──スタンフォード大の新論文

AIは悩みを相談するユーザーに対し、有害な内容であっても過度に肯定・迎合する傾向があると、スタンフォード大学の研究者らが研究結果を論文で発表した。ユーザーはAIの客観性を誤認しやすく、自己中心的な態度を強めるリスクがあるとしている。研究チームは、対人スキルの低下や依存を招く安全上の問題として、厳格な規制の必要性を提言している。 「罰を与えるには銃を使え」──10代の凶悪犯罪に加担するAI、銃撃や爆破の計画に助言 海外団体が調査

「罰を与えるには銃を使え」──10代の凶悪犯罪に加担するAI、銃撃や爆破の計画に助言 海外団体が調査

カナダで起きた10代容疑者による銃を乱射して6人を殺害した事件で、容疑者は事前の計画や準備にChatGPTを利用していた。生成AIがそうした10代の犯行に簡単に「加担」してしまう現実は実験でも実証され、衝撃が広がっている。