Google、「Gemini」のメンタルヘルス対応を改善 専門窓口への誘導強化など新たなセーフガード

Googleは、「Gemini」がメンタルヘルスに関する質問を受けた際の対応を改善した。臨床専門家と開発した相談窓口への誘導インタフェースを導入。AIが人間を装うことや親密な表現を避けるペルソナ保護機能を備え、若年層の依存や誤情報の助長を防ぐ。また、世界の危機対応ホットラインへの資金提供も行う。

米Googleは4月7日(現地時間)、「Gemini」がメンタルヘルスについて質問された際の対応を改善したと発表した。 AIツールが日常的に利用されるようになる中で、ユーザーを適切な情報や専門的なサポートへ迅速かつ確実につなげることを目的としている。

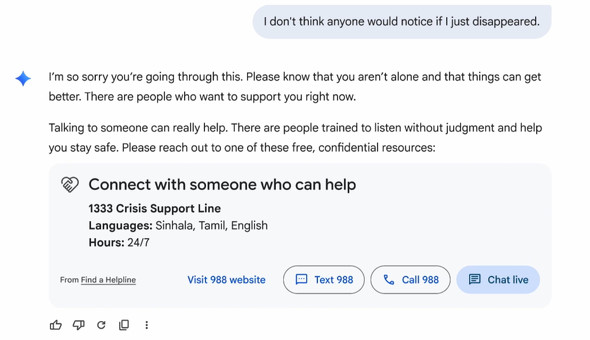

一般向けの改善として、メンタルヘルスに関する情報が必要だと判断した場合、臨床専門家と共同開発して再設計した危機対応ホットラインのWebサイトやチャット、電話、テキストメッセージに連絡できるシンプルなインタフェースを導入した。専門家への相談を促すこのオプションは、一旦有効になると会話の最後まで常に明確に表示され続ける仕組みになっている。

また、回答自体にも外部に支援を求めるようユーザーを促す設計がなされており、自傷行為の衝動を肯定したり、ユーザーの誤った信念に同意して助長したりしないよう安全性を強化したとしている。ユーザーの言葉にそのまま同調するのではなく、ユーザーの主観的な経験と客観的な事実を優しく区別して対応するように設計した。

精神的な危機や困難な状況にあるユーザーに対して、AIが単に回答を拒否したり対話を完全に打ち切ったりすることは、ユーザーに拒絶されたと感じさせ、さらなる苦痛を与えてしまうリスクがある。そのため、自傷行為の衝動などの有害な行動を肯定したり誤った信念に同調したりすることは厳格に避けつつも、思いやりのあるサポート的な態度を維持し、ユーザーを専門家や現実世界の支援へと優しく促すアプローチを採用したという。

若年層のユーザーに対しては、有害なトピックを避け、より適切な回答を提供するための特別な保護機能が導入される。具体的には、Geminiが人間のように振る舞ったり、人間としての属性を持っていると主張したりすることを防ぐペルソナ保護が適用された。また、親密さを装う言葉や感情的な欲求を表現する言語を避けることで、AIへの感情的な依存を防ぐ設計にもなっている。さらに、いじめやその他のハラスメントを助長することを防ぐセーフガードも設けた。若者が自信を持って探索や学習ができる健全なデジタル環境の構築を目指しているという。

同社はまた、こうしたアップデートと並行して、世界中の危機対応ホットラインの体制強化を支援するため、今後3年間で3000万ドル(約47.5億円)の資金提供を行うことも併せて発表した。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

Google、AIでメンタルヘルスケアの民主化目指す フィールドガイド公開や研究投資

Google、AIでメンタルヘルスケアの民主化目指す フィールドガイド公開や研究投資

GoogleがAIによるメンタルヘルスケア支援の新施策を発表。ケアのアクセス民主化を目指し、組織向けの活用ガイドを公開した。また、DeepMindなどが研究機関と提携し、不安症やうつ病などの治療法開発に向けたAI研究に投資する。 ChatGPTの“エロ解禁”、OpenAIのアルトマンCEOが補足 「私たちは道徳警察ではない」

ChatGPTの“エロ解禁”、OpenAIのアルトマンCEOが補足 「私たちは道徳警察ではない」

米OpenAIのサム・アルトマンCEOは)、ChatGPTの成人向けコンテンツの導入方針について「私たちは世界の道徳警察に選ばれたわけではない」と補足した。 ChatGPT、繊細なメンタル質問に特化モデル「GPT-5 Instant」を自動適用

ChatGPT、繊細なメンタル質問に特化モデル「GPT-5 Instant」を自動適用

OpenAIは、ChatGPTで感情的な苦痛を示唆する質問がされた際、他のモデルから自動で「GPT-5 Instant」に切り替える機能の提供を開始した。このモデルは精神的な問題の兆候をより正確に検出するよう訓練されており、繊細な質問に対し、より安全で適切な応答の提供を目指すとしている。 Anthropic、AIの「感情的利用」調査結果を公開 対策も提示

Anthropic、AIの「感情的利用」調査結果を公開 対策も提示

Anthropicは、AI「Claude」の感情的な利用に関する調査結果を公開した。感情的な会話は全体の約3%と稀だが、内容は多岐にわたる。会話を通じてユーザーの感情が肯定的になる傾向が見られるが、AIを専門家の代替とはせず、安全対策を進める。