ロボットが計器読み取り可能に、Googleが産業現場向けAIモデル「Gemini Robotics-ER 1.6」発表 Boston Dynamicsとも連携

Google DeepMindはロボット向けVLM「Gemini Robotics-ER 1.6」を発表。空間認識や計測器の読み取りなど、産業現場で求められる能力を高めたモデルだとうたう。

Google DeepMindは2026年4月14日(現地時間)、ロボット向け視覚言語モデル(VLM)「Gemini Robotics-ER 1.6」(以下、ER 1.6)を発表した。空間認識や計測器の読み取りなど、産業現場で求められる能力を高めたモデルとされる。米Boston Dynamicsと連携し同社の4足歩行ロボット「Spot」に同モデルを搭載。施設の巡回点検における計器の読み取り、撮影を可能にした。

ER 1.6は3つの特徴的な機能を持つモデルだ。1つ目は「Pointing」(指差し)という、指差し確認をするように複数の物体を認識する機能だ。物体の正確な検出や、物体間の比較、物体の奇跡のトラッキングにも活用される。ER 1.6は複雑なタスクの推論の前段階でこの機能を使い、タスクの精度を向上させたという。

2つ目は「Success Detection」(成功検出)だ。これはタスクが完了したかどうかをロボット自身が判断する機能で、失敗時の再試行や次工程への移行を自律的に実行するのに必要なものだ。ER 1.6は複数のカメラの映像を認識する能力が強化され、タスクが完了したかどうかを多角的に分析、把握できるようになったという。

3つ目は「Instrument Reading」(計測器読み取り)だ。前世代の「ER 1.5」にはなかった新機能で、工場や施設の温度計、圧力計など常時監視が必要なアナログ計器の値をモデルが認識できるようになった。ER 1.6は画像の拡大やPointing、コード実行を段階的に組み合わせることで、針の位置や目盛りの間隔を高精度に解釈するという。

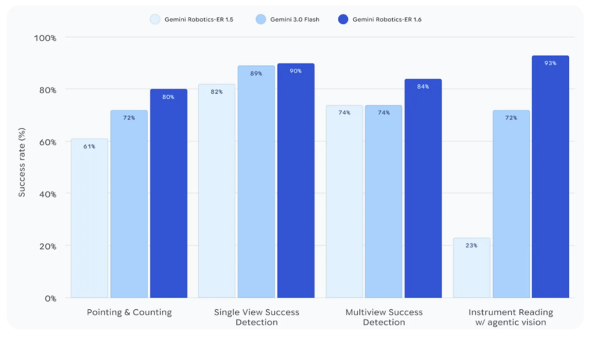

ER 1.6は、ER 1.5および「Gemini 3.0 Flash」と比較して、これら全てのタスクで成功率が向上した。特に計測器読み取りタスクでは、ER 1.5の23%、Gemini 3.0 Flashの72%に対し、ER 1.6は93%を達成。安全性面でも、実際の負傷報告に基づくシナリオテスト「ASIMOV」において、テキストや物体の認識能力ではGemini 3.0 Flashを上回った。

ER 1.6は、「Gemini API」および「Google AI Studio」を通じて開発者向けに提供されている。開発を始めるための「Google Colaborate」環境も公開されている。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

ソフトバンクなどAI基盤モデル開発の新会社設立か 1兆パラメーター規模モデルでフィジカルAI開発目指すと報道

ソフトバンクなどAI基盤モデル開発の新会社設立か 1兆パラメーター規模モデルでフィジカルAI開発目指すと報道

ソフトバンクがNECやホンダ、ソニーグループと共にAI基盤モデル開発を目指す新会社を設立したと報じられた。大規模モデルとロボットの連携を目指すとされる。 SB Intuitions、自律的にTシャツを畳めるロボアーム 1枚約40秒で完了

SB Intuitions、自律的にTシャツを畳めるロボアーム 1枚約40秒で完了

ソフトバンク傘下でAIを研究開発するSB Intuitionsは、自律的にTシャツを畳める2本のロボットアームの動画を公開した。1枚約40秒で畳み終える様子を確認できる。 Boston Dynamicsの人型ロボ「Atlas」、華麗に“ロン宙”を決める 失敗シーンも同時公開

Boston Dynamicsの人型ロボ「Atlas」、華麗に“ロン宙”を決める 失敗シーンも同時公開

ロボット開発企業の米Boston Dynamicsは、同社の人型ロボット「Atlas」が、側転の途中で身体をひねって後ろ向きに着地する「ロンダート」から後方宙返りを決める動画を公開した。Atlasの商用化に向け、性能をテストした際の様子という。