AWS re:Invent 2024 Day1の発表8つ総まとめ 「データ&AI」時代へのAWSの答え:AWS re:Invent 2024まとめ

「AWS re:Invent 2024」の基調講演において同社でCEO(最高経営責任者)を務めるマット・ガーマン氏が登壇しAWSの戦略と多数の新サービスについて発表した。本稿ではその内容を紹介する。

Amazon Web Services(以下、AWS)は2024年12月2日〜6日(現地時間)にかけて、米ラスベガスで年次イベント「AWS re:Invent 2024」を開催している。2024年12月2日の基調講演には、同社でCEO(最高経営責任者)を務めるマット・ガーマン氏が登壇し、AWSの戦略と多数の新サービスについて発表した。

中でも注目されているのが「Amazon Q Developer」「Amazon Q Business」の発表だろう。Amazon Q Developerは、メインフレーム資産だけでなく、VMware環境の移行支援の他、Windows環境に残る.NETアプリケーションのAWSネイティブなLinux環境への移行を支援する機能も用意する。Amazon Q Businessにおいては検索拡張生成(RAG)アプリケーション開発を支援する機能が盛り込まれる。

Amazon Q、新AIモデル、Bedrockアップデート……データ&AI時代の到来を予感させる注目のアップデート8つ

今回の発表で注目の8つのアップデートを以下で紹介する。

1.Amazon EC2に最新チップ搭載の3つの新インスタンスが登場

ガーマン氏は基調講演の冒頭でAWSにおける「Building blocks」の考え方について説明した。これはある特定のベストなものを集めて新しい有意義な形で提供するという概念だ。AWSはこのコンセプトに基づいて何百というサービスを提供しユニークなプラットフォームを作り上げてきた。re:Invent 2024の基調講演で発表されたアップデートや新サービスは、AWSという巨大なプラットフォームを構成するそれぞれのBuilding Blockの拡張や強化ということになる。

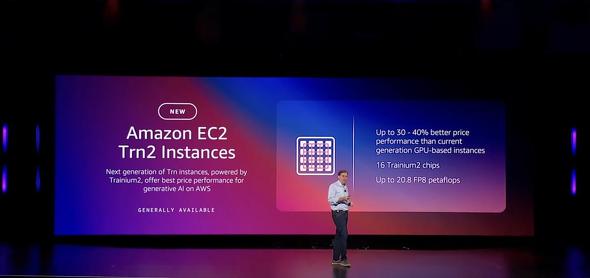

ガーマン氏はまず、AWSサービスの根幹であるEC2の進化、そしてARMベースの独自開発チップであるGravitonプロセッサーの成功について振り返った上で、新たに「P6インスタンス」「Trn2インスタンス」 「Trn2 UltraServer」 という3つの新しいEC2インスタンスを発表した。P6インスタンスはNVIDIAによる最新GPU「Blackwell」を搭載したもので、これまでの最も高速なGPUと比較しても2.5倍の性能を持つ。P6インスタンスは2025年に利用可能になる予定とされている。

Trn2インスタンスは、自社開発したTrainiumチップの最新モデルである「Trainium2」を搭載したインスタンスだ。このインスタンスにはNeuronLinkで接続された16個のTrainium2チップが搭載されており、その処理性能は20.8PFLOPS(ペタフロップス)以上を記録している。Trn2インスタンスを使用することで、従来のEC2 GPUインスタンスと比較してコストパフォーマンスが30〜40%向上する。

Trn2 UltraServersは、4つのTrn2インスタンスで構成される高性能インスタンスだ。これはTrn2インスタンスをNeuronLink接続することによって1つのノードで合計64個のTrainium2チップの利用を可能にしたものであり、最大で83.2PFLOPSの計算能力を提供できる。

さらにガーマン氏は次世代チップとなる「Trainium3」の計画にも言及した。Trainium3は3ナノメートルのプロセスノードを使用して製造され、Trainium2よりも2倍の計算能力を実現できる見込みとされている。

2.Amazon S3がIcebergに対応 分析用のデータストレージ機能を強化

「Amazon S3」は現在、40兆以上のオブジェクトが稼働するストレージサービスに成長している。そのS3の中でも近年急成長しているデータタイプの一つが「Apache Iceberg」だ。Icebergは巨大な分析テーブルのための高性能フォーマットであり、ビッグデータに対してSQLベースのテーブルの信頼性と使いやすさを提供する。

今回AWSは、このApache Icebergに特化した新たなS3サービスとして「Amazon S3 Tables」を発表した。S3 Tablesを利用することで、従来のテーブルと比較してSQLによる検索速度は3倍、転送スピードは10倍向上する。さらに、S3 Tablesではバケットのテーブル管理が自動化され、スナップショット管理やファイル削除、最適化といったメンテナンスタスクの運用コストを大幅に削減できる。

Amazon S3の新サービスとしてはその他、「Amazon S3 Metadata」も発表された。S3では数十億単位のオブジェクトを含んだバケットも作成できるが、そのような大規模なバケットでどのように目的のオブジェクトを見つけるかが課題になっていた。S3 Metadataはこの課題を解決するものとなる。S3 MetadataではS3オブジェクトの追加や変更の際に自動的にメタデータを生成してApache Icebergテーブルに保存する。これによってS3に保存されるオブジェクトをより効率的に管理できるようになる。

3.PostgreSQL互換の大規模分散データベースAmazon Aurora DSQL

マネージドデータベースの新サービスとして注目を集めたのが、マルチリージョンで動作する大規模分散データベース「Amazon Aurora DSQL」だ。これは極めて高い可用性とスケーラビリティ、そして強い一貫性を備えたSQLベースのフルマネージド データベースであり、「PostgreSQL」との互換性も備えている。S

分散データベースにおけるトランザクション処理では、地理的に離れた拠点間の通信によるレイテンシーが大きな問題になる。Aurora DSQLでは、拠点間のトランザクション処理を根本的に見直し、レイテンシーを劇的に改善した上で、データの一貫性も確保することに成功。ガーマン氏によれば、Aurora DSQLによるマルチリージョンにおける書き込み処理は、Googleが開発したデータベース「Spanner」と比較してレイテンシーが約4分の1であり、極めて高速だとしている。これは「事実上無限にスケールし、全てのリージョンでインフラ管理が不要であり、マルチリージョンによる99.999%の可用性を備えたデータベース」となる。

Aurora DSQLはプレビュー版として、まずはUS East(N. Virginia)、US East(Ohio)、US West(Oregon)の各リージョンで利用可能になる。

NoSQLの分散データベースでは新サービスとして「Amazon DynamoDB global tables」が発表された。これはAurora DSQLと同様の仕組みをNoSQLにも適用したもので、Amazon DynamoDBが簡単にマルチリージョンに展開できるようになる。

4.Amazon Bedrockはモデル作成支援やAI倫理、マルチモーダルに対応

AWSは2023年に新たな生成AIサービスとして「Amazon Bedrock」を発表した。これはさまざまなAIモデルを、APIを通じてアプリケーションで利用できるようにするもので、サーバーレスで手軽に生成AIアプリを構築できる点が最大の魅力だ。今回AWSはこのBedrockにおいてさまざまな新サービスを発表した。

「Amazon Bedrock Model Distillation」は特定のユースケース向けのモデルを簡単に作成して利用できるサービスだ。Bedrock Model Distillationでは小規模な基盤モデルを教師モデルと呼ばれるより大規模な基盤モデルから生成した応答を使ってチューニングする。この工程によって、ユーザーは教師モデルに近い精度でより安くて高速な基盤モデルを作成できる。

「Amazon Bedrock Automated Reasoning checks」は生成AIの回答におけるハルシネーションを防止する新しいサービス。従来のBedrock Guardrailsでは不適切なコンテンツや個人情報を含んだコンテンツをフィルタリングできた。それに対してBedrock Automated Reasoning checksでは、AIによって生成された内容が論理的に正しいのかどうかを自動で検証し、誤った出力を防止できる。

「Amazon Bedrock Multi Agent Collaboration」は複数のAIエージェントを強調動作させることができるサービスだ。Bedrockには特定のタスクを実行するためのAIエージェント機能がある。これまでは単一のエージェントで全てのタスクを実行する必要があったが、Bedrock Multi Agent Collaborationを使えばタスクごとにエージェントを用意し、それらを協調動作させることで一連の作業を効率的に実行可能になる。エージェントの再利用性の向上にもつながる。

5.AWS独自のAIモデルAmazon Nova

基調講演にはガーマン氏に代わってAmazonのCEO兼社長であるアンディ・ジャシー氏も登壇した。生成AIに対するAWSの取り組みについて語った上で、独自開発したAIモデル「Amazon Nova」を発表した。Amazon Novaは規模に応じて次の4つのモデルで構成されており、Amazon Bedrockで利用可能となる。

- Nova Micro: テキストのみ処理できる、低コストかつ低レイテンシーなモデル

- Nova Lite: 画像、動画、テキストによる入力に対応した、低コストかつ高速なマルチモーダルモデル

- Nova Pro: 精度、スピード、コストの最適な組み合わせを実現した、幅広いタスクに対応可能な高性能なマルチモーダルモデル

- Nova Premier: 最も複雑な推論タスクに対応する高性能なマルチモーダルモデル。カスタムモデルを抽出するための教師として最適なモデル

ジャシー氏は各種ベンチマークにおいてAmazon Novaが他の既存モデルよりも優れた結果を得たことを示し、他のモデルに比べて75%廉価でコスト効果に優れていると説明した。Amazon Novaは日本語を含む15言語をサポートする。

さらに、Amazon Novaをベースにした画像生成サービスの「Amazon Nova Canvas」と、動画生成サービスの「Amazon Nova Reel」も発表された。来年第1四半期には、音声に対して音声で回答が得られる「Amazon Nova Speech to Speech」が登場する予定だ。来年半ばに向けて音声や画像、動画による入力と出力が可能な「Amazon Nova Any to Any」も計画中だとジャシー氏は語った。

6.Cobol、.Net、VMware資産のダナイズ支援も視野に Amazon Q Developerの強化

「Amazon Q」はAWS独自の高性能な生成AIアシスタントであり、2024年5月に一般提供が開始された。このAmazon Qのサービスのひとつとして、ソフトウェア開発者向けのコーディング支援AI「Amazon Q Developer」がある。Amazon Q Developerを使えば、さまざまなコーディング作業がAIの支援によって大幅に効率化できる。しかしガーマン氏は、「開発者が実際にコーディングをしている時間は1日のうちの1時間程度で、それ以外の時間は他の作業に費やされている」と指摘。そこで今回AWSは、開発者の「その他の作業」をカバーする次の3つのアップデートを発表した。

- Amazon Q generates and applies unit tests

- Amazon Q generates accurate documantation

- Amazon Q perform code review

それぞれ、単体テストの作成や実行、ドキュメントの作成、そしてコードレビューを自動化する自立エージェント機能になっている。テストの生成では、プロジェクト全体のコードを参照した上で、必要なテスト項目が自動で抽出されてテストコードに反映される。ドキュメント作成は、過去のコードまで参照した上で必要な情報を文書化する。そしてコードレビューでは、脆弱(ぜいじゃく)性の疑いがあるコーディングパターンも確認できる。この3つの新機能は同日から一般提供が開始されている。

さらにAmazon Q Developerでは、レガシーコードのマイグレーション支援機能も大幅にアップデートされた。すでにJavaのバージョンアップ支援機能は搭載されていたが、今回のアップデートで、.NETアプリケーションのWindowsからLinuxへの移行、VMwareワークロードのクラウドネイティブへの移行、そしてメインフレーム上のアプリケーションの最新化についても、AIの支援が受けられるようになった。

また、Amazon Q Developerを使ってAWSインフラの問題点を検証し、トラブルシューティングできるようになった。これらの機能は同日からプレビュー公開された。

7.ビジネスデータの分析・可視化向けサービスAmazon Q Business、QuickSight

Amazon Qのアップデートは開発支援機能だけではない。Amazon Qには、自然言語によるチャットや、RAGを使った情報検索と回答生成、さまざまなデータソース連携、セキュアな認証認可基盤などが簡単に利用できるようになる「Amazon Q Business」というサービスがある。一方でAWSには、簡単に分析環境を作ることができるBIサービスの「Amazon QuickSight」がある。

今回AWSでは、この2つのサービスの連携させる新しい分析基盤が発表された。これによって、Amazon Q BusinessのデータをシームレスにQuickSightに連携し、分析した結果をダッシュボード上で可視化できるようになった。

さらに、Amazon Q Businessで使用される内部インデックスのAmazon Q indexでは、新たに外部サービス向けのAPIが公開された。これによって、独立系ソフトウェアベンダーがAPIを通じて自社のアプリケーションにAmazon Q indexを統合できるようになる。これは、外部アプリケーションがAmazon Q Businessの生成AIエクスペリエンスを活用できることを意味している。

8.ゼロETLに向けたSageMakerの機能強化 SageMaker Unified Studio、SageMaker Lakehouse

機械学習サービス「Amazon SageMaker」では、次世代のSageMakerとして「Amazon SageMaker Unified Studio」が発表された。SageMakerはAIモデルの構築からトレーニング、デプロイまでをサポートするフルマネージドサービスだ。SageMaker Unified Studioはデータ処理や検索、モデル開発、生成AIなど、全てのデータ分析とAIニーズをひとつのエンタープライズデータビューに統合したツールだ。

ガーマン氏はさらに、AWSが掲げる「ゼロETL」の概念について説明した。ゼロETLは、ETL(抽出、変換、ロード)のデータパイプラインを構築する必要性を最小限に抑える統合の考え方とされる。現在のETLパイプラインの構築は、多くの手作業を必要とする極めて煩雑で時間とコストがかかる作業になっている。ゼロETLはシステム間でリアルタイムにデータの自動連携をすることでETLの煩雑な工程をなくしてデータ活用につなげるものになる。

AWSでは今回、このゼロETLの実現をサポートする新しいサービスとして「Amazon SageMaker Lakehouse」を発表した。SageMaker LakehouseはApache Icebergと互換性のある全てのツールやエンジンをデータソースとして利用できるようにするサービスで、異なる複数のデータソースのシームレスな統合を実現する。SageMaker Lakehouseをユーザーは単一のデータウェアハウスとして使用し、分析や機械学習を実行することが可能になる。

ガーマン氏は最後に「今日のイノベーションの量とスピードは本当に素晴らしい。AWSだけでなく、顧客、パートナー、企業、スタートアップからのイノベーションが極めて重要」と話し、講演を締めくくった。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

「VMWare Cloud on AWS」から「Nutanix Cloud Clusters on AWS」への移行支援を本格化、NutanixとAWS

「VMWare Cloud on AWS」から「Nutanix Cloud Clusters on AWS」への移行支援を本格化、NutanixとAWS

NutanixはAWSとの提携を拡大し、顧客がオンプレミス環境をクラウドへスムーズに移行できる「Nutanix Cloud Clusters on AWS」の提供を開始する。 AWSが「金融リファレンスアーキテクチャ日本版」v1.5をリリース

AWSが「金融リファレンスアーキテクチャ日本版」v1.5をリリース

Amazon Web Servicesは「金融リファレンスアーキテクチャ日本版」v1.5を発表した。「FISC安全対策基準・解説書(第12版)」に対応した他、メインフレーム連携やAWS Outposts活用を含む新たなアーキテクチャーが追加されている。 AWSがネイティブなVMware環境を用意か Amazon EVSがまもなく登場

AWSがネイティブなVMware環境を用意か Amazon EVSがまもなく登場

Amazon Web Servicesは新たなAWSネイティブサービスである「Amazon Elastic VMware Service」(Amazon EVS)を発表した。リファクタリングや再プラットフォーム化なしでAWSのスケールメリットが得られるとしている。 企業ITの「重荷」解消なるか 富士通とNRIがレガシー資産のクラウドシフトに本腰

企業ITの「重荷」解消なるか 富士通とNRIがレガシー資産のクラウドシフトに本腰

国内IT大手2社がAWSとの連携を強化する。企業に残るレガシー資産のクラウドシフト、DXを推進する新たな取り組みだ。