iPhone内のヌード写真をAIで検出し、保護してくれるアプリ「Nude」

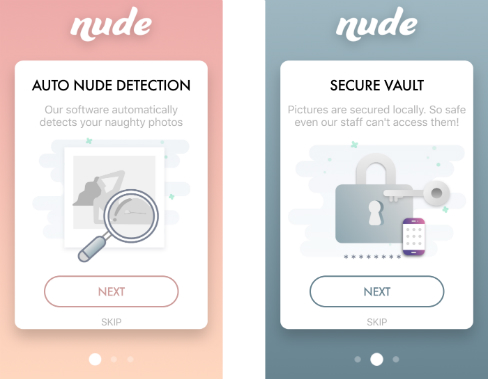

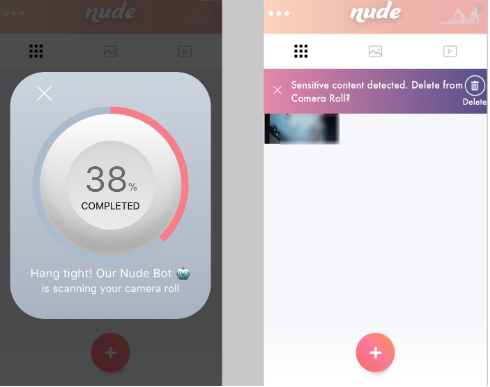

iPhoneのカメラロールに入っているヌード写真をAIで検出し、PINで保護されたアプリ内に移動してカメラロールからは削除するアプリ「Nude: The Sexiest App Ever」がバージョン1.5になり、検出作業をローカルでするようになった。

iPhoneのカメラロールとiCloudに保存してある写真や動画からヌード(裸)のものをAIで検出してPINコードで守られたフォルダに移動し、カメラロールとiCloudから削除するアプリ「Nude: The Sexiest App Ever」が10月12日にバージョン1.5になり、iOS 11以降搭載端末であれば、端末側で対象になる画像を検出できるようになった。6月のリリース段階では画像の検出はクラウド上(AWSのRekognition技術)で行われていた。

アプリは無料だが、30日間のトライアル期間の後、月額0.99ドルあるいは年額9.99ドルのサブスクリプション料金が掛かる。

インストールしてカメラロールへのアクセスを許可すると、カメラロール内のスキャンが始まり、ヌードを見つけると表示してカメラロールから削除するかどうか聞いてくる。

2014年にセレブのヌードがiCloudから流出した事件があって以来、クラウド上に人に見せたくない写真を保存することに抵抗を感じる人は多いかもしれない。また、スマートフォン内のカメラアプリで人に写真を見せているときにうっかり変な写真が見えてしまう心配もある。Nudeは昔撮って自分でも忘れているようなヌード写真も検出してくれるので、そうした心配を払拭してくれるアプリといえそうだ。

ヌードだけでなく、例えば運転免許証やマイナンバーカードなどの機密情報の写真を保存しておくのにもいいかもしれない。アプリにもカメラ機能がついているので、直接撮影してNude内に保存しておける。

Androidアプリはまだないが、開発中だ。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

Instagramの著名人アカウントがハッキング被害、個人情報が流出

Instagramの著名人アカウントがハッキング被害、個人情報が流出

Instagram APIのバグが悪用され、複数の著名Instagramユーザーの個人情報が何者かに不正アクセスされた。 「Googleフォト」に恥ずかしい写真を削除せずに非表示にできる「アーカイブ」機能

「Googleフォト」に恥ずかしい写真を削除せずに非表示にできる「アーカイブ」機能

「Googleフォト」の新機能「アーカイブ」は、恥ずかしい写真などを削除せずに隠せる(フォトビューに表示させない)。 Facebook、AI採用のリベンジポルノ対策スタート

Facebook、AI採用のリベンジポルノ対策スタート

Facebookが、Facebook、Messenger、Instagram上でのリベンジポルノ拡散を防ぐためのAI採用ツールを発表した。 reddit、同意なしのポルノ投稿を削除へ プライバシーポリシー改定で

reddit、同意なしのポルノ投稿を削除へ プライバシーポリシー改定で

昨年秋にiCloudから流出したセレブのプライベート写真の大量投稿を問題視したredditが、プライバシーポリシーを改定し、本人の同意のない性的コンテンツはリクエストベースで削除すると発表した。