OpenAI傗DeepMind偺CEO傗僩僢僾尋媶幰傜丄乽AI偵傛傞恖椶愨柵儕僗僋乿寈忇惡柧偵彁柤

挊柤側AI尋媶幰丄僄儞僕僯傾丄CEO傜偑乽AI偵傛傞愨柵偺婋尟惈傪寉尭偡傞偙偲傪悽奅揑桪愭帠崁偵偡傋偒乿偲偄偆惡柧偵彁柤偟偨丅彁柤幰偵偼僸儞僩儞攷巑丄OpenAI丄DeepMind丄Anthropic偺CEO側偳偑偄傞丅Meta偺儖僇儞攷巑傗儅僗僋巵丄Microsoft傗Amazon丄IBM偼彁柤偟偰偄側偄丅

丂AI偵庢傝慻傓挊柤尋媶幰丄僄儞僕僯傾丄CEO側偳偺僌儖乕僾偑5寧30擔乮暷崙帪娫乯丄AI偵傛傞恖椶愨柵偺婋婡偵偮偄偰丄怴偨側寈崘傪敪偟偨丅

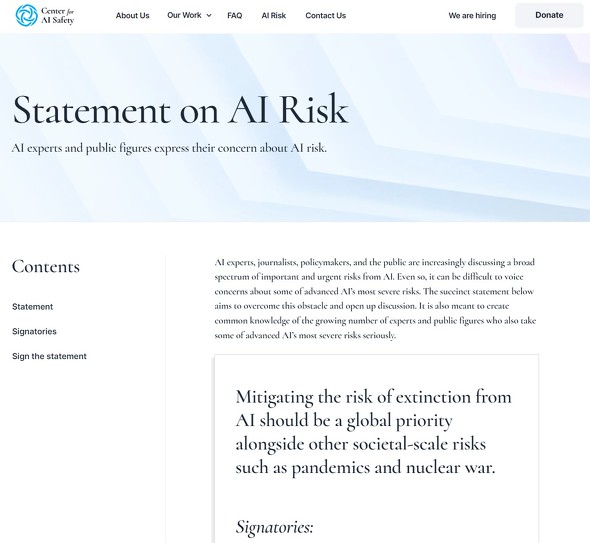

丂乽Statement on AI Risk乿乮AI儕僗僋偵娭偡傞惡柧乯偵彁柤偟偨偺偩丅峀偔庴偗擖傟傜傟傞傛偆娙寜偵傑偲傔傜傟偨偙偺惡柧偼丄乽Mitigating the risk of extinction from AI should be a global priority alongside other societal-scale risks such as pandemics and nuclear war.乿乮AI偵傛傞愨柵偺儕僗僋傪寉尭偡傞偙偲偼丄僷儞僨儈僢僋傗妀愴憟側偳偺懠偺幮夛揑婯柾偺儕僗僋偲暲傫偱悽奅揑側桪愭帠崁偲偡傋偒偩乯偲偄偆傕偺偩丅

丂偙偺惡柧偼丄僒儞僼儔儞僔僗僐偵嫆揰傪抲偔旕塩棙抍懱Center for AI Safety乮CAIS乯偑敪弌偟偨丅

丂僠儏乕儕儞僌徿傪庴徿偟偨僕僃僼儕乕丒僸儞僩儞攷巑偲儌儞僩儕僆乕儖戝妛偺儓僔儏傾丒儀儞僕僆嫵庼丄暷OpenAI偺僒儉丒傾儖僩儅儞CEO丄暷Google DeepMind偺僨儈僗丒僴僒價僗CEO丄暷Anthropic偺僟儕僆丒傾儌僨僀CEO側偳偑彁柤偟偰偄傞丅

丂擔杮偐傜傕丄慡擼傾乕僉僥僋僠儍丒僀僯僔傾僥傿僽戙昞偺嶳愳 岹巵丄宑滀媊弇戝妛摿暿彽阗嫵庼偺崅嫶峆堦巵偑彁柤偟偰偄傞丅

丂僸儞僩儞巵傜偲摨帪偵僠儏乕儕儞僌徿傪庴徿偟偨暷Meta偺儎儞丒儖僇儞攷巑偼彁柤偟偰偄側偄丅摨巵偼乽恖娫傪挻偊傞AI偼傑偩懚嵼偟側偄偺偱丄儕僗僋偺儕僗僩偺忋埵偵埵抲偯偗傞偺偼傑偩憗偡偓傞丅偣偄偤偄將儗儀儖偺AI偺婎杮愝寁偑偱偒傞傑偱偼丄AI傪埨慡偵偡傞曽朄傪媍榑偡傞偺偼帪婜彯憗偩乿偲僣僀乕僩偟偨丅

丂庡側AI娭楢婇嬈偱彁柤偟偨廬嬈堳偑偄側偄婇嬈偼丄Apple丄Amazon丄Microsoft丄Meta丄NVIDIA丄IBM丄Intel丄Salesforce側偳丅僀乕儘儞丒儅僗僋巵傕彁柤偟偰偄側偄丅側偍丄GoogleMind偺恊夛幮偱偁傞Google傕彁柤偟偰偄側偄丅乮杮峞幏昅尰嵼乯

丂CAIS偺僄僌僛僋僥傿僽僨傿儗僋僞乕丄僟儞丒僿儞僪儕僢僋僗巵偼暷New York Times偵懳偟丄惡柧傪娙寜偵偟偨偺偼丄堄尒偺憡堘傪旔偗傞偨傔偲岅偭偨丅3寧偵FLI偑岞奐偟偨AI奐敪傪6僇寧掆巭偡傞傛偆屇傃偐偗傞彁柤塣摦偵懳偟偰偼丄儕僗僋偼擣傔傞偑奐敪掆巭偼夝寛偵側傜側偄側偳偺斸敾偑婑偣傜傟偨丅

丂CAIS偼乽AI儕僗僋偺8偮偺椺乿偲偄偆暥彂傪岞奐偟偰偄傞丅偙偺暥彂偱偼丄乽AI偑傛傝崅搙偵側傞偲丄嵟廔揑偵偼夡柵揑側儕僗僋傗懚懕儕僗僋傪堷偒婲偙偡壜擻惈偑偁傞乿偲偟偰偄傞丅

丂AI偼恖娫偑嶌惉偟偨僐儞僥儞僣偲嬫暿偡傞偺偑擄偟偄僥僉僗僩丄夋憸丄價僨僆傪惗惉偱偒傞傛偆偵側傝偮偮偁傝丄曃尒傪塱懕偝偣丄帺棩宆暫婍傪嫮壔偟丄岆偭偨忣曬傪峀傔丄僒僀僶乕峌寕傪幚峴偡傞偨傔偵傕巊梡偝傟傞壜擻惈偑偁傞丅偝傜偵丄AI偑帺棩揑偵峴摦偱偒傞傛偆偵側傟偽丄恖娫偼AI傪惂屼偱偒側偔側傞儕僗僋偑崅傑傞劅劅偲CAIS偼愢柧偟偰偄傞丅

Copyright © ITmedia, Inc. All Rights Reserved.

娭楢婰帠

OpenAI偺傾儖僩儅儞CEO丄乬僗乕僷乕僀儞僥儕僕僃儞僗乭偺崙嵺婯惂婡娭棫偪忋偘傪採彞

OpenAI偺傾儖僩儅儞CEO丄乬僗乕僷乕僀儞僥儕僕僃儞僗乭偺崙嵺婯惂婡娭棫偪忋偘傪採彞

OpenAI偼丄彨棃揑偵偼AI奐敪傪娔帇偡傞崙嵺婯惂婡娭偑昁梫偵側傞偲採彞偟偨丅10擭埲撪偵AI偼AIG傪挻偊傞superintelligence乮挻抦擻乯偵側傞偲偄偆丅偨偩偟丄尰峴偺僾儘僕僃僋僩傪婯惂偡傋偒偱偼側偄偲傕丅 暷僶僀僨儞惌尃丄OpenAI側偳AI娭楢4幮偺CEO傪彽偒乽愑擟偁傞僀僲儀乕僔儑儞乿懀偡

暷僶僀僨儞惌尃丄OpenAI側偳AI娭楢4幮偺CEO傪彽偒乽愑擟偁傞僀僲儀乕僔儑儞乿懀偡

暷僶僀僨儞惌尃偼丄Google丄OpenAI丄Microsoft丄Anthopic偺CEO傪儂儚僀僩僴僂僗偵彽廤丅AI奐敪偵娭偡傞乽棪捈偱寶愝揑側媍榑偑峴傢傟偨乿偲偟偰偄傞丅 乬AI偺僑僢僪僼傽乕僓乕乭偙偲僸儞僩儞攷巑丄Google傪戅幮偟偰AI奐敪偵寈忇

乬AI偺僑僢僪僼傽乕僓乕乭偙偲僸儞僩儞攷巑丄Google傪戅幮偟偰AI奐敪偵寈忇

乬AI偺僑僢僪僼傽乕僓乕乭偺擇偮柤傪帩偮僕僃僼儕乕丒僸儞僩儞攷巑偑Google傪帿傔偨丅New York Times偺僀儞僞價儏乕偱乽Google傪帿傔偨偺偱丄AI偺儕僗僋偵偮偄偰帺桼偵榖偣傞傛偆偵側偭偨乿偲岅偭偨丅婇嬈偑AI僔僗僥儉傪夵慞偡傞偵偮傟偰丄婋尟偼憹戝偡傞偲寈忇傪柭傜偡丅 OpenAI丄乽AI 偺埨慡惈偵懳偡傞摉幮偺傾僾儘乕僠乿傪愢柧丂乽擭楊妋擣僆僾僔儑儞専摙拞乿

OpenAI丄乽AI 偺埨慡惈偵懳偡傞摉幮偺傾僾儘乕僠乿傪愢柧丂乽擭楊妋擣僆僾僔儑儞専摙拞乿

OpenAI偑乽AI偺埨慡惈偵懳偡傞摉幮偺傾僾儘乕僠乿傪愢柧偟偨丅乽GPT-4傛傝嫮椡側AI偺奐敪傪捈偪偵掆巭偣傛乿偲偄偆彁柤塣摦側偳傪庴偗偨傕偺偲傒傜傟傞丅乽埆梡偡傞曽朄傪偡傋偰梊應偡傞偙偲偼偱偒側偄乿偑怴偟偄僔僗僥儉偺儕儕乕僗偼怲廳偵峴偭偰偄傞偲庡挘偡傞丅 AI奐敪掆巭梫媮彁柤偼柍堄枴丄摟柧惈偲愢柧愑擟偺夵慞傪劅劅Hugging Face偺儖僢僠儑乕僯攷巑

AI奐敪掆巭梫媮彁柤偼柍堄枴丄摟柧惈偲愢柧愑擟偺夵慞傪劅劅Hugging Face偺儖僢僠儑乕僯攷巑

僀乕儘儞丒儅僗僋巵側偳偑彁柤偟偨乽GPT-4傛傝嫮椡側僔僗僥儉奐敪傪掆巭偣傛乿偲偄偆岞奐彂娙偵偮偄偰丄AI尋媶幰偑乽旕尰幚揑偱晄昁梫乿偲昡偟偨丅偦傟傛傝傕僈僀僪儔僀儞傪嶌惉偟丄摟柧惈偲愢柧愑擟傪夵慞偡傋偒偩偲庡挘偡傞丅 乽GPT-4傛傝嫮椡側AI偺奐敪傪捈偪偵掆巭偣傛乿劅劅岞奐彂娙偵儅僗僋巵傗僂僅僘僯傾僢僋巵偑彁柤

乽GPT-4傛傝嫮椡側AI偺奐敪傪捈偪偵掆巭偣傛乿劅劅岞奐彂娙偵儅僗僋巵傗僂僅僘僯傾僢僋巵偑彁柤

旕塩棙偺AI尋媶慻怐FLI偼嫄戝AI幚尡偺堦帪掆巭傪媮傔傞彂娙傪岞奐偟偨丅乽GPT-4傛傝嫮椡側AI偺奐敪傪彮側偔偲傕6僇寧掆巭偣傛乿偲偟偰偄傞丅儅僗僋巵傗僂僅僘僯傾僢僋巵丄乽僒僺僄儞僗慡巎乿偺僴儔儕巵側偳偑彁柤嵪傒偩丅 OpenAI丄AGI乮恖娫傛傝尗偄AI乯傊偺儘乕僪儅僢僾傪岞昞丂乽悽奅偵怺崗側奞傪媦傏偡壜擻惈乿夞旔偺偨傔偵

OpenAI丄AGI乮恖娫傛傝尗偄AI乯傊偺儘乕僪儅僢僾傪岞昞丂乽悽奅偵怺崗側奞傪媦傏偡壜擻惈乿夞旔偺偨傔偵

夛榖宆AI僒乕價僗乽ChatGPT乿傪庤妡偗傞OpenAI偼丄AGI乮Artificial General Intelligence丟斈梡恖岺抦擻乯幚尰偺儘乕僪儅僢僾傪岞奐偟偨丅摨幮偼AGI傪乽堦斒揑偵恖娫傛傝尗偄AI僔僗僥儉乿偲掕媊偡傞丅AGI偑悽奅偵奞傪媦傏偝側偄傛偆丄岞奐嫤媍偑昁梫偲偟偰偄傞丅