米AI大手、生成AIによる児童性的虐待コンテンツ作成を阻止する原則に署名

Microsoft、Google、OpenAIなどを含むAI企業10社は、非営利団体が策定した児童性的虐待コンテンツ(CSAM)阻止原則「Safety by Design」に署名した。トレーニングデータセットにCSAMが含まれないことなどを保証する。

児童性的虐待資料の拡散阻止に尽力している米非営利団体Thornと責任あるテクノロジーに焦点を当てた非営利団体All Tech Is Humanは4月23日(現地時間)、主要なAI大手と協力し、生成AIの悪用による児童性的虐待コンテンツ(Child Sexual Abuse Material、CSAM)の作成と拡散を防ぐ「Safety by Design」原則を発表した。

Amazon、Anthropic、Civitai、Google、Meta、Metaphysic、Microsoft、Mistral AI、OpenAIStability AIがこの原則に賛同し、署名した。

これらの企業は、トレーニングデータセットにCSAMが含まれないことを保証し、CSAMを含む高リスクなデータセットを回避し、CSAM画像やCSAMへのリンクをデータソースから削除することを約束する。

また、AIモデルの「ストレステスト」を実施してCSAM画像が生成されないことを確認し、子供の安全性が評価された場合にのみモデルをリリースすることを約束する。

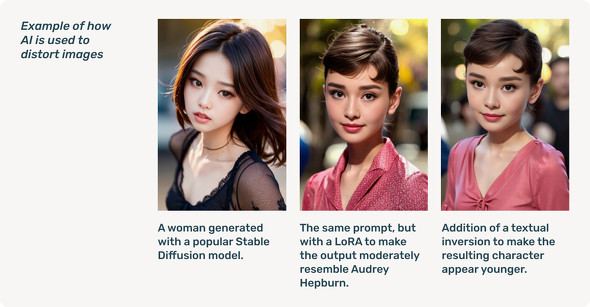

Thornは、生成AIにより、1人の児童性的搾取者が大量のCSAMを簡単に作成できるようになると主張。オリジナルの画像や動画をAIで改変し、新たなCSAMを生成する可能性があると警告する。

Googleは公式ブログで、この原則を順守することに加え、2006年から加盟している米児童保護団体National Center for Missing & Exploited Children(NCMEC)の取り組みのために広告助成金を増額したことも発表した。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

MetaのザッカーバーグCEO、公聴会で自殺者の写真を掲げる傍聴人に直接謝罪

MetaのザッカーバーグCEO、公聴会で自殺者の写真を掲げる傍聴人に直接謝罪

米連邦議会上院司法委員会が開催したSNSでの子供の安全に関する公聴会は4時間にわたった。傍聴席にはSNS関連で自殺した被害者の親が多数並び、MetaのザッカーバーグCEOは立ち上がって彼らに謝罪の言葉を述べた。 pixiv「児童を写実的に描写」イラストをiOS/Androidアプリで非表示に ストアのガイドライン違反防止

pixiv「児童を写実的に描写」イラストをiOS/Androidアプリで非表示に ストアのガイドライン違反防止

「pixiv」のiOS/Androidアプリで、「児童を写実的に児童を描写したイラスト・マンガ」が非表示に。アプリストアのガイドライン違反防止のため。 米連邦政府、AIタスクフォース立ち上げへ

米連邦政府、AIタスクフォース立ち上げへ

米国土安全保障省(DHS)は、AIの脅威から国を守るためのAIタスクフォースを立ち上げると発表した。マヨルカス長官は、AIが脅威の状況を変化させたため、対抗するためのツールを強化する必要があると語った。 物議をかもすiPhone内の“児童ポルノ画像検知”にAppleがFAQ公開 「メッセージは見ない」「他の写真は検知しない」

物議をかもすiPhone内の“児童ポルノ画像検知”にAppleがFAQ公開 「メッセージは見ない」「他の写真は検知しない」

Appleが児童性的虐待コンテンツ(CSAM)対策として米国でiOS/iPadOS 15から実施すると発表した新機能が物議を醸している。Appleはそれらの懸念に応えるFAQを公開した。 Google、ディープニューラルネットワーク採用児童ポルノ画像検出APIを公開

Google、ディープニューラルネットワーク採用児童ポルノ画像検出APIを公開

Googleが、AI採用の児童の性的虐待コンテンツ(SCAM)検出ツールを対策に取り組む団体や企業に無償提供すると発表した。このツールにより、テストではレビュワーのSCAM対処効率が700%アップしたとしている。