日本企業に定着しつつあるAI活用。議事録の要約やプレゼン資料の作成、自律的にタスクをこなす「AIエージェント」など業務への適用が広がっている。難しいと思われていた画像や動画の生成も実用に耐える品質になってきた。

しかし、そのほとんどのAIモデルはOpenAIやGoogleといった米国企業製だ。中国のDeepSeekも話題になったことから必ずしも米国一強ではないものの、いずれにしても使われているのは日本国外のAIばかりだ。

“AI先進国”の背中を追いかける日本でも、海外製のチューニングではなく独自のLLMをフルスクラッチで開発しようという動きが始まっている。だが、それは本当に必要なことだろうか。海外の高性能なLLMを使えば十分ではないのか。

この疑問に対して「『日本人により近いAI』の開発にチャレンジする意義がある」と強く語るのは、ソフトバンクの子会社で国産LLM開発に挑んでいるSB Intuitionsの丹波廣寅氏だ。その真意はどこにあるのだろうか。

「海外製AIで満足」 そんな企業が警戒すべきこと

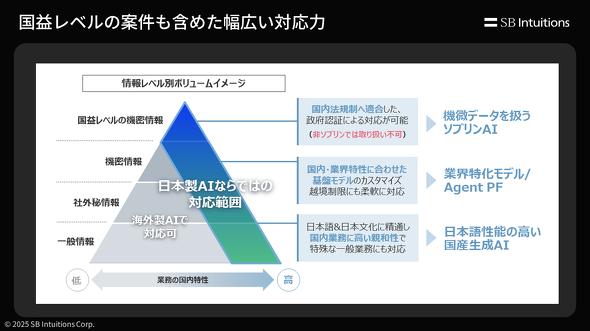

「多くのビジネスパーソンはChatGPTなど海外製AIに満足し、それで十分だと考えているのではないか」――こんな質問を投げかけると、丹波氏は同意しつつもそれでは足りないケースがあると説明する。

「簡単な検索やレポート作成であれば海外モデルでよいかもしれません。しかし、法律や専門用語など業務に則した情報を扱えないと使い物にならないケースもあるでしょう。日本には独自の文化があり、商習慣があり、法律があります。日本語の性能でベストを発揮するような、日本人の価値観を反映したAIを構築すれば『ビジネスシーンで失礼にならない』『国内産業のニーズに適合させやすい』など業務に役立つはずです」

AIサービスの安全性の観点からも日本製であることは重要という。AIサービスに入力したデータの流出や再学習への転用を不安視する声や、サービス方針や価格の急な変更によってビジネスに悪影響が出ることを警戒する企業があるのだ。機密情報が多い業界や個人情報を扱う企業などは海外モデルへの懸念から利用を禁止しているところがあると丹波氏は語る。

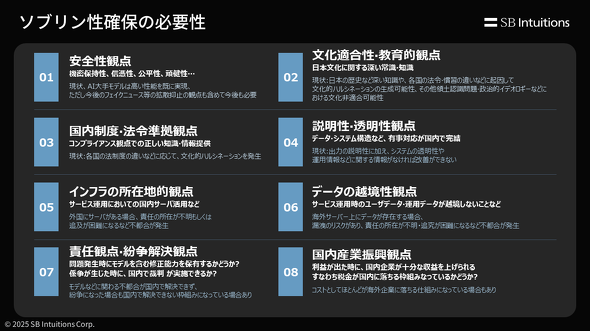

海外企業のサービスに依存しすぎると、自社のビジネスひいては社会の維持に支障を来す可能性にも注意が必要だ。この問題はクラウドサービスで顕在化している。「企業データが国外に保存されており、外国の規制の影響を受ける」「データの機密性が守られるか不透明」「唐突な値上げやサービス廃止にあらがえない」──これらの懸念から、自分たちでコントロールすることを掲げた「ソブリンクラウド」という考え方が支持を集めている。「ソブリン」は「主権者」を意味する単語だ。

「海外の技術やサービスに完全に依存すると、社会や経済が成り立たなくなってしまいます。サービスの提供を停止されたら立ち行かなくなるのです。AIが一過性のブームなら大きな問題ではないのかもしれませんが、デジタルサービスの根幹になるのなら主権を必ず持っておかなければなりません」

AIの主権を自分たちで管理するという考え方がソブリンAIだ。その条件として、丹波氏は3つの主権を保持することが大切だと説明する。

【技術主権】

AIの基盤となる技術を自国で開発、運用することで、供給停止のリスクに備える。技術の発展や変化対応力を強化させるという意義もある。

【データ主権】

企業活動や国家運営で生み出された重要なデータを自分たちの管理下に置くことで、データ漏えいなどのセキュリティリスクに備える。外国の法律や規制に縛られることもなくなる。資産であるデータが海外に流出すれば、企業や社会のさらなる成長に歯止めをかける事態にもなりかねない。

【運用主権】

データセンターなどのインフラが国内にあっても、管理者が海外企業であれば「主権がある」とは言えない。国内にあって日本人が主権を発揮できない状態は“出島”のような状態と言える。

「選択肢が少ない今の状況は望ましくありません。実用にたえるのはほとんどが海外製のAIです。『ソブリンAIを説いても、使えるのは海外製しかない』『日本語の精度に不満があっても、他に乗り換えられない』といった状況を打破するためにSB Intuitionsで国産AIを開発しています」

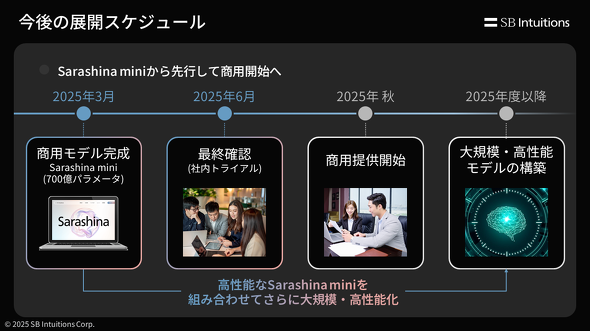

創業1年強で4600億パラメーターのモデルを公開

ソブリンAIの実現を目指すSB Intuitionsは、その歩みを着実に進めている。日本語性能に強みを持つLLMとして「Sarashina」シリーズの開発に着手しており、創業からわずか1年後の2024年に700億パラメーターのモデル「Sarashina2-70B」をオープンソースで公開した。

その数カ月後には、同モデルを基にした4600億パラメーターのモデル「Sarashina2-8x70B」を公開。これは、専門性が高い複数のエキスパートモジュールを組み合わせる「Mixture-of-Experts」モデルだ。既存モデルを生かしてより大規模で高性能なモデルを作るアップサイクリングの手法を採用することで、LLM開発を加速させている。

SB Intuitionsは、言語モデルにとどまらず、画像処理に強い大規模視覚言語モデル(VLM)などにも取り組んでいる。2025年6月現在、ソフトバンクが社内でSarashinaを試験的に使っている他、中外製薬と新薬開発の研究でタッグを組むなど、研究を加速させている。

なぜ1兆パラメーターのAIモデルが必要なのか?

現在、SB Intuitionsが掲げているのは1兆パラメーターに上るLLMの開発だ。モデルのトップラインを引き上げた上で、蒸留や量子化によって性能を維持しつつ目的に合うサイズまで軽量化した小型モデルを作ることで社会実装に適したAIを構築する狙いだと丹波氏は説明する。

そこから先は実用を見据えた取り組みになる。特定の業界や企業の業務に合わせた専門的なAIモデルを構築するアプローチ、動画や音声などの多様なデータを扱えるマルチモーダル化のアプローチ、ロボットのように現実世界に物理的に影響を及ぼせる「フィジカルAI」を作るアプローチ、これらを組み合わせてAIの社会実装を推進する構えだ。

Sarashinaの開発には、ソフトバンクが構築したAI計算基盤を利用。約4000基の高性能GPU「NVIDIA Hopper GPU」を含むGPU約6000基から成るスーパーコンピュータ(スパコン)で、2025年7月中に4000基の「NVIDIA Blackwell GPU」を追加し、合わせて約1万基になる。ソフトバンクは今後もGPUを増強するとしている。

さらに、ソフトバンクはスパコンの世界ランキング「TOP500」で国内第3位を誇る「CHIE-3」を保有している他、北海道苫小牧市や大阪府堺市のシャープ工場跡地などに巨大なAI向けデータセンターを建設する計画で、2026年中に稼働する予定。SB IntuitionsのAIモデルとソフトバンクのAIインフラが合わさることで、日本の産業を支えるソブリンAIの実現を目指す。

国産AIを浸透させるためのタッグ

国産AIモデルが完成して終わりではなく、そのモデルを社会実装してこそ真価を発揮する。SB IntuitionsはAIモデルの開発と並行して提供方法を検討中で、「オンプレミス型」「プライベートクラウド型」「小型モデルをエッジ環境で動かせるようにする」「アプリケーションサービス化する」など設計中だと丹波氏は明かす。

さらに、先端技術の社会実装に知見を持つソフトバンクとの連携も強化。通信網や物流など社会インフラを幅広く支えるソフトバンクと一体となって進めることで、日本全国に格差なくAIを含む先端技術を届ける狙いだ。丹波氏はソフトバンクの次世代技術開発本部を率いる立場でもあり、「次世代の社会インフラ」を構築する上でAIが重要なピースになると語る。

次世代社会インフラを支えるAIは1種類に限定されない。モデルによって得手不得手があるため、用途に合わせて最適なモデルを選択できる環境を用意することが理想的だ。「マルチモデル」の中に国産AIをそろえることで、日本にとって重要な情報を自分たちの手で扱える社会――ソブリンAIを実現する。丹波氏は「日本人ならではのAIを構築したい」と強調し、そのために国産AI開発の最前線を走り続けるという決意を見せた。

Copyright © ITmedia, Inc. All Rights Reserved.

提供:SB Intuitions株式会社

アイティメディア営業企画/制作:ITmedia NEWS編集部/掲載内容有効期限:2025年7月30日